Pytanie 1

Składnikiem systemu Windows 10, który zapewnia ochronę użytkownikom przed zagrożeniami ze strony złośliwego oprogramowania, jest program

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Składnikiem systemu Windows 10, który zapewnia ochronę użytkownikom przed zagrożeniami ze strony złośliwego oprogramowania, jest program

W systemie Windows do przeprowadzania aktualizacji oraz przywracania sterowników sprzętowych należy wykorzystać narzędzie

Czym jest kopia różnicowa?

Podczas uruchamiania komputera wyświetla się komunikat "CMOS checksum error press F1 to continue press DEL to setup". Naciśnięcie klawisza DEL spowoduje

Wykonanie polecenia fsck w systemie Linux spowoduje

ile bajtów odpowiada jednemu terabajtowi?

Standard IEEE 802.11 określa typy sieci

Co oznacza zapis 192.168.1/24 w kontekście maski podsieci?

W topologii gwiazdy każde urządzenie działające w sieci jest

Który z systemów operacyjnych przeznaczonych do sieci jest dostępny na zasadach licencji GNU?

Na rysunkach technicznych dotyczących instalacji sieci komputerowej oraz dedykowanej instalacji elektrycznej, symbolem pokazanym na rysunku oznaczane jest gniazdo

Lokalny komputer dysponuje adresem 192.168.0.5. Po otwarciu strony internetowej z tego urządzenia, która identyfikuje adresy w sieci, uzyskano informację, że adresem komputera jest 195.182.130.24. Co to oznacza?

W sieciach komputerowych miarą prędkości przesyłu danych jest

Urządzenie, które łączy różne segmenty sieci i przekazuje ramki pomiędzy nimi, wybierając odpowiedni port docelowy dla przesyłanych ramek, to

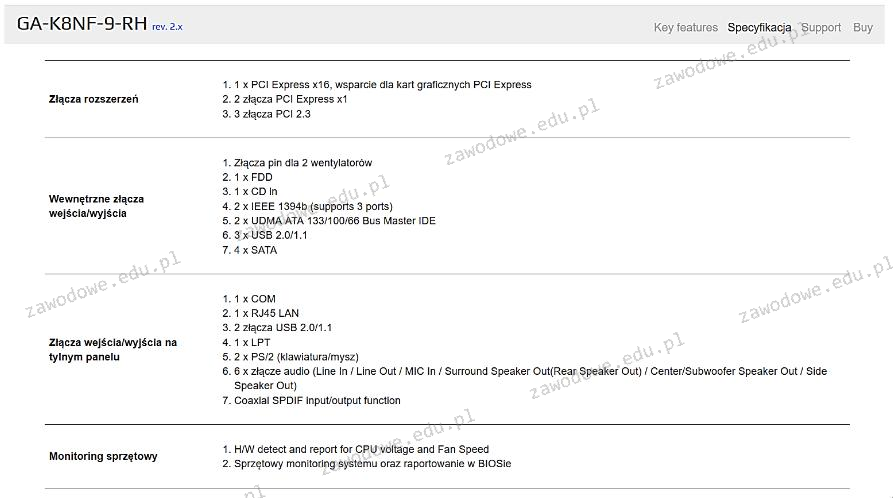

Na przedstawionym rysunku znajduje się fragment dokumentacji technicznej płyty głównej GA-K8NF-9-RH rev. 2.x. Z tego wynika, że maksymalna liczba kart rozszerzeń, które można zamontować (pomijając interfejs USB), wynosi

Maksymalna długość łącza światłowodowego używanego do przesyłania danych w standardzie 10GBASE-SR wynosi

Jakim poleceniem w systemie Linux można ustawić powłokę domyślną użytkownika egzamin na sh?

SuperPi to aplikacja używana do oceniania

W wierszu poleceń systemu Windows polecenie md jest używane do

W tabeli zaprezentowano parametry trzech dysków twardych w standardzie Ultra320 SCSI. Te dyski są w stanie osiągnąć maksymalny transfer wewnętrzny

| Rotational Speed | 10,025 rpm | ||

| Capacity (Formatted) | 73.5GB | 147GB | 300GB |

| Number of Heads | 2 | 5 | 8 |

| Number of Disks | 1 | 3 | 4 |

| Internal Transfer Rate | Up to 132 MB/s | ||

| Interface Transfer Rate | NP/NC = 320MB/s, FC = 200MB/s | ||

| Buffer Size | |||

| Average Seek (Read/Write) | 4.5/5.0 ms | ||

| Track-to-Track Seek/Read/Write | 0.2ms/0.4ms | ||

| Maximum Seek (Read/Write) | 10/11 ms | ||

| Average Latency | 2.99 ms | ||

| Power Consumption (Idle) | NP/NC = 9.5W, FC = 10.5W | ||

| Acoustic Noise | 3.4 bels | ||

| Shock - Operating/Non-Operating | 65G/225G 2ms | ||

Nowe komponenty komputerowe, takie jak dyski twarde czy karty graficzne, są umieszczane w metalizowanych opakowaniach foliowych, których głównym celem jest zabezpieczenie

W systemie operacyjnym pojawił się problem z driverem TWAIN, który może uniemożliwiać prawidłowe funkcjonowanie

Liczba 129 w systemie dziesiętnym będzie przedstawiona w formacie binarnym na

Który z protokołów będzie wykorzystany przez administratora do przesyłania plików na serwer?

W sieci komputerowej działającej pod systemem Linux do udostępniania drukarek można zastosować serwer

Oblicz koszt realizacji okablowania strukturalnego od 5 punktów abonenckich do panelu krosowego, wliczając wykonanie kabli łączących dla stacji roboczych. Użyto przy tym 50 m skrętki UTP. Każdy punkt abonencki posiada 2 gniazda typu RJ45.

| Materiał | Jednostka | Cena |

|---|---|---|

| Gniazdo podtynkowe 45x45, bez ramki, UTP 2xRJ45 kat.5e | szt. | 17 zł |

| UTP kabel kat.5e PVC 4PR 305m | karton | 305 zł |

| RJ wtyk UTP kat.5e beznarzędziowy | szt. | 6 zł |

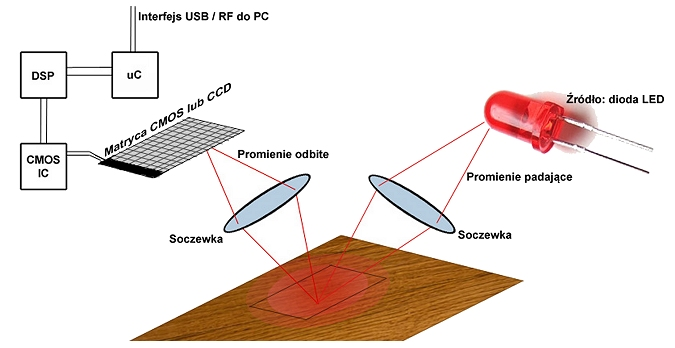

Zaprezentowany diagram ilustruje zasadę funkcjonowania

Urządzenie peryferyjne, które jest kontrolowane przez komputer i wykorzystywane do obsługi dużych, płaskich powierzchni, a do produkcji druków odpornych na czynniki zewnętrzne używa farb rozpuszczalnikowych, to ploter

Zaprezentowany tylny panel płyty głównej zawiera następujące interfejsy:

Problemy z laptopem, objawiające się zmienionymi barwami lub brakiem określonego koloru na ekranie, mogą być spowodowane uszkodzeniem

Jaką liczbę punktów abonenckich (2 x RJ45) zgodnie z wytycznymi normy PN-EN 50167 powinno się zainstalować w biurze o powierzchni 49 m2?

Jakie urządzenie jest używane do pomiaru napięcia w zasilaczu?

Sprzęt, na którym można skonfigurować sieć VLAN, to

Chusteczki nasączone substancją o właściwościach antystatycznych służą do czyszczenia

Planując prace modernizacyjne komputera przenośnego, związane z wymianą procesora, należy w pierwszej kolejności

Które cechy ma licencja bezpłatnego oprogramowania zwana freemium?

Po wykonaniu eksportu klucza HKCU zostanie zapisana kopia rejestru zawierająca informacje, dotyczące konfiguracji

Zgodnie ze specyfikacją JEDEC typowe napięcie zasilania modułów niskonapięciowych pamięci RAM DDR3L wynosi

Funkcja failover usługi DHCP umożliwia

Program testujący wydajność sprzętu komputerowego to