Pytanie 1

Który typ drukarki stosuje metodę, w której stały barwnik jest przenoszony z taśmy na papier odporny na wysoką temperaturę?

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Który typ drukarki stosuje metodę, w której stały barwnik jest przenoszony z taśmy na papier odporny na wysoką temperaturę?

Jakie wbudowane narzędzie w systemie Windows służy do identyfikowania problemów związanych z animacjami w grach oraz odtwarzaniem filmów?

Pamięć, która działa jako pośrednik pomiędzy pamięcią operacyjną a procesorem o dużej prędkości, to

Osoba korzystająca z komputera publikuje w sieci Internet pliki, które posiada. Prawa autorskie zostaną złamane, gdy udostępni

Wtyczka zaprezentowana na fotografie stanowi element obwodu elektrycznego zasilającego

Jakie korzyści płyną z zastosowania systemu plików NTFS?

W systemie Linux plik posiada uprawnienia ustawione na 765. Grupa przypisana do tego pliku ma możliwość

Jakie polecenie w systemie Linux jest potrzebne do stworzenia archiwum danych?

W systemie Linux komenda, która pozwala na wyświetlenie informacji o aktywnych procesach, to

Na wyświetlaczu drukarki widnieje komunikat "PAPER JAM". Aby zlikwidować problem, należy w pierwszej kolejności

Na ilustracji pokazano komponent, który stanowi część

Oprogramowanie OEM (Original Equipment Manufacturer) jest przypisane do

Funkcja System Image Recovery dostępna w zaawansowanych opcjach uruchamiania systemu Windows 7 pozwala na

Kable światłowodowe nie są szeroko używane w lokalnych sieciach komputerowych z powodu

System limitów dyskowych, umożliwiający kontrolowanie wykorzystania zasobów dyskowych przez użytkowników, nazywany jest

Zbiór usług sieciowych dla systemów z rodziny Microsoft Windows jest reprezentowany przez skrót

Pierwsze trzy bity adresu IP w formacie binarnym mają wartość 010. Jaką klasę reprezentuje ten adres?

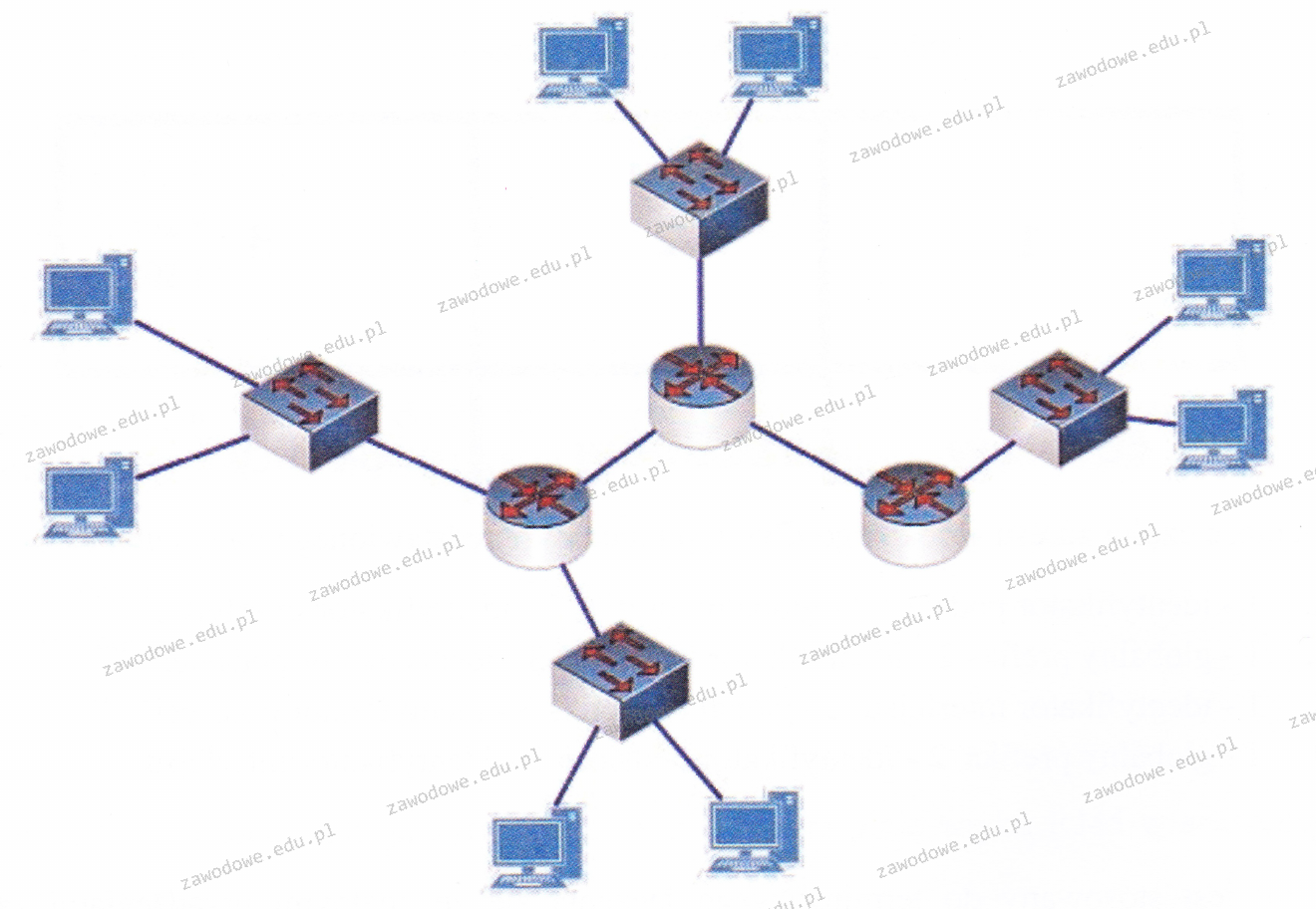

Ile symboli switchy i routerów znajduje się na schemacie?

Użycie którego z urządzeń może prowadzić do wzrostu liczby kolizji pakietów w sieci?

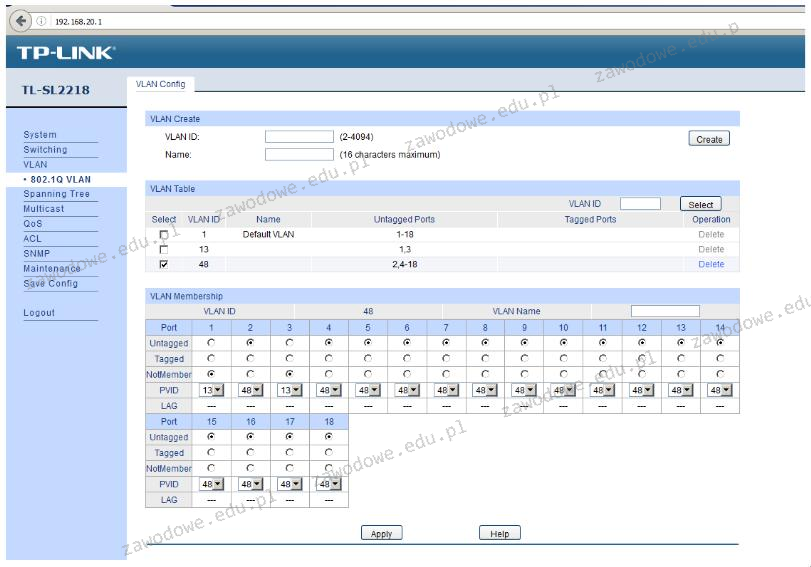

Na ilustracji zaprezentowano konfigurację urządzenia, co sugeruje, że

Jakie polecenie w systemie Linux przyzna możliwość zapisu dla wszystkich obiektów w /usr/share dla wszystkich użytkowników, nie modyfikując innych uprawnień?

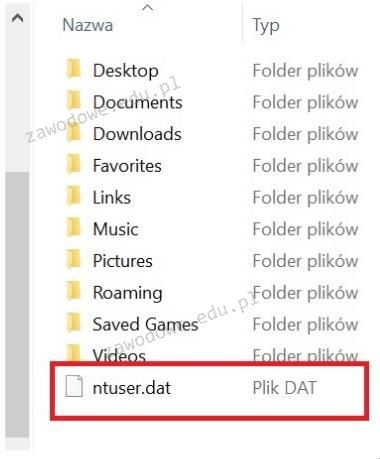

Aby zmienić profil na obowiązkowy, trzeba zmodyfikować rozszerzenie pliku ntuser.dat na

AppLocker to funkcjonalność dostępna w systemach Windows Server, która umożliwia

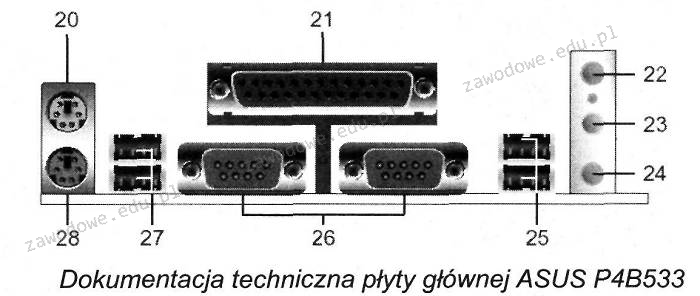

Na zaprezentowanej płycie głównej komputera złącza oznaczono cyframi 25 i 27

Jakie połączenie bezprzewodowe należy zastosować, aby mysz mogła komunikować się z komputerem?

Jakie polecenie w systemie Windows powinno zostać użyte, aby uzyskać wynik zbliżony do tego na załączonym obrazku?

TCP 192.168.0.14:57989 185.118.124.154:http ESTABLISHED TCP 192.168.0.14:57997 fra15s17-in-f8:http ESTABLISHED TCP 192.168.0.14:58010 fra15s11-in-f14:https TIME_WAIT TCP 192.168.0.14:58014 wk-in-f156:https ESTABLISHED TCP 192.168.0.14:58015 wk-in-f156:https TIME_WAIT TCP 192.168.0.14:58016 104.20.87.108:https ESTABLISHED TCP 192.168.0.14:58022 ip-2:http TIME_WAIT

Główną metodą ochrony sieci komputerowej przed zagrożeniem z zewnątrz jest zastosowanie

Przy zgrywaniu filmu kamera cyfrowa przesyła na dysk 220 MB na minutę. Wybierz z diagramu interfejs o najniższej prędkości transferu, który umożliwia taką transmisję

Problemy związane z zawieszaniem się systemu operacyjnego w trakcie jego uruchamiania są zazwyczaj spowodowane

Interfejs SLI (ang. Scalable Link Interface) jest wykorzystywany do łączenia

Jakie informacje można uzyskać dzięki programowi Wireshark?

Zarządzanie partycjami w systemach operacyjnych Windows

Podczas testowania kabla sieciowego zakończonego wtykami RJ45 przy użyciu diodowego testera okablowania, diody LED zapalały się w odpowiedniej kolejności, z wyjątkiem diod oznaczonych numerami 2 i 3, które świeciły równocześnie na jednostce głównej testera, natomiast na jednostce zdalnej nie świeciły wcale. Jaka mogła być tego przyczyna?

Urządzenie, które łączy różne segmenty sieci i przesyła ramki pomiędzy nimi, wybierając odpowiedni port, do którego są kierowane konkretne ramki, to

Podane dane katalogowe odnoszą się do routera z wbudowaną pamięcią masową

| CPU | AtherosAR7161 680MHz |

| Memory | 32MB DDR SDRAM onboard memory |

| Boot loader | RouterBOOT |

| Data storage | 64MB onboard NAND memory chip |

| Ethernet | One 10/100 Mbit/s Fast Ethernet port with Auto-MDI/X |

| miniPCI | One MiniPCI Type IIIA/IIIB slot One MiniPCIe slot for 3G modem only (onboard SIM connector) |

| Wireless | Built in AR2417 802. 11 b/g wireless, 1x MMCX connector |

| Expansion | One USB 2.0 ports (without powering, needs power adapter, available separately) |

| Serial port | One DB9 RS232C asynchronous serial port |

| LEDs | Power, NAND activity, 5 user LEDs |

| Power options | Power over Ethernet: 10..28V DC (except power over datalines). Power jack: 10..28V DC. Includes voltage monitor |

| Dimensions | 105 mm x 105 mm, Weight: 82 g |

| Power consumption | Up to 5W with wireless at full activity |

| Operating System | MikroTik RouterOS v3, Level4 license |

Który układ mikroprocesora jest odpowiedzialny między innymi za pobieranie rozkazów z pamięci oraz generowanie sygnałów sterujących?

Przedstawiony zestaw komputerowy jest niekompletny. Który element nie został uwzględniony w tabeli, a jest niezbędny do prawidłowego działania zestawu i należy go dodać?

| Lp. | Nazwa podzespołu |

|---|---|

| 1. | Cooler Master obudowa komputerowa CM Force 500W czarna |

| 2. | Gigabyte GA-H110M-S2H, Realtek ALC887, DualDDR4-2133, SATA3, HDMI, DVI, D-Sub, LGA1151, mATX |

| 3. | Intel Core i5-6400, Quad Core, 2.70GHz, 6MB, LGA1151, 14nm, 65W, Intel HD Graphics, VGA, TRAY/OEM |

| 4. | Patriot Signature DDR4 2x4GB 2133MHz |

| 5. | Seagate BarraCuda, 3.5", 1TB, SATA/600, 7200RPM, 64MB cache |

| 6. | LG SuperMulti SATA DVD+/-R24x,DVD+RW6x,DVD+R DL 8x, bare bulk (czarny) |

| 7. | Gembird Bezprzewodowy Zestaw Klawiatura i Mysz |

| 8. | Monitor Iiyama E2083HSD-B1 19.5inch, TN, HD+, DVI, głośniki |

| 9. | Microsoft OEM Win Home 10 64Bit Polish 1pk DVD |

Przedstawione na ilustracji narzędzie służy do

Urządzeniem wejściowym komputera, realizującym z najwyższą precyzją funkcje wskazujące w środowisku graficznym 3D, jest

Poprawność działania lokalnej sieci komputerowej po modernizacji powinna być potwierdzona