Pytanie 1

Oprogramowanie diagnostyczne komputera pokazało komunikat NIC ERROR. Co ten komunikat wskazuje?

Wynik: 24/40 punktów (60,0%)

Wymagane minimum: 20 punktów (50%)

Oprogramowanie diagnostyczne komputera pokazało komunikat NIC ERROR. Co ten komunikat wskazuje?

W dokumentacji technicznej procesora znajdującego się na płycie głównej komputera, jaką jednostkę miary stosuje się do określenia szybkości zegara?

Na płycie głównej uszkodzona została zintegrowana karta sieciowa. Komputer nie ma zainstalowanego dysku twardego ani żadnych innych napędów, takich jak stacja dysków czy CD-ROM. Klient informuje, że w firmowej sieci komputery nie mają napędów, a wszystko "czyta" się z serwera. W celu przywrócenia utraconej funkcji należy zainstalować

Narzędziem służącym do tworzenia logicznych podziałów na dysku twardym w systemie GNU/Linux jest

Wszystkie ustawienia użytkowników komputera są przechowywane w gałęzi rejestru oznaczonej akronimem

Do serwisu komputerowego przyniesiono laptopa, którego matryca wyświetla obraz w bardzo słabej jakości. Dodatkowo obraz jest znacząco ciemny i widoczny jedynie z niewielkiej odległości. Co może być przyczyną tej usterki?

Instalacja systemów Linux oraz Windows 7 przebiegła bez żadnych problemów. Systemy zainstalowały się poprawnie z domyślnymi ustawieniami. Na tym samym komputerze, przy tej samej konfiguracji, podczas instalacji systemu Windows XP pojawił się komunikat o braku dysków twardych, co może sugerować

W systemie Linux, aby uzyskać informację o nazwie aktualnego katalogu roboczego, należy użyć polecenia

Jakie rozszerzenia mają pliki instalacyjne systemu operacyjnego Linux?

Na ilustracji przedstawiono ustawienie karty sieciowej, której adres MAC wynosi

Ethernet adapter VirtualBox Host-Only Network:

Connection-specific DNS Suffix . :

Description . . . . . . . . . . . : VirtualBox Host-Only Ethernet Adapter

Physical Address. . . . . . . . . : 0A-00-27-00-00-07

DHCP Enabled. . . . . . . . . . . : No

Autoconfiguration Enabled . . . . : Yes

Link-local IPv6 Address . . . . . : fe80::e890:be2b:4c6c:5aa9%7(Preferred)

IPv4 Address. . . . . . . . . . . : 192.168.56.1(Preferred)

Subnet Mask . . . . . . . . . . . : 255.255.255.0

Default Gateway . . . . . . . . . :

DHCPv6 IAID . . . . . . . . . . . : 134873127

DHCPv6 Client DUID. . . . . . . . : 00-01-00-01-1F-04-2D-93-00-1F-D0-0C-7B-12

DNS Servers . . . . . . . . . . . : fec0:0:0:ffff::1%1

fec0:0:0:ffff::2%1

fec0:0:0:ffff::3%1

NetBIOS over Tcpip. . . . . . . . : EnabledSerwer, który realizuje żądania w protokole komunikacyjnym HTTP, to serwer

W przypadku sieci strukturalnej rekomendowane jest zainstalowanie jednego punktu abonenckiego na obszarze wynoszącym

Brak odpowiedzi na to pytanie.

Fragment konfiguracji pliku httpd.conf dla serwera Apache wygląda następująco Listen 8012 Server Name localhost:8012 Aby zweryfikować prawidłowe działanie witryny WWW na serwerze, należy wpisać w przeglądarkę

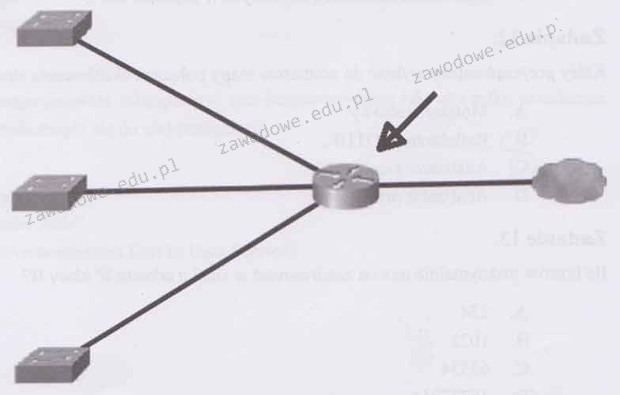

Którego urządzenia dotyczy strzałka na rysunku?

Kiedy użytkownik wprowadza w wierszu poleceń komendę ping www.onet.pl, otrzymuje komunikat: "Żądanie polecenia ping nie może znaleźć hosta www.onet.pl. Sprawdź nazwę i ponów próbę." Natomiast po wpisaniu polecenia ping 213.180.141.140 (adres IP serwera www.onet.pl) użytkownik otrzymuje odpowiedź z serwera. Jakie mogą być przyczyny tego zjawiska?

W wyniku wykonania przedstawionych poleceń systemu Linux interfejs sieciowy eth0 otrzyma:

ifconfig eth0 10.0.0.100 netmask 255.255.255.0 broadcast 10.0.0.255 up route add default gw 10.0.0.10

W sieci o adresie 192.168.20.0 użyto maski podsieci 255.255.255.248. Jak wiele adresów IP będzie dostępnych dla urządzeń?

Okablowanie strukturalne klasyfikuje się jako część infrastruktury

Brak odpowiedzi na to pytanie.

Aby umożliwić wymianę informacji pomiędzy sieciami VLAN, wykorzystuje się

Brak odpowiedzi na to pytanie.

Który z zapisów adresu IPv4 z maską jest niepoprawny?

Zanim przystąpisz do modernizacji komputerów osobistych oraz serwerów, polegającej na dodaniu nowych modułów pamięci RAM, powinieneś zweryfikować

Jakie polecenie pozwala na przeprowadzenie aktualizacji do nowszej wersji systemu Ubuntu Linux?

Podaj domyślny port używany do przesyłania poleceń (command) w serwerze FTP

Jakie połączenie bezprzewodowe należy zastosować, aby mysz mogła komunikować się z komputerem?

Fizyczna architektura sieci, inaczej określana jako topologia fizyczna sieci komputerowych, definiuje

Na dysku należy umieścić 100 tysięcy oddzielnych plików, z których każdy ma rozmiar 2570 bajtów. W takim przypadku, zapisane pliki będą zajmować najmniej miejsca na dysku z jednostką alokacji wynoszącą

Program do diagnostyki komputera pokazał komunikat NIC ERROR. Co oznacza ten komunikat w kontekście uszkodzenia karty?

Do czynności konserwacyjnych związanych z użytkowaniem skanera płaskiego należy

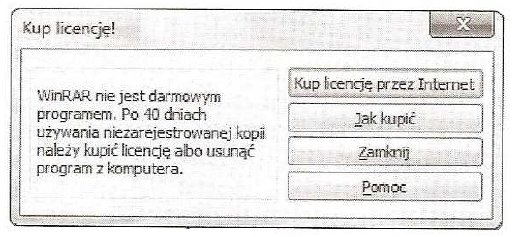

Program WinRaR pokazał okno informacyjne przedstawione na ilustracji. Jakiego rodzaju licencję na oprogramowanie użytkownik stosował do tej pory?

Wskaż sygnał informujący o błędzie karty graficznej w komputerze z BIOS POST od firmy AWARD?

Która z konfiguracji RAID opiera się na replikacji danych pomiędzy dwoma lub większą liczbą dysków fizycznych?

Instalacja systemów Linux oraz Windows 7 odbyła się bez żadnych problemów. Systemy zainstalowały się prawidłowo z domyślnymi konfiguracjami. Na tym samym komputerze, przy tej samej specyfikacji, podczas instalacji systemu Windows XP pojawił się komunikat o braku dysków twardych, co może sugerować

Wskaż technologię stosowaną do zapewnienia dostępu do Internetu w połączeniu z usługą telewizji kablowej, w której światłowód oraz kabel koncentryczny pełnią rolę medium transmisyjnego

Gdy użytkownik wykonuje w wierszu poleceń komendę ping www.onet.pl, otrzymuje komunikat: "Żądanie polecenia ping nie może znaleźć hosta www.onet.pl Sprawdź nazwę i ponów próbę". Z kolei, po wpisaniu w wierszu poleceń komendy ping 213.180.141.140 (adres IP serwera www.onet.pl), użytkownik otrzymuje odpowiedź z serwera. Jakie mogą być przyczyny tej sytuacji?

Co jest głównym zadaniem protokołu DHCP?

Aby w systemie Windows Professional ustawić czas pracy drukarki oraz uprawnienia drukowania, należy skonfigurować

Najefektywniejszym zabezpieczeniem danych firmy, której siedziby znajdują się w różnych, odległych od siebie lokalizacjach, jest zastosowanie

Funkcja failover usługi DHCP umożliwia

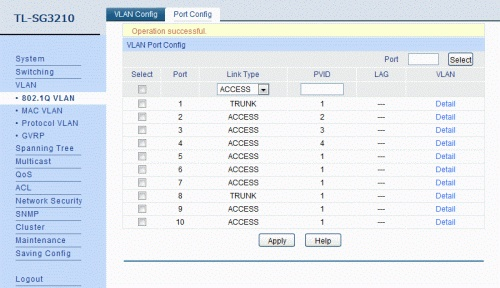

Na ilustracji przedstawiono konfigurację przełącznika z utworzonymi sieciami VLAN. Którymi portami można przesyłać oznaczone ramki z różnych sieci VLAN?

Bezprzewodową komunikację komputerów w sieci lokalnej zapewnia