Pytanie 1

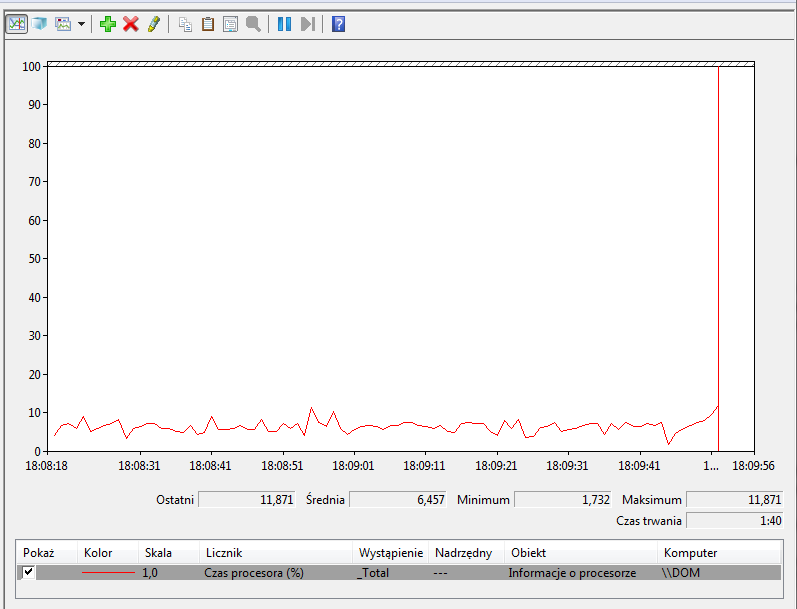

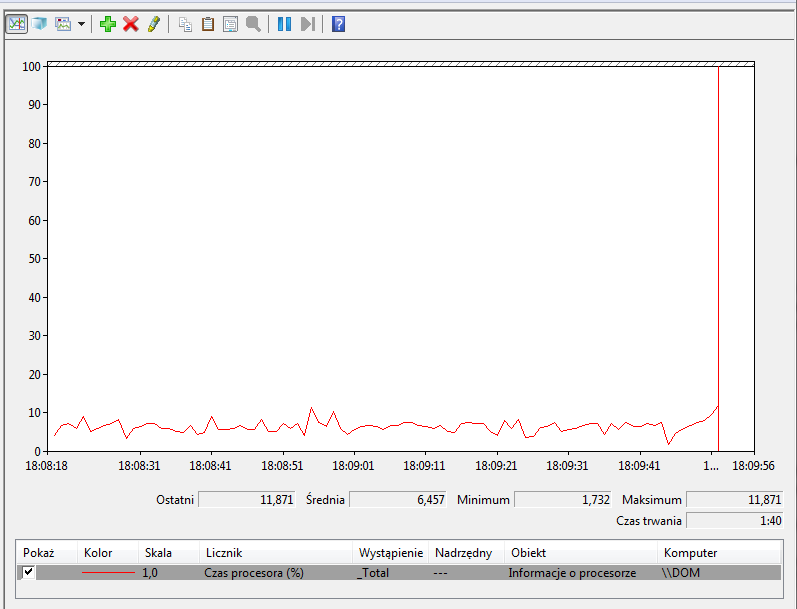

By uruchomić w systemie Windows oprogramowanie narzędziowe monitorujące wydajność komputera przedstawione na rysunku, należy uruchomić

Wynik: 28/40 punktów (70,0%)

Wymagane minimum: 20 punktów (50%)

By uruchomić w systemie Windows oprogramowanie narzędziowe monitorujące wydajność komputera przedstawione na rysunku, należy uruchomić

Przesyłanie danych przez router, które wiąże się ze zmianą adresów IP źródłowych lub docelowych, określa się skrótem

Aby zweryfikować schemat połączeń kabla UTP Cat 5e w sieci lokalnej, należy zastosować

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Aby uzyskać największą prędkość przepływu danych w przypadku, gdy domowy ruter pracuje w paśmie częstotliwości 5 GHz, do notebooka powinno się zamontować bezprzewodową kartę sieciową pracującą w standardzie

W systemie Linux do śledzenia wykorzystania procesora, pamięci, procesów oraz obciążenia systemu wykorzystuje się polecenie

Który z protokołów nie działa w warstwie aplikacji modelu ISO/OSI?

Interfejs, którego magistrala kończy się elementem przedstawionym na ilustracji, jest typowy dla

Jakie złącze powinna posiadać karta graficzna, aby umożliwić przesyłanie cyfrowego sygnału audio i wideo bez utraty jakości z komputera do zewnętrznego urządzenia, które jest podłączone do jej wyjścia?

Najwyższą prędkość transmisji danych w sieci bezprzewodowej zapewnia standard

Zrzut ekranu przedstawiony powyżej, który pochodzi z systemu Windows, stanowi efekt działania komendy

Aktywne połączenia Protokół Adres lokalny Obcy adres Stan TCP 127.0.0.1:12295 Admin-Komputer:54013 CZAS_OCZEKIWANIA TCP 127.0.0.1:53778 Admin-Komputer:54015 CZAS_OCZEKIWANIA TCP 127.0.0.1:53778 Admin-Komputer:53779 USTANOWIONO TCP 127.0.0.1:53779 Admin-Komputer:53778 USTANOWIONO TCP 127.0.0.1:53780 Admin-Komputer:53781 USTANOWIONO TCP 127.0.0.1:53781 Admin-Komputer:53780 USTANOWIONO TCP 127.0.0.1:53786 Admin-Komputer:53787 USTANOWIONO TCP 127.0.0.1:53787 Admin-Komputer:53786 USTANOWIONO TCP 127.0.0.1:53796 Admin-Komputer:53797 USTANOWIONO TCP 127.0.0.1:53797 Admin-Komputer:53796 USTANOWIONO TCP 127.0.0.1:53974 Admin-Komputer:53975 USTANOWIONO TCP 127.0.0.1:53976 Admin-Komputer:53975 USTANOWIONO

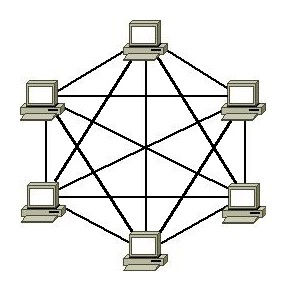

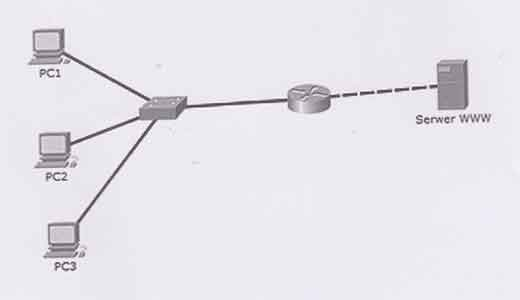

Jakiego rodzaju fizyczna topologia sieci komputerowej jest zobrazowana na rysunku?

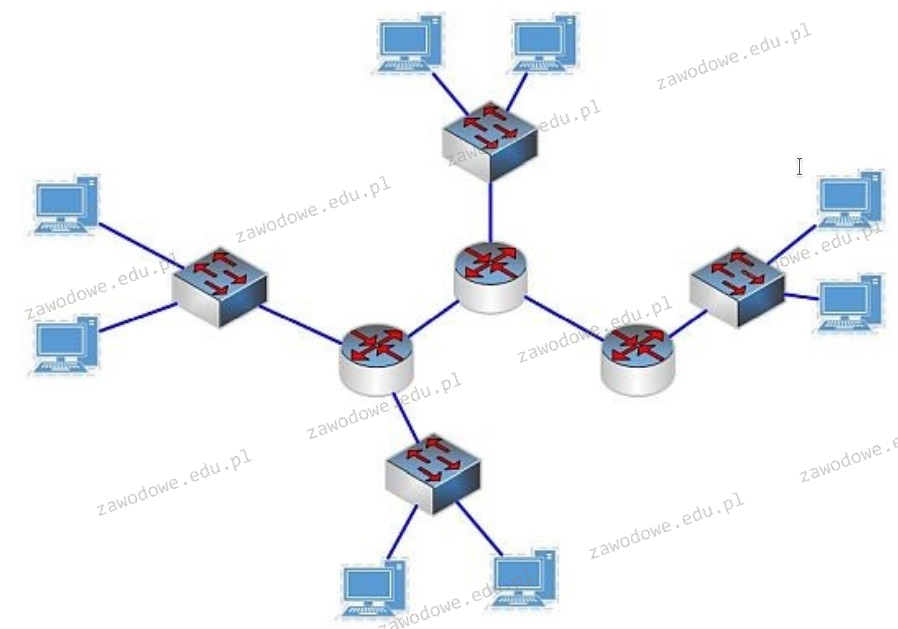

Na diagramie przedstawione są symbole

Thunderbolt stanowi interfejs

Co oznacza zapis 192.168.1/24 w kontekście maski podsieci?

Jakie polecenie w systemie Windows należy wpisać w miejsce kropek, aby uzyskać dane przedstawione na załączonym obrazku?

C:\Windows\system32> ................... Nazwa użytkownika Gość Pełna nazwa Komentarz Wbudowane konto do dostępu do komputera/domeny Komentarz użytkownika Kod kraju 000 (Domyślne ustawienia systemu) Konto jest aktywne Nie Wygasanie konta Nigdy Hasło ostatnio ustawiano 2019-11-23 10:55:12 Ważność hasła wygasa Nigdy Hasło może być zmieniane 2019-12-02 10:55:12 Wymagane jest hasło Nie Użytkownik może zmieniać hasło Nie Dozwolone stacje robocze Wszystkie Skrypt logowania Profil użytkownika Katalog macierzysty Ostatnie logowanie Nigdy Dozwolone godziny logowania Wszystkie Członkostwa grup lokalnych *Goście Członkostwa grup globalnych *None Polecenie zostało wykonane pomyślnie. C:\Windows\system32>

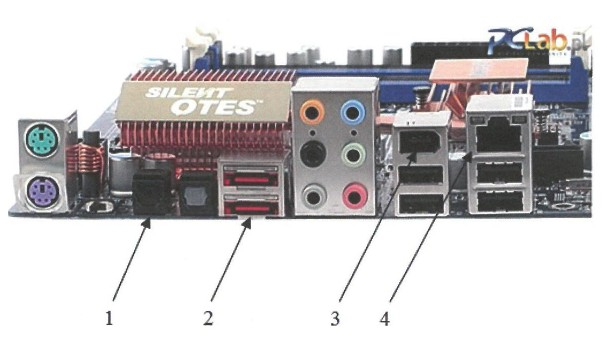

Który z portów na zaprezentowanej płycie głównej umożliwia podłączenie zewnętrznego dysku przez interfejs e-SATA?

Jakie jest zastosowanie maty antystatycznej oraz opaski podczas instalacji komponentu?

Aby utworzyć obraz dysku twardego, można skorzystać z programu

Aby zapewnić możliwość odzyskania ważnych danych, należy regularnie

Rodzaj przesyłania danych do jednego lub wielu komputerów jednocześnie, w którym odbiorcy są postrzegani przez nadawcę jako jedyny zbiorczy odbiorca, to

Jakie polecenie w systemie Linux jest używane do sprawdzania wielkości katalogu?

Aby kontrolować ilość transferu w sieci, administrator powinien zastosować program rodzaju

Wykorzystanie polecenia net accounts w konsoli systemu Windows, które ustawia maksymalny okres ważności hasła, wymaga zastosowania opcji

Użytkownicy w sieci lokalnej mogą się komunikować między sobą, lecz nie mają możliwości połączenia z serwerem WWW. Wynik polecenia ping z komputerów do bramy jest pozytywny. Który element sieci nie może być źródłem problemu?

Jakim parametrem definiuje się stopień zmniejszenia mocy sygnału w danej parze przewodów po przejściu przez cały tor kablowy?

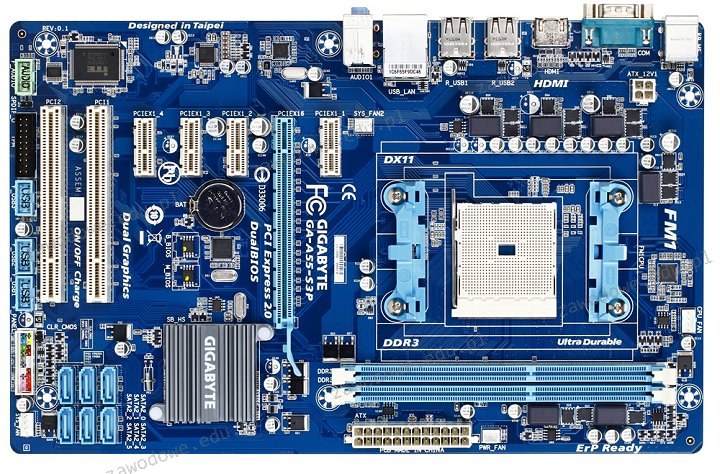

Jakim interfejsem można przesyłać dane między płyta główną, przedstawioną na ilustracji, a urządzeniem zewnętrznym, nie zasilając jednocześnie tego urządzenia przez ten interfejs?

Rekord startowy dysku twardego w komputerze to

Wskaż symbol umieszczany na urządzeniach elektrycznych przeznaczonych do sprzedaży i obrotu w Unii Europejskiej?

Jaka jest prędkość przesyłania danych w standardzie 1000Base-T?

Ile maksymalnie podstawowych partycji możemy stworzyć na dysku twardym używając MBR?

Która z poniższych wskazówek nie jest właściwa w kontekście konserwacji skanera płaskiego?

W dokumentacji technicznej procesora znajdującego się na płycie głównej komputera, jaką jednostkę miary stosuje się do określenia szybkości zegara?

Która z podanych właściwości kabla koncentrycznego RG-58 sprawia, że obecnie nie jest on używany do tworzenia lokalnych sieci komputerowych?

Jaki jest największy rozmiar pojedynczego datagramu IPv4, uwzględniając jego nagłówek?

Aby przywrócić dane, które zostały usunięte dzięki kombinacji klawiszy Shift+Delete, trzeba

Wykonanie na komputerze z systemem Windows poleceń ipconfig /release oraz ipconfig /renew umożliwia weryfikację, czy usługa w sieci działa poprawnie

W systemie Linux do monitorowania użycia procesora, pamięci, procesów i obciążenia systemu służy polecenie

Jakie jest zadanie programu Wireshark?

Aby sprawdzić, czy zainstalowana karta graficzna w komputerze jest przegrzewana, użytkownik ma możliwość użycia programu