Pytanie 1

Thunderbolt to interfejs

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Thunderbolt to interfejs

Dostosowanie ustawień parametrów TCP/IP urządzenia na podstawie adresu MAC karty sieciowej jest funkcją protokołu

Aby sprawdzić minimalny czas ważności hasła w systemie Windows, stosuje się polecenie

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Który z poniższych mechanizmów zapewni najwyższy stopień ochrony sieci bezprzewodowych w standardzie 802.11n?

Jaki protokół mailowy pozwala między innymi na przechowywanie odbieranych wiadomości e-mail na serwerze, zarządzanie wieloma katalogami, usuwanie wiadomości oraz przenoszenie ich pomiędzy katalogami?

Użytkownicy sieci WiFi zauważyli problemy oraz częste zrywanie połączenia z internetem. Co może być przyczyną tej sytuacji?

Na ilustracji pokazano część efektu działania programu przeznaczonego do testowania sieci. Sugeruje to użycie polecenia diagnostycznego w sieci

TCP 192.168.0.13:51614 bud02s23-in-f8:https ESTABLISHED TCP 192.168.0.13:51615 edge-star-mini-shv-01-ams3:https ESTABLISHED TCP 192.168.0.13:51617 93.184.220.29:http ESTABLISHED TCP 192.168.0.13:51619 93.184.220.29:http ESTABLISHED TCP 192.168.0.13:51620 93.184.220.29:http TIME_WAIT TCP 192.168.0.13:51621 bud02s23-in-f206:https TIME_WAIT TCP 192.168.0.13:51622 xx-fbcdn-shv-01-ams3:https ESTABLISHED TCP 192.168.0.13:51623 108.161.188.192:https ESTABLISHED TCP 192.168.0.13:51626 23.111.9.32:https TIME_WAIT TCP 192.168.0.13:51628 lg-in-f155:https ESTABLISHED TCP 192.168.0.13:51629 waw02s06-in-f68:https ESTABLISHED

Analiza danych wyświetlonych przez program umożliwia stwierdzenie, że

Watomierz jest stosowany do pomiaru

Domyślnie w programie Eksplorator Windows przy użyciu klawisza F5 uruchamiana jest funkcja

Aby stworzyć archiwum danych w systemie operacyjnym Ubuntu, należy użyć programu

Rozkaz procesora, przetwarzający informację i zamieniający ją na wynik, należy do grupy rozkazów

Po przeprowadzeniu diagnostyki komputerowej ustalono, że temperatura pracy karty graficznej z wyjściami HDMI oraz D-SUB, zainstalowanej w gnieździe PCI Express komputera stacjonarnego, wynosi 87°C. W związku z tym, serwisant powinien

Który z wymienionych interfejsów stanowi port równoległy?

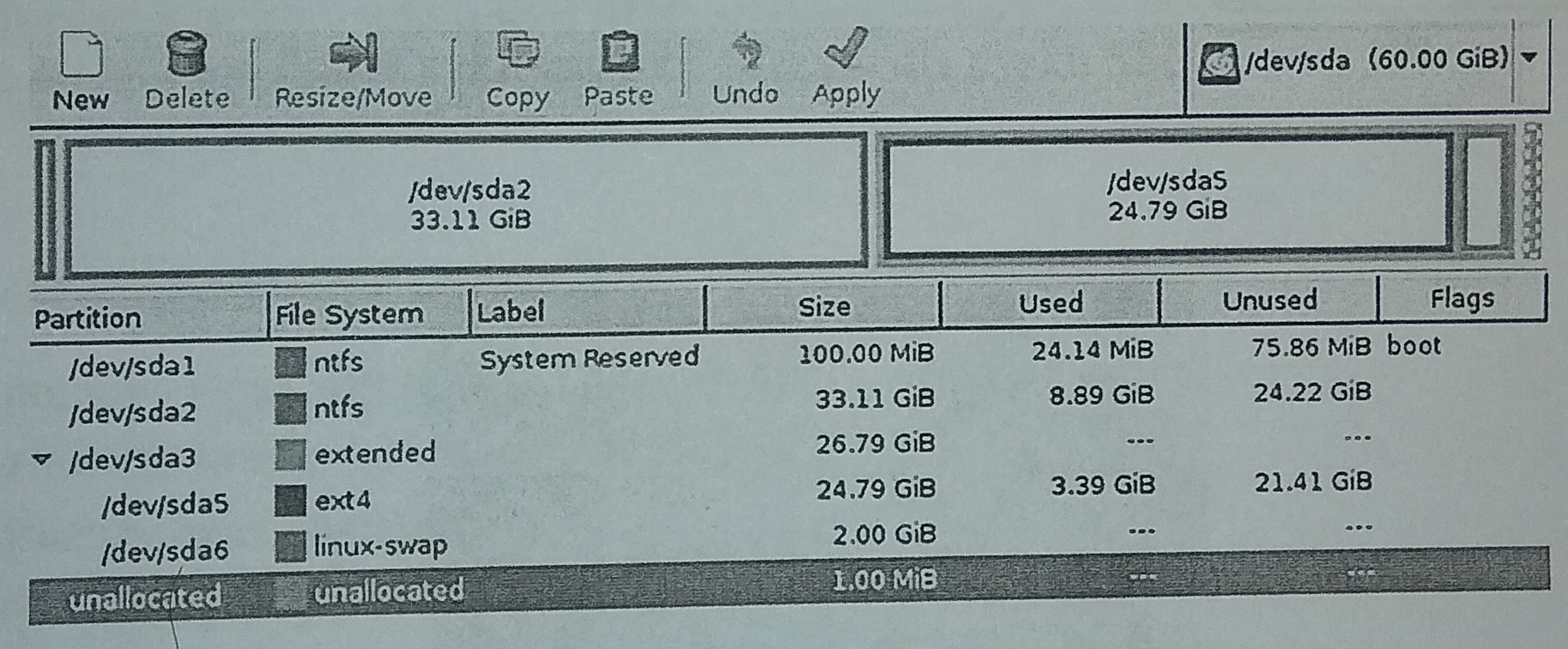

Na komputerze z zainstalowanymi systemami operacyjnymi Windows i Linux, po przeprowadzeniu reinstalacji systemu Windows, drugi system przestaje się uruchamiać. Aby przywrócić możliwość uruchamiania systemu Linux oraz zachować dane i ustawienia w nim zgromadzone, co należy zrobić?

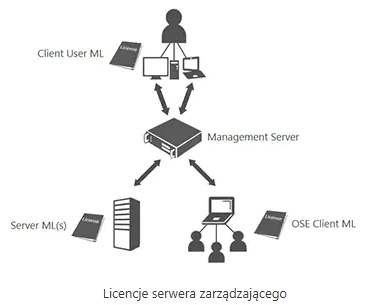

Wskaż model licencjonowania serwera zarządzającego (Management Serwer), oferowanego firmom przez Microsoft, którego schemat przedstawiono na ilustracji.

Jakie informacje można uzyskać za pomocą programu Wireshark?

Zaprezentowany komputer jest niepełny. Który z komponentów nie został wymieniony w tabeli, a jest kluczowy dla poprawnego funkcjonowania zestawu i powinien być dodany?

| Lp. | Nazwa podzespołu |

|---|---|

| 1. | Cooler Master obudowa komputerowa CM Force 500W czarna |

| 2. | Gigabyte GA-H110M-S2H, Realtek ALC887, DualDDR4-2133, SATA3, HDMI, DVI, D-Sub, LGA1151, mATX |

| 3. | Intel Core i5-6400, Quad Core, 2.70GHz, 6MB, LGA1151, 14nm, 65W, Intel HD Graphics, VGA, TRAY/OEM |

| 4. | Patriot Signature DDR4 2x4GB 2133MHz |

| 5. | Seagate BarraCuda, 3,5", 1TB, SATA/600, 7200RPM, 64MB cache |

| 6. | LG SuperMulti SATA DVD+/-R24x,DVD+RW6x,DVD+R DL 8x, bare bulk (czarny) |

| 7. | Gembird Bezprzewodowy Zestaw Klawiatura i Mysz |

| 8. | Monitor Iiyama E2083HSD-B1 19.5inch, TN, HD+, DVI, głośniki |

| 9. | Microsoft OEM Win Home 10 64Bit Polish 1pk DVD |

Które z urządzeń nie powinno być serwisowane podczas korzystania z urządzeń antystatycznych?

Podczas uruchamiania (krótko po zakończeniu testu POST) komputer się zawiesza. Jakie mogą być możliwe przyczyny tej awarii?

Tester strukturalnego okablowania umożliwia weryfikację

Wymianę uszkodzonych kondensatorów karty graficznej umożliwi

Jaki standard szyfrowania powinien być wybrany przy konfiguracji karty sieciowej, aby zabezpieczyć transmisję w sieci bezprzewodowej?

Jaką częstotliwość odświeżania należy ustawić, aby obraz na monitorze był odświeżany 85 razy na sekundę?

Do interfejsów pracujących równolegle należy interfejs

Jakie polecenie w terminalu systemu operacyjnego Microsoft Windows umożliwi wyświetlenie szczegółów wszystkich zasobów udostępnionych na komputerze lokalnym?

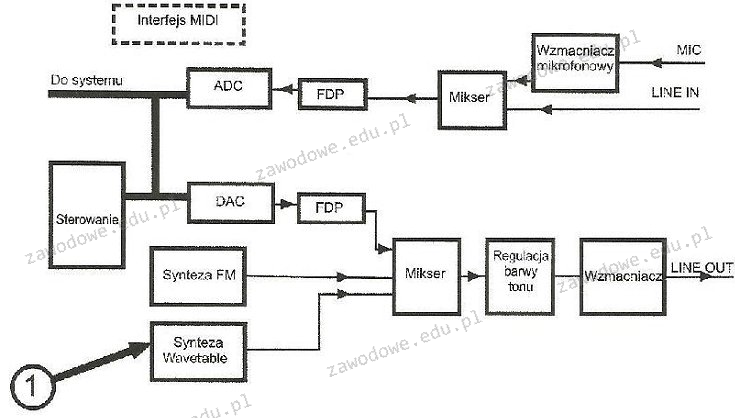

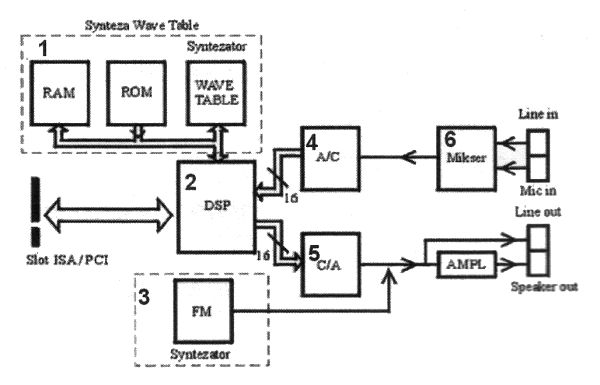

Element wskazany cyfrą 1 na diagramie karty dźwiękowej?

Wartość liczby 1100112 zapisanej w systemie dziesiętnym wynosi

Którą czynność należy wykonać podczas konfiguracji rutera, aby ukryta sieć bezprzewodowa była widoczna dla wszystkich użytkowników znajdujących się w jej zasięgu?

Programem wiersza poleceń w systemie Windows, który umożliwia kompresję oraz dekompresję plików i folderów, jest aplikacja

W jakim systemie występuje jądro hybrydowe (kernel)?

Na diagramie blokowym karty dźwiękowej komponent odpowiedzialny za konwersję sygnału analogowego na cyfrowy jest oznaczony numerem

W systemie Windows, aby uruchomić usługę związaną z wydajnością komputera, należy użyć polecenia

Kable łączące dystrybucyjne punkty kondygnacyjne z głównym punktem dystrybucji są określane jako

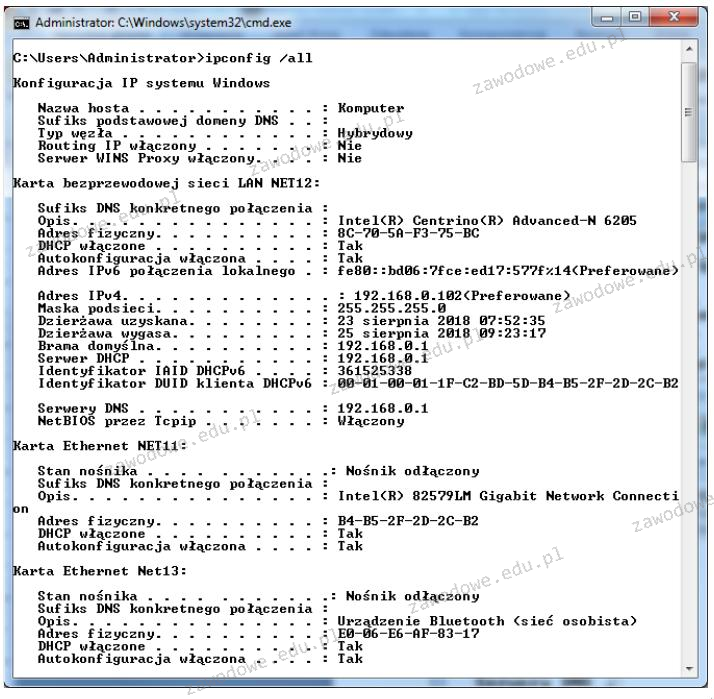

Analizując przedstawione wyniki konfiguracji zainstalowanych kart sieciowych w komputerze, można zauważyć, że

Jakie polecenie w systemie operacyjnym Linux służy do monitorowania komunikacji pakietów TCP/IP lub protokołów wysyłanych lub odbieranych w sieci komputerowej, do której podłączony jest komputer użytkownika?

Do konserwacji elementów optycznych w komputerach zaleca się zastosowanie

Wykonując polecenie ipconfig /flushdns, można przeprowadzić konserwację urządzenia sieciowego, która polega na

Metoda przesyłania danych między urządzeniem CD/DVD a pamięcią komputera w trybie bezpośredniego dostępu do pamięci to