Pytanie 1

Który adres IP jest najwyższy w sieci 196.10.20.0/26?

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Który adres IP jest najwyższy w sieci 196.10.20.0/26?

Jakim protokołem połączeniowym w warstwie transportowej, który zapewnia niezawodność dostarczania pakietów, jest protokół

Jaką usługą można pobierać i przesyłać pliki na serwer?

Przygotowując ranking dostawców łączy internetowych należy zwrócić uwagę, aby jak najmniejsze wartości miały parametry

Norma EN 50167 odnosi się do rodzaju okablowania

Przedstawiony symbol znajdujący się na obudowie komputera stacjonarnego oznacza ostrzeżenie przed

Jaką rolę pełni serwer plików w sieciach komputerowych LAN?

Na płycie głównej uszkodzona została zintegrowana karta sieciowa. Komputer nie ma zainstalowanego dysku twardego ani żadnych innych napędów, takich jak stacja dysków czy CD-ROM. Klient informuje, że w firmowej sieci komputery nie mają napędów, a wszystko "czyta" się z serwera. W celu przywrócenia utraconej funkcji należy zainstalować

Która z usług serwerowych oferuje automatyczne ustawienie parametrów sieciowych dla stacji roboczych?

Liczba \( 10_{D} \) w systemie uzupełnień do dwóch jest równa

W systemie Windows XP, aby zmienić typ systemu plików z FAT32 na NTFS, należy użyć programu

Który rekord DNS powinien zostać dodany w strefie wyszukiwania do przodu, aby skojarzyć nazwę domeny DNS z adresem IP?

Zamieszczone atrybuty opisują rodzaj pamięci

| Maksymalne taktowanie | 1600 MHz |

| Przepustowość | PC12800 1600MHz |

| Opóźnienie | Cycle Latency CL 9,0 |

| Korekcja | Nie |

| Dual/Quad | Dual Channel |

| Radiator | Tak |

Który z poniższych protokołów należy do warstwy aplikacji w modelu ISO/OSI?

Na ilustracji ukazano port w komputerze, który służy do podłączenia

Która z możliwości konfiguracji ustawień dla użytkownika z ograniczonymi uprawnieniami w systemie Windows jest oferowana przez przystawkę secpol?

Podstawowym warunkiem archiwizacji danych jest

Złącze SC stanowi standard w cablach

Który z rodzajów rekordów DNS w systemach Windows Server określa alias (inną nazwę) dla rekordu A związanej z kanoniczną (rzeczywistą) nazwą hosta?

Aby dostęp do systemu Windows Serwer 2016 był możliwy dla 50 urządzeń, bez względu na liczbę użytkowników, należy w firmie zakupić licencję

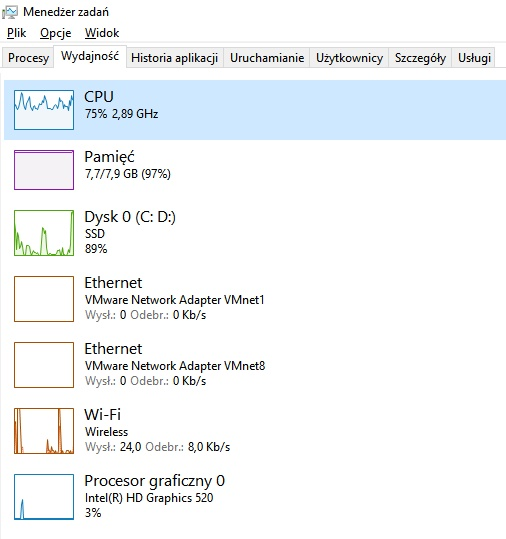

Grafik komputerowy sygnalizuje bardzo wolną pracę komputera. Z ilustracji przedstawiającej okno wydajności komputera wynika, że przyczyną tego może być

Co należy zrobić, gdy podczas uruchamiania komputera procedura POST zgłosi błąd odczytu lub zapisu w pamięci CMOS?

Który z podanych adresów protokołu IPv4 jest adresem klasy D?

Która karta graficzna nie będzie kompatybilna z monitorem, który posiada złącza pokazane na zdjęciu, przy założeniu, że do podłączenia monitora nie użyjemy adaptera?

Jaką maksymalną liczbę hostów można przypisać w sieci o adresie IP klasy B?

Jakie środowisko powinien wybrać administrator sieci, aby zainstalować serwer dla stron WWW w systemie Linux?

Które z metod szyfrowania wykorzystywanych w sieciach bezprzewodowych jest najsłabiej zabezpieczone przed łamaniem haseł?

Najczęstszym powodem rozmazywania się tonera na wydrukach z drukarki laserowej jest

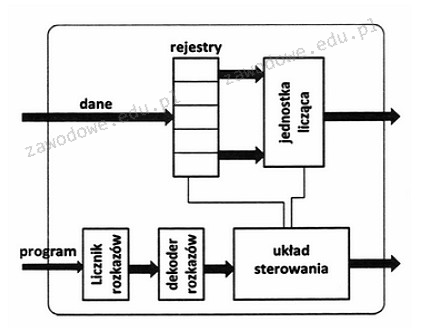

Na schemacie procesora rejestry mają za zadanie przechowywać adres do

Jak należy ustawić w systemie Windows Server 2008 parametry protokołu TCP/IP karty sieciowej, aby komputer mógł jednocześnie łączyć się z dwiema różnymi sieciami lokalnymi posiadającymi odrębne adresy IP?

W systemie Windows, gdzie należy ustalić wymagania dotyczące złożoności hasła?

Który z poniższych protokołów nie jest wykorzystywany do konfiguracji wirtualnej sieci prywatnej?

Wartość koloru RGB(255, 170, 129) odpowiada zapisie

Symbol graficzny przedstawiony na rysunku wskazuje na opakowanie

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Podczas wyboru zasilacza do komputera kluczowe znaczenie

Jeśli rozdzielczość myszki wynosi 200 dpi, a rozdzielczość monitora to Full HD, to aby przesunąć kursor w poziomie po ekranie, należy przemieścić mysz o

Aby zidentyfikować, który program najbardziej obciąża CPU w systemie Windows, należy otworzyć program

Jakiego rodzaju interfejsem jest UDMA?

Tworzenie zaszyfrowanych połączeń pomiędzy hostami przez publiczną sieć Internet, wykorzystywane w rozwiązaniach VPN (Virtual Private Network), to