Pytanie 1

W radiologii analogowej lampy rentgenowskiej z tubusem używa się do wykonania zdjęcia

Wynik: 24/40 punktów (60,0%)

Wymagane minimum: 20 punktów (50%)

W radiologii analogowej lampy rentgenowskiej z tubusem używa się do wykonania zdjęcia

W badaniu MR czas repetycji TR jest parametrem określającym odstęp czasu między

Hiperfrakcjonowanie dawki w radioterapii oznacza napromieniowywanie pacjenta

W radioterapii hadronowej leczenie odbywa się przy użyciu

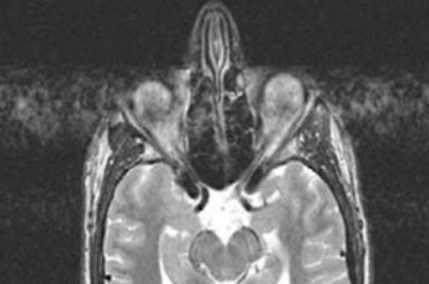

Co jest przyczyną artefaktu widocznego na obrazie MR?

Glukoza podawana pacjentowi w badaniu PET jest znakowana radioaktywnym

W diagnostyce metodą rezonansu magnetycznego biorą udział

Największa wartość energii promieniowania stosowanego w radioterapii jest generowana przy użyciu

Dawka graniczna wyrażona jako dawka skuteczna (efektywna), dla osób zawodowo narażonych na działanie promieniowania jonizującego wynosi w ciągu roku kalendarzowego

Zwiększenie napięcia na lampie rentgenowskiej powoduje

Promieniowanie rentgenowskie powstaje w wyniku hamowania

Która sekwencja obrazowania MR wykorzystuje impulsy RF o częstotliwości rezonansowej tłuszczu do tłumienia sygnału pochodzącego z tkanki tłuszczowej?

W metodzie RM (rezonansu magnetycznego) po umieszczeniu pacjenta w silnym, stałym polu magnetycznym dochodzi do oddziaływania

Wysoką rozdzielczość przestrzenną obrazowania MR uzyskuje się przez

Pracownia radioterapii z przyspieszaczem liniowym jest obszarem

Testy podstawowe z zakresu geometrii pola rentgenowskiego, przeznaczone do sprawdzenia zgodności pola wiązki promieniowania rentgenowskiego z symulacją świetlną, są wykonywane raz

Z kratką przeciwrozproszeniową należy wykonać zdjęcie

W trakcie obrazowania metodą rezonansu magnetycznego wykorzystywane jest zjawisko wysyłania sygnału emitowanego przez

W radioterapii konwencjonalnej pacjent jest leczony promieniowaniem pochodzącym

W lampie rentgenowskiej promieniowanie X powstaje w wyniku hamowania

Teleradioterapia 4D na etapie planowania leczenia wykorzystuje obrazy

W sekwencji echa spinowego obraz T2-zależny uzyskuje się przy czasie repetycji TR

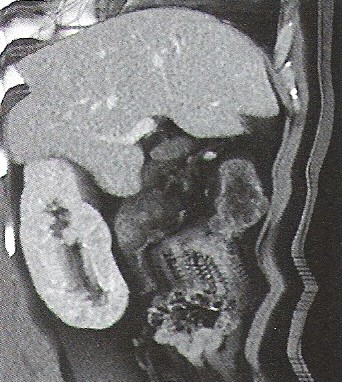

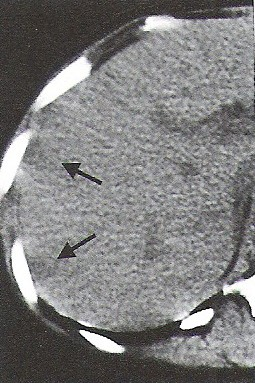

Na którym obrazie TK uwidoczniony jest artefakt spowodowany ruchami oddechowymi pacjenta?

Nieostrość geometryczna obrazu rentgenowskiego zależy od

Nieostrość geometryczna obrazu rentgenowskiego zależy od

W której technice brachyterapii stosuje się źródła promieniowania o mocy dawki 2-12 Gy/h?

W medycznym przyspieszaczu liniowym jest generowana wiązka fotonów o energii w zakresie

W ultrasonografii występuje zależność:

W obrazowaniu metodą rezonansu magnetycznego T1 oznacza czas

Więzka promieniowania X to

W radiografii mianem SID określa się

Emisja fali elektromagnetycznej występuje w procesie rozpadu promieniotwórczego

Hiperfrakcjonowanie dawki w teleradioterapii polega na napromienianiu 2 do 3 razy dziennie dawką frakcyjną

Zgodnie z obowiązującymi przepisami powierzchnia gabinetu rentgenowskiego, w którym jest zainstalowany zestaw rentgenowski do badań naczyniowych, powinna wynosić

Źródłem promieniowania protonowego stosowanego w radioterapii jest

Diagnozowanie metodą PET oparte jest na zjawisku

Promieniowanie rentgenowskie jest

Gadolin jako dożylny środek kontrastowy stosowany w MR powoduje

Brachyterapia polegająca na wielokrotnym wsuwaniu i wysuwaniu źródła promieniowania do tego samego aplikatora nosi nazwę

Która struktura może być oknem akustycznym w badaniu ultrasonograficznym?