Pytanie 1

Pierwszym krokiem koniecznym do ochrony rutera przed nieautoryzowanym dostępem do jego panelu konfiguracyjnego jest

Wynik: 17/40 punktów (42,5%)

Wymagane minimum: 20 punktów (50%)

Pierwszym krokiem koniecznym do ochrony rutera przed nieautoryzowanym dostępem do jego panelu konfiguracyjnego jest

Jak można przywrócić domyślne ustawienia płyty głównej, gdy nie ma możliwości uruchomienia BIOS Setup?

Podczas realizacji projektu sieci komputerowej, pierwszym krokiem powinno być

Dysk zewnętrzny 3,5" o pojemności 5 TB, używany do archiwizacji lub wykonywania kopii zapasowych, wyposażony jest w obudowę z czterema interfejsami komunikacyjnymi do wyboru. Który z tych interfejsów powinien być użyty do podłączenia do komputera, aby uzyskać najwyższą prędkość transferu?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Napięcie dostarczane przez płytę główną dla pamięci typu SDRAM DDR3 może wynosić

Jakie znaczenie ma parametr LGA 775 zawarty w dokumentacji technicznej płyty głównej?

Jakie urządzenia wyznaczają granice domeny rozgłoszeniowej?

Urządzenie sieciowe funkcjonujące w trzeciej warstwie modelu ISO/OSI, posługujące się adresami IP, to

Do zarządzania przydziałami przestrzeni dyskowej w systemach Windows 7 oraz Windows 8 wykorzystywane jest narzędzie

W jakiej topologii sieci komputerowej każdy węzeł ma bezpośrednie połączenie z każdym innym węzłem?

Jakie porty powinny zostać zablokowane w firewallu, aby nie pozwolić na łączenie się z serwerem FTP?

W systemie Linux narzędzie fsck umożliwia

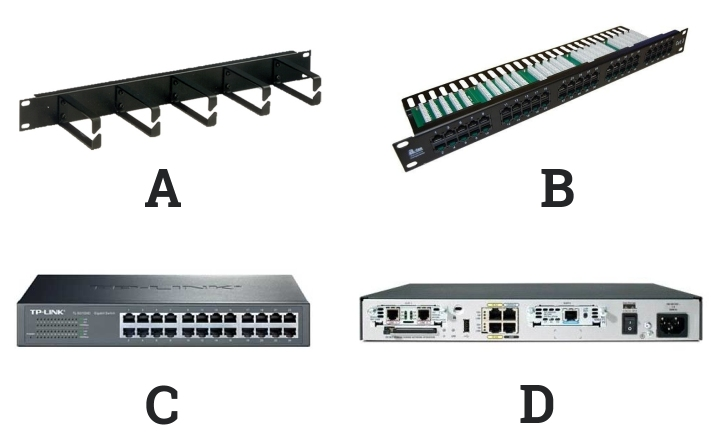

Na którym schemacie znajduje się panel krosowniczy?

echo off echo ola.txt >> ala.txt pauseJakie będą skutki wykonania podanego skryptu?

Największą pojemność spośród nośników optycznych posiada płyta

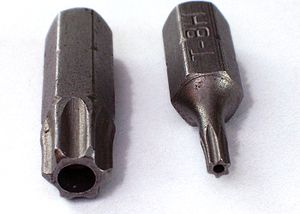

Na ilustracji przedstawiono końcówkę wkrętaka typu

Hosty A i B nie mają możliwości komunikacji z hostem C. Natomiast komunikacja między hostami A i B przebiega poprawnie. Jakie może być źródło problemu w komunikacji pomiędzy hostami A i C oraz B i C?

Jaką częstotliwość odświeżania należy ustawić, aby obraz na monitorze był odświeżany 85 razy na sekundę?

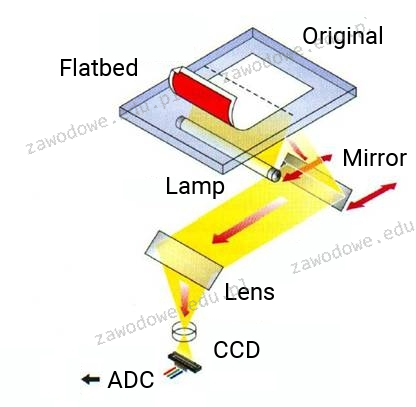

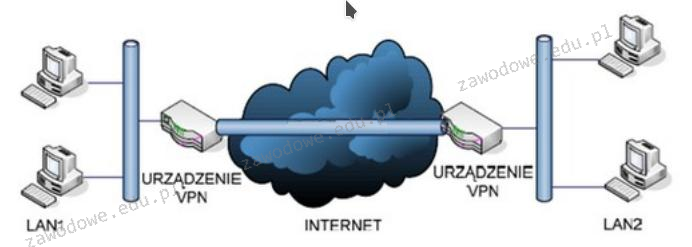

Zaprezentowany schemat ilustruje funkcjonowanie

Jakie parametry mierzy watomierz?

Wynikiem działania (10101101)₍₂₎ − (10100)₍₂₎ jest

Czynnikiem zagrażającym bezpieczeństwu systemu operacyjnego, który wymusza jego automatyczne aktualizacje, są

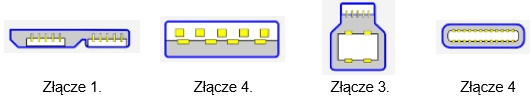

Wskaż kształt złącza USB typu C.

Na ilustracji przedstawiono fragment karty graficznej ze złączem

Jaką funkcjonalność oferuje program tar?

Przed dokonaniem zmian w rejestrze systemu Windows, w celu zapewnienia bezpieczeństwa pracy, należy najpierw

Złocenie styków złącz HDMI ma na celu

Jakie składniki systemu komputerowego wymagają utylizacji w wyspecjalizowanych zakładach przetwarzania z powodu obecności niebezpiecznych substancji lub pierwiastków chemicznych?

Jakie są korzyści płynące z użycia systemu plików NTFS?

W jaki sposób oznaczona jest skrętka bez zewnętrznego ekranu, mająca każdą parę w osobnym ekranie folii?

W przypadku okablowania strukturalnego opartego na skrętce UTP kat.6, jakie gniazda sieciowe powinny być używane?

Schemat ilustruje zasadę funkcjonowania sieci VPN o nazwie

Aby zmontować komputer z poszczególnych elementów, korzystając z obudowy SFF, trzeba wybrać płytę główną w formacie

Jakie będą całkowite wydatki na materiały potrzebne do stworzenia 20 kabli połączeniowych typu patchcord, z których każdy ma długość 1,5m, jeśli cena 1 metra bieżącego kabla wynosi 1zł, a cena wtyku to 50 gr?

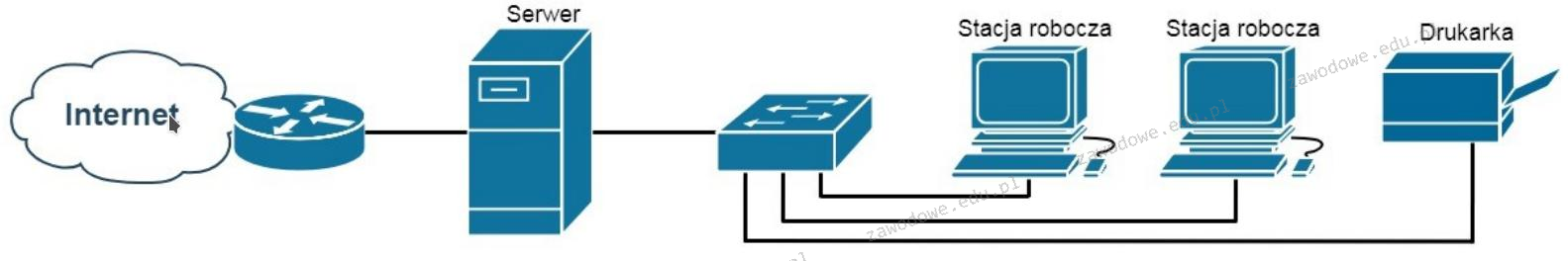

Która z usług na serwerze Windows umożliwi użytkownikom końcowym sieci zaprezentowanej na ilustracji dostęp do Internetu?

Wydanie w systemie Windows komendy ```ATTRIB -S +H TEST.TXT``` spowoduje

Aby umożliwić jedynie wybranym urządzeniom dostęp do sieci WiFi, konieczne jest w punkcie dostępowym

Które słowo należy umieścić w miejscu znaków zapytania w poniższym poleceniu, aby utworzyć konta pracowników?

for %i in (1, 2, 3, 4, 5, 6, 7, 8, 9, 10) do net ??? "pracownik%i" zaq1@WSX /add

Którą czynność należy wykonać podczas konfiguracji rutera, aby ukryta sieć bezprzewodowa była widoczna dla wszystkich użytkowników znajdujących się w jej zasięgu?