Pytanie 1

Na rysunku przedstawiono badanie za pomocą

Wynik: 39/40 punktów (97,5%)

Wymagane minimum: 20 punktów (50%)

Na rysunku przedstawiono badanie za pomocą

W celu archiwizacji danych w systemie Linux wymagane jest utworzenie archiwum. Korzystając z zamieszczonej w ramce pomocy dobierz odpowiednie polecenie.

| -c, --create | utworzenie nowego archiwum |

| -z, --gzip | filtrowanie archiwum przez gzip |

| -v, --verbose | wypisywanie szczegółów o przetwarzanych plikach |

| -f, --file=ARCHIWUM | użycie pliku lub urządzenia ARCHIWUM |

| -x, --extract | rozpakowanie plików z archiwum |

| -t, --list | wypisanie zawartości archiwum |

| -r, --append | dołączenie plików na końcu archiwum |

| -u, --update | dołączenie tylko plików nowszych niż kopie w archiwum |

Do kruszenia kamieni w pęcherzu moczowym stosowane są fale

Jak nazywa się w programowaniu obiektowym instancję klasy?

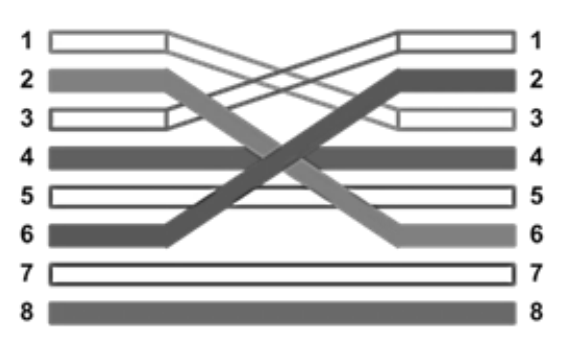

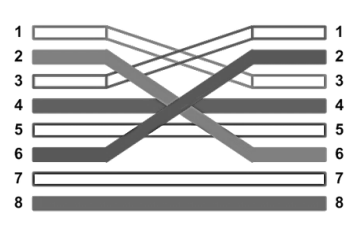

Przedstawiony na rysunku kabel krosowany jest wykorzystany do połączenia

Ilość jodu-131 podana pacjentowi w terapii tarczycy zmniejszy się o połowę po

Zjawisko polegające na zmianie częstotliwości fali odbitej od poruszającego się obiektu jest wykorzystywane w

Kabel krosowany jest wykorzystany do połączenia

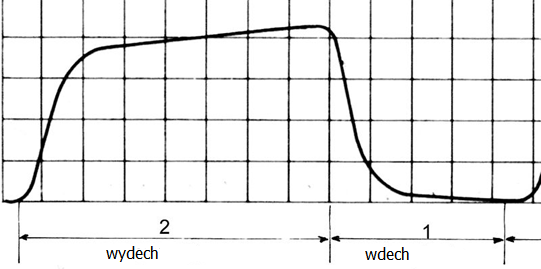

Stężenie którego gazu z wydychanego powietrza prezentuje kapnogram?

Do zaktualizowania rekordu tabeli należy zastosować polecenie

Dla sieci o adresie 192.150.160.0/26 pula adresów IP dla urządzeń w tej sieci zawiera się w zakresie

Operacje stałoprzecinkowe w procesorze wykonuje jednostka oznaczona jako

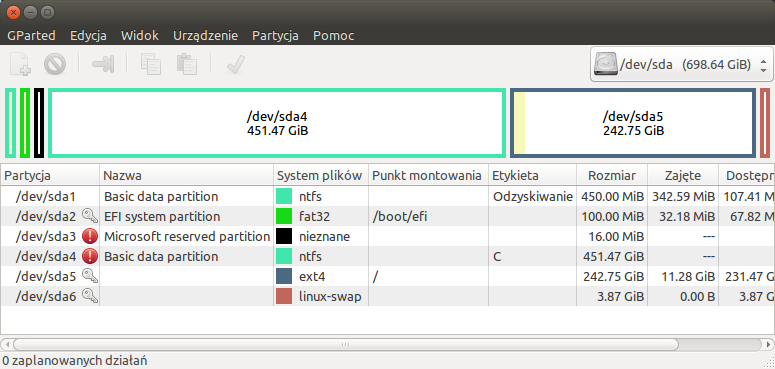

Z przedstawionego zrzutu wynika, że na dyskach zastosowano partycjonowanie

Które oznaczenie określa zapis elektryczny aktywności mózgu?

Które systemy operacyjne mogą być zainstalowane na dysku, którego działanie obrazuje GParted?

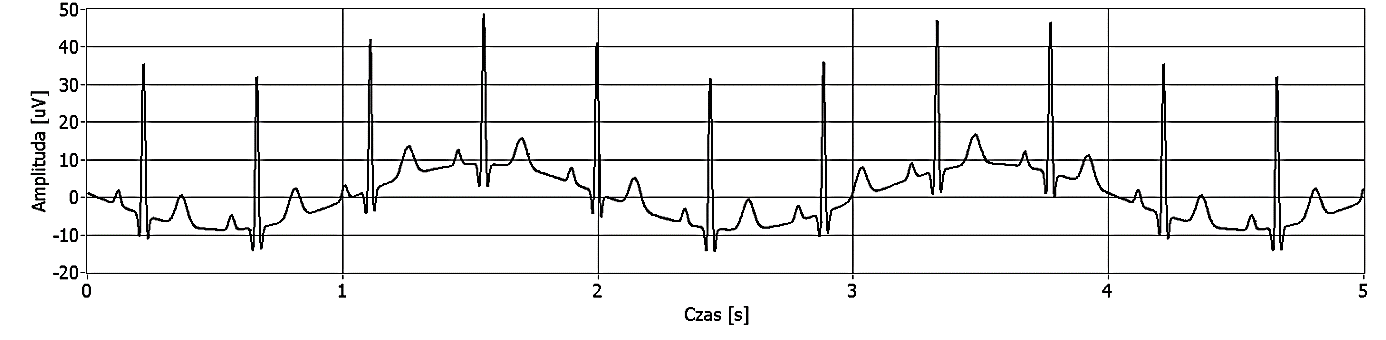

Podczas testowania elektrokardiografu otrzymano przedstawiony przebieg. Na jego podstawie stwierdzono, że nieprawidłowo działa filtr zakłóceń

Pierwszym krokiem podczas prac serwisowych wymagających modyfikowania rejestru w systemie Windows jest wykonanie

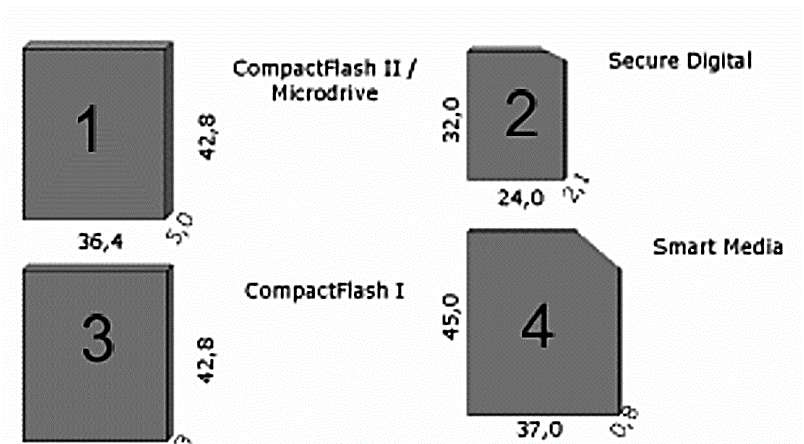

W aparacie holterowskim sygnał jest archiwizowany na karcie SD. Który rysunek przedstawia wymieniony nośnik pamięci?

Które polecenie w systemie Windows tworzy folder Dane?

Zapisana w ramce funkcja zawiera

| Funkcja oblicz(n) Jeżeli n=0 oblicz=1 W przeciwnym wypadku oblicz=(n-1)*oblicz(n-1) |

Urządzenie, które składa się między innymi z kamery na końcu przewodu i światłowodowych przewodów optycznych, to

Rysunek przedstawia wynik działania polecenia ipconfig urządzenia w sieci LAN. Który adres rutera umożliwia dostęp tego urządzenia do sieci WAN?

Na rysunku przedstawiono kartę rozszerzeń umożliwiającą

W celu połączenia komputera z systemem do badań wysiłkowych komunikującym się za pomocą interfejsu opisanego przedstawionym symbolem, należy w ustawieniach systemu włączyć

Który endoskop pozwala na badanie wnętrza tchawicy i oskrzeli?

W opisanym programie zostaną wykonane 4

for (i=0;i<=3;i++) suma=suma+i; |

W instrukcji systemu do skanowania dokumentacji medycznej zapisano, że umożliwia wykorzystanie systemu OCR, który służy do

Który interfejs nie umożliwia podłączenia urządzeń peryferyjnych w standardzie „plug and play”?

Programowanie obiektowe wykorzystuje dziedziczenie, które polega na

Która konsola MMC pozwala na zmianę ważności hasła i ustawienie blokady hasła po określonej liczbie logowań?

Zapis w dokumentacji układu holterowskiego „metoda pomiaru – oscylometryczna” świadczy o możliwości monitorowania

Technologie SLI i CrossFire pozwalają na podłączenie dwóch kart

Która usługa serwera przydziela adresy IP komputerom w sieci LAN?

Parametr dysku twardego określany skrótem MTBF oznacza średni czas

Parametr CL (czas opóźnienia, jaki upływa między wysłaniem przez kontroler RAM żądania dostępu do kolumny pamięci a otrzymaniem danych z tej kolumny) jest wyrażany w

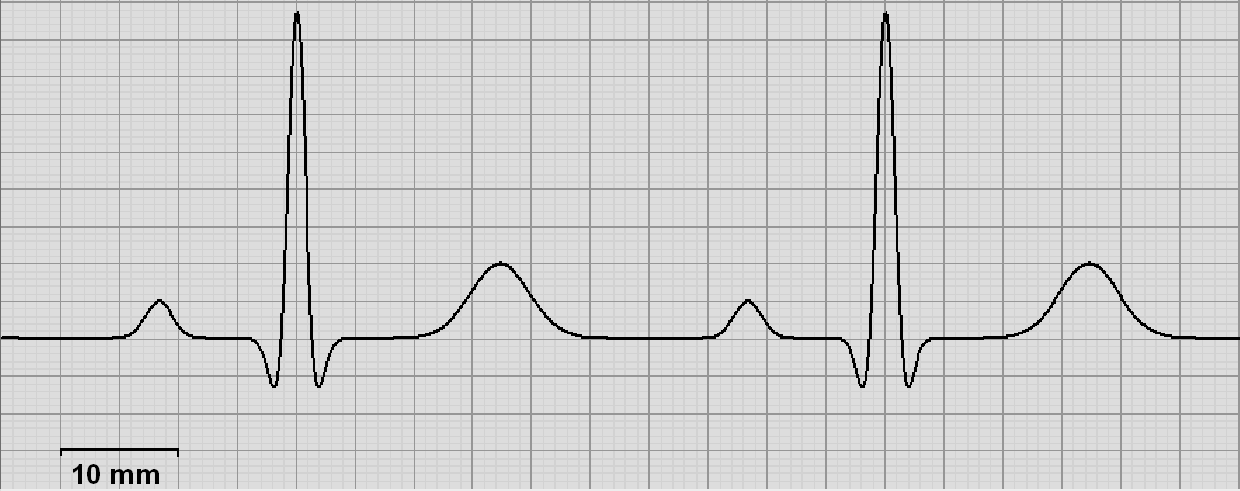

Jaka jest prędkość przesuwu prezentowanego elektrokardiogramu, jeżeli zmierzona częstotliwość rytmu serca wynosi 60 uderzeń na minutę?

Przedstawiony fragment dokumentacji dotyczy

Częstotliwość: 2.0-10.0MHz; Tryb obrazowania: B, B/B, B/M, M, 4B; Dynamiczne 4-stopniowe ogniskowanie; |

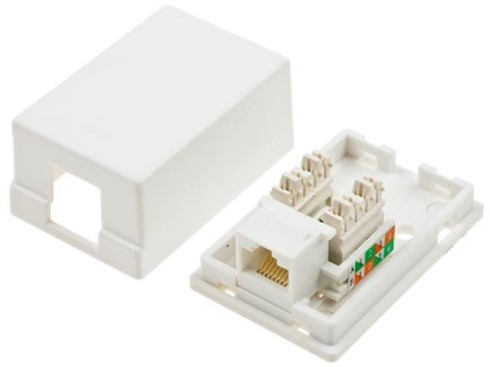

Montaż przewodów w sieciowym gniazdku natynkowym, przedstawionym na rysunku, wykonuje się

Które polecenie umożliwia śledzenie drogi pakietów w sieci?

Zaćma fotochemiczna jest wywołana promieniowaniem