Pytanie 1

Gdzie w systemie Linux umieszczane są pliki specjalne urządzeń, które są tworzone podczas instalacji sterowników?

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

Gdzie w systemie Linux umieszczane są pliki specjalne urządzeń, które są tworzone podczas instalacji sterowników?

Jakie narzędzie służy do delikatnego wygięcia blachy obudowy komputera i przykręcenia śruby montażowej w trudno dostępnych miejscach?

Czynnikiem zagrażającym bezpieczeństwu systemu operacyjnego, który wymusza jego automatyczne aktualizacje, są

Można przywrócić pliki z kosza, korzystając z polecenia

Aby chronić konto użytkownika przed nieautoryzowanymi zmianami w systemie Windows 7, 8 lub 10, które wymagają uprawnień administratora, należy ustawić

Jaką funkcję serwera z grupy Windows Server trzeba dodać, aby serwer mógł realizować usługi rutingu?

Kabel typu skrętka, w którym każda para żył jest umieszczona w oddzielnym ekranie z folii, a wszystkie przewody znajdują się w jednym ekranie, ma oznaczenie

Który protokół jest odpowiedzialny za przekształcanie adresów IP na adresy MAC w kontroli dostępu do nośnika?

Jaką konfigurację sieciową powinien mieć komputer, który jest częścią tej samej sieci LAN co komputer z adresem 10.8.1.10/24?

Jaki adres IPv4 wykorzystuje się do testowania protokołów TCP/IP na jednym hoście?

Jaką liczbę hostów można podłączyć w sieci o adresie 192.168.1.128/29?

Jakie zastosowanie ma narzędzie tracert w systemach operacyjnych rodziny Windows?

Który z poniższych adresów IP należy do grupy C?

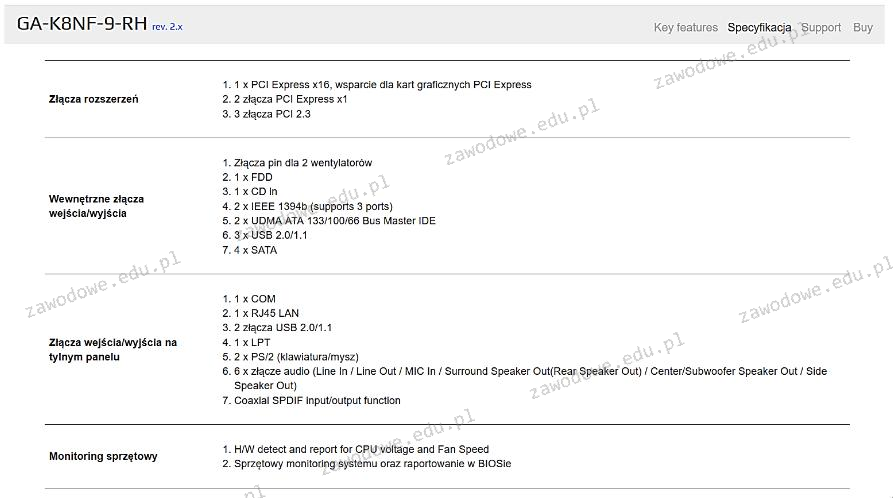

Na przedstawionym rysunku znajduje się fragment dokumentacji technicznej płyty głównej GA-K8NF-9-RH rev. 2.x. Z tego wynika, że maksymalna liczba kart rozszerzeń, które można zamontować (pomijając interfejs USB), wynosi

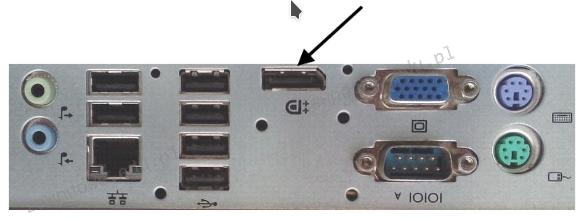

Na ilustracji ukazany jest tylny panel stacji roboczej. Strzałką wskazano port

Jaką usługę powinno się aktywować na ruterze, aby każda stacja robocza mogła wymieniać pakiety z siecią Internet, gdy dostępnych jest 5 adresów publicznych oraz 18 stacji roboczych?

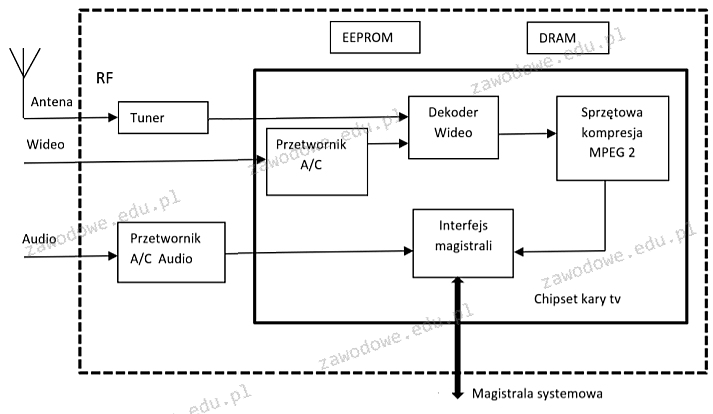

Na ilustracji zaprezentowano schemat blokowy karty

Symbol umieszczony na urządzeniach, który stanowi certyfikat potwierdzający zgodność w zakresie emisji promieniowania, ergonomii, efektywności energetycznej i ekologicznych norm, został przedstawiony na ilustracji

W którym z rejestrów wewnętrznych procesora są przechowywane dodatkowe informacje o wyniku realizowanej operacji?

Gdy w przeglądarce internetowej wpiszemy adres HTTP, pojawia się błąd "403 Forbidden", co oznacza, że

Po przeanalizowaniu wyników testu dysku twardego, jakie czynności powinny zostać wykonane, aby zwiększyć jego wydajność?

| Wolumin (C:) | ||

| Rozmiar woluminu | = | 39,06 GB |

| Rozmiar klastra | = | 4 KB |

| Zajęte miejsce | = | 27,48 GB |

| Wolne miejsce | = | 11,58 GB |

| Procent wolnego miejsca | = | 29 % |

| Fragmentacja woluminu | ||

| Fragmentacja całkowita | = | 15 % |

| Fragmentacja plików | = | 31 % |

| Fragmentacja wolnego miejsca | = | 0 % |

Jak nazywa się protokół, który pozwala na ściąganie wiadomości e-mail z serwera?

Aby zminimalizować główne zagrożenia dotyczące bezpieczeństwa podczas pracy na komputerze podłączonym do sieci Internet, najpierw należy

IMAP jest protokołem do

Osoba korzystająca z lokalnej sieci musi mieć możliwość dostępu do dokumentów umieszczonych na serwerze. W tym celu powinna

Który z parametrów okablowania strukturalnego wskazuje na relację mocy sygnału testowego w jednej parze do mocy sygnału wyindukowanego w sąsiedniej parze na tym samym końcu przewodu?

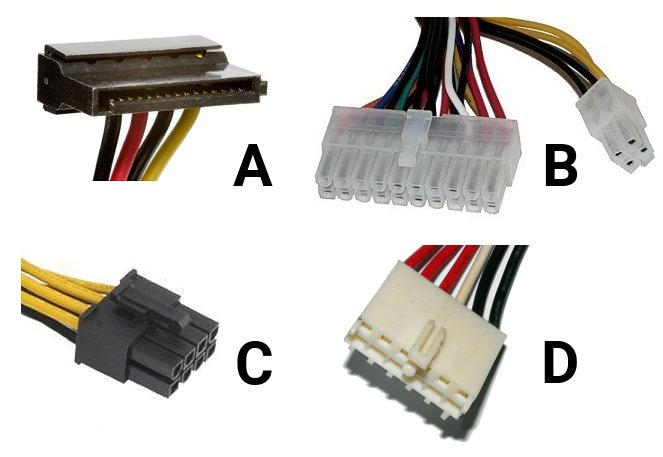

Wskaż rodzaj wtyczki zasilającej, którą należy podłączyć do napędu optycznego podczas montażu komputera.

W jakiej fizycznej topologii sieci komputerowej każdy węzeł ma łączność fizyczną z każdym innym węzłem w sieci?

Jakie informacje można uzyskać dzięki programowi Wireshark?

Zwiększenie zarówno wydajności operacji (zapis/odczyt), jak i bezpieczeństwa przechowywania danych jest możliwe dzięki zastosowaniu macierzy dyskowej

Usługa odpowiedzialna za konwersję nazw domen na adresy sieciowe to

Komenda "mmc" w systemach Windows 2000 oraz Windows XP uruchamia aplikację do tworzenia, zapisywania i otwierania

Według normy JEDEC, standardowe napięcie zasilające dla modułów pamięci RAM DDR3L o niskim napięciu wynosi

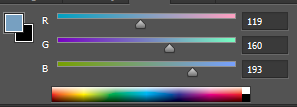

Przedstawiony na rysunku kolor zapisany w modelu RGB, w systemie szesnastkowym będzie zdefiniowany następująco

Do podłączenia projektora multimedialnego do komputera, nie można użyć złącza

Zgodnie ze specyfikacją JEDEC typowe napięcie zasilania modułów niskonapięciowych pamięci RAM DDR3L wynosi

Rzeczywistą kalibrację sprzętową monitora można wykonać

Które wbudowane narzędzie systemu Windows pozwala rozwiązywać problemy z błędnymi sektorami i integralnością plików?

Sieć 192.200.100.0 z maską 255.255.255.128 podzielono na 4 równe podsieci. Ile maksymalnie adresów hostów jest dostępnych w każdej podsieci?

Której aplikacji należy użyć, aby sprawdzić parametry S.M.A.R.T.?