Pytanie 1

Protokół, który pozwala na ściąganie wiadomości e-mail z serwera, to

Wynik: 16/40 punktów (40,0%)

Wymagane minimum: 20 punktów (50%)

Protokół, który pozwala na ściąganie wiadomości e-mail z serwera, to

Jakie oznaczenie powinien mieć komputer, aby mógł zostać sprzedany na terenie Polski, zgodnie z Dyrektywami Rady Europy?

Które z poniższych stwierdzeń NIE odnosi się do pamięci cache L1?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jednym z czynników, dla których zapis na dysku SSD jest szybszy niż na dysku HDD, jest

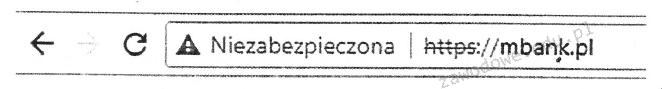

Informacja zawarta na ilustracji może wskazywać na

W systemach operacyjnych z rodziny Windows, funkcja EFS umożliwia ochronę danych poprzez ich

Oznaczenie CE świadczy o tym, że

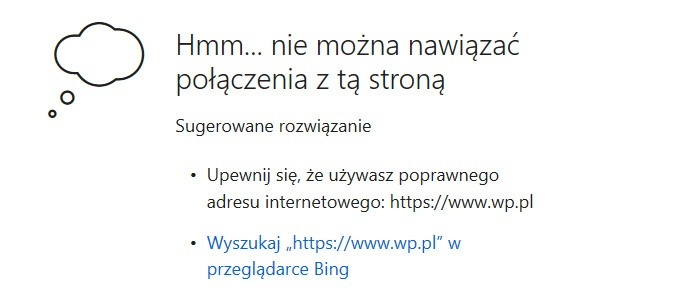

Zidentyfikuj powód pojawienia się komunikatu, który widoczny jest na ilustracji.

Ustawienia wszystkich kont użytkowników na komputerze znajdują się w gałęzi rejestru oznaczonej akronimem

Podczas próby zapisania danych na karcie SD wyświetla się komunikat "usuń ochronę przed zapisem lub użyj innego dysku". Zwykle przyczyną tego komunikatu jest

W przypadku, gdy w tej samej przestrzeni będą funkcjonować jednocześnie dwie sieci WLAN zgodne ze standardem 802.11g, w celu zminimalizowania ryzyka wzajemnych zakłóceń, powinny one otrzymać kanały o numerach różniących się o

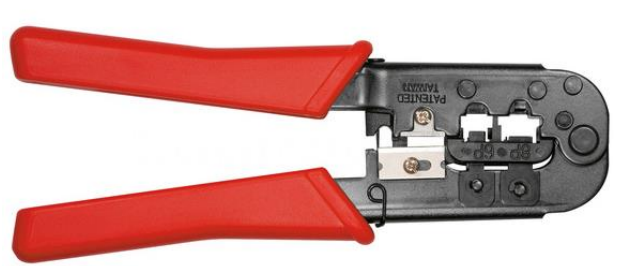

Jakie kable powinny być używane z narzędziem pokazanym na fotografii?

Aby w systemie Windows, przy użyciu wiersza poleceń, zmienić partycję FAT na NTFS bez utraty danych, powinno się zastosować polecenie

Program o nazwie dd, którego przykład użycia przedstawiono w systemie Linux, umożliwia:

dd if=/dev/sdb of=/home/uzytkownik/Linux.iso

Jakiej funkcji powinno się użyć, aby utworzyć kopię zapasową rejestru systemowego w programie regedit?

Jakie polecenie trzeba wydać w systemie Windows, aby zweryfikować tabelę mapowania adresów IP na adresy MAC wykorzystywane przez protokół ARP?

Aby połączyć dwa przełączniki oddalone o 200 m i osiągnąć minimalną przepustowość 200 Mbit/s, jakie rozwiązanie należy zastosować?

Rodzajem macierzy RAID, która nie jest odporna na awarię dowolnego z dysków wchodzących w jej skład, jest

W specyfikacji IEEE 802.3af opisano technologię dostarczania energii elektrycznej do różnych urządzeń sieciowych jako

Osoba korzystająca z systemu operacyjnego Linux pragnie przypisać adres IP 152.168.1.200 255.255.0.0 do interfejsu sieciowego. Jakie polecenie powinna wydać, mając uprawnienia administratora?

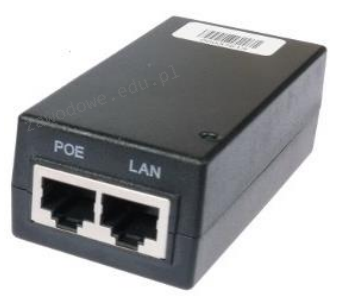

Urządzenie pokazane na ilustracji służy do

Na ilustracji zaprezentowano końcówkę wkrętaka typu

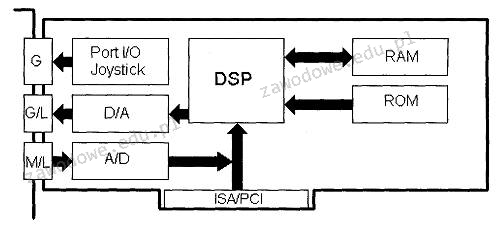

Element funkcjonalny opisany jako DSP w załączonym diagramie blokowym to

Co jest główną funkcją serwera DHCP w sieci komputerowej?

Aby przesłać projekt wydruku bezpośrednio z komputera do drukarki 3D, której parametry są pokazane w tabeli, można zastosować złącze

| Technologia pracy | FDM (Fused Deposition Modeling) |

| Głowica drukująca | Podwójny ekstruder z unikalnym systemem unoszenia dyszy i wymiennymi modułami drukującymi (PrintCore) |

| Średnica filamentu | 2,85 mm |

| Platforma drukowania | Szklana, podgrzewana |

| Temperatura platformy | 20°C – 100°C |

| Temperatura dyszy | 180°C – 280°C |

| Łączność | WiFi, Ethernet, USB |

| Rozpoznawanie materiału | Skaner NFC |

Aby umożliwić diagnozę systemu operacyjnego Windows oraz utworzyć plik zawierający listę wszystkich zaczytywanych sterowników, należy uruchomić system w trybie

Wykonanie polecenia net use Z:192.168.20.2data /delete spowoduje?

Podstawowym zadaniem mechanizmu Plug and Play jest

Jaką maksymalną prędkość transferu danych pozwala osiągnąć interfejs USB 3.0?

Zidentyfikuj najprawdopodobniejszą przyczynę pojawienia się komunikatu "CMOS checksum error press F1 to continue press DEL to setup" podczas uruchamiania systemu komputerowego?

Który z wymienionych składników stanowi element pasywny w sieci?

Jaką drukarkę powinna nabyć firma, która potrzebuje urządzenia do tworzenia trwałych kodów kreskowych oraz etykiet na folii i tworzywach sztucznych?

Główną metodą ochrony sieci komputerowej przed zewnętrznymi atakami jest wykorzystanie

W wyniku wydania polecenia: net user w konsoli systemu Windows, pojawi się

Rysunek ilustruje rezultaty sprawdzania działania sieci komputerowej przy użyciu polecenia

Badanie wp.pl [212.77.100.101] z użyciem 32 bajtów danych: Odpowiedź z 212.77.100.101: bajtów=32 czas=25ms TTL=249 Odpowiedź z 212.77.100.101: bajtów=32 czas=25ms TTL=249 Odpowiedź z 212.77.100.101: bajtów=32 czas=25ms TTL=249 Odpowiedź z 212.77.100.101: bajtów=32 czas=27ms TTL=249

Adresy IPv6 są reprezentowane jako liczby

Do sprawdzenia, czy w okablowaniu występują odwrócone pary przewodów, stosowany jest test

W ramce przedstawiono treść jednego z plików w systemie operacyjnym MS Windows. Jest to plik

| [boot loader] Time out=30 Default=Multi(0)disk(0)rdisk(0)partition(1)WINDOWS [operating system] Multi(0)disk(0)rdisk(0)partition(1)WINDOWS="Microsoft Windows XP Home Edition"/ fastdetect/NoExecute=OptOut |

Jakiemu zapisowi w systemie heksadecymalnym odpowiada binarny zapis adresu komórki pamięci 0111 1100 1111 0110?