Pytanie 1

Jakie urządzenie powinno być użyte do połączenia sprzętu peryferyjnego, które posiada bezprzewodowy interfejs komunikujący się za pomocą fal świetlnych w podczerwieni, z laptopem, który nie dysponuje takim interfejsem, lecz ma port USB?

Wynik: 17/40 punktów (42,5%)

Wymagane minimum: 20 punktów (50%)

Jakie urządzenie powinno być użyte do połączenia sprzętu peryferyjnego, które posiada bezprzewodowy interfejs komunikujący się za pomocą fal świetlnych w podczerwieni, z laptopem, który nie dysponuje takim interfejsem, lecz ma port USB?

Do dynamicznej obsługi sprzętu w Linuxie jest stosowany system

Który program pozwoli na zarządzanie zasobami i czasem oraz stworzenie harmonogramu prac montażowych zgodnie z projektem sieci lokalnej w budynku?

Partycja w systemie Linux, która tymczasowo przechowuje dane w przypadku niedoboru pamięci RAM, to

Jaki będzie wynik operacji odejmowania dwóch liczb szesnastkowych: 60Aₕ – 3BFₕ?

Jak nazywa się identyfikator, który musi być jednakowy, aby urządzenia sieciowe mogły współpracować w danej sieci bezprzewodowej?

Sprawdzenie ilości wolnego miejsca na dysku twardym w systemie Linux umożliwia polecenie

Jakie urządzenie powinno się zastosować do podłączenia żył kabla skrętki do gniazda Ethernet?

Na przedstawionej grafice wskazano strzałkami funkcje przycisków umieszczonych na obudowie projektora multimedialnego. Dzięki tym przyciskom można

Jaką prędkość przesyłu danych określa standard sieci Ethernet IEEE 802.3z?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Do jakiego pomiaru wykorzystywany jest watomierz?

Do zarządzania konfiguracją grup komputerowych oraz użytkowników w systemach Windows Server, należy wykorzystać narzędzie

W systemie Linux można uzyskać kopię danych przy użyciu komendy

Jaki adres IPv6 jest stosowany jako adres link-local w procesie autokonfiguracji urządzeń?

Jak nazywa się proces dodawania do danych z warstwy aplikacji informacji powiązanych z protokołami funkcjonującymi na różnych poziomach modelu sieciowego?

Plik tekstowy wykonaj.txt w systemie Linux zawiera: echo -n "To jest tylko " echo "jedna linijka tekstu" Aby móc wykonać polecenia znajdujące się w pliku, należy

Po zainstalowaniu systemu z domyślnymi parametrami, Windows XP nie obsługuje tego systemu plików.

Aby chronić konto użytkownika przed nieautoryzowanymi zmianami w systemie Windows 7, 8 lub 10, które wymagają uprawnień administratora, należy ustawić

Kiedy wygasa autorskie prawo majątkowe dotyczące programu komputerowego, stworzonego przez kilku programistów, którzy jako jego autorzy podpisali aplikację swoimi imionami i nazwiskami?

W którym programie należy zmodyfikować ustawienia, aby użytkownik komputera mógł wybrać z menu i uruchomić jeden z kilku systemów operacyjnych zainstalowanych na jego komputerze?

Protokół SNMP (Simple Network Management Protocol) służy do

Aby przywrócić dane z sformatowanego dysku twardego, konieczne jest zastosowanie programu

Jakie polecenie powinno być użyte do obserwacji lokalnych połączeń?

Jakie urządzenie umożliwia zwiększenie zasięgu sieci bezprzewodowej?

Według normy PN-EN 50174 maksymalny rozplot kabla UTP powinien wynosić nie więcej niż

W systemie Windows, aby uruchomić usługę związaną z wydajnością komputera, należy użyć polecenia

Liczba 45H w systemie ósemkowym wyraża się jako

Użytkownik planuje instalację 32-bitowego systemu operacyjnego Windows 7. Jaka jest minimalna ilość pamięci RAM, którą powinien mieć komputer, aby system mógł działać w trybie graficznym?

Rodzajem macierzy RAID, która nie jest odporna na awarię dowolnego z dysków wchodzących w jej skład, jest

W jednostce ALU do akumulatora została zapisana liczba dziesiętna 240. Jak wygląda jej reprezentacja w systemie binarnym?

Protokół, który umożliwia po połączeniu z serwerem pocztowym przesyłanie na komputer tylko nagłówków wiadomości, a wysyłanie treści oraz załączników następuje dopiero po otwarciu konkretnego e-maila, to

Aby zainstalować openSUSE oraz dostosować jego ustawienia, można skorzystać z narzędzia

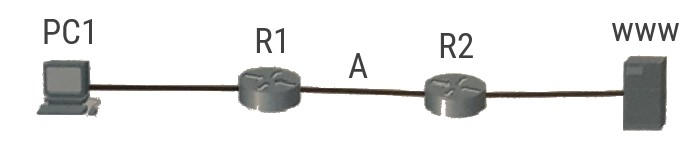

Ramka danych przesyłanych z komputera PC1 do serwera www znajduje się pomiędzy ruterem R1 a ruterem R2 (punkt A). Jakie adresy są w niej zawarte?

Jakim protokołem komunikacyjnym w warstwie transportowej, który zapewnia niezawodność przesyłania pakietów, jest protokół

Administrator pragnie udostępnić w sieci folder C:instrukcje trzem użytkownikom z grupy Serwisanci. Jakie rozwiązanie powinien wybrać?

Bez uzyskania zgody właściciela praw autorskich do oprogramowania, jego legalny użytkownik, zgodnie z ustawą o prawie autorskim i prawach pokrewnych, co może uczynić?

Aby komputer stacjonarny mógł współdziałać z urządzeniami używającymi złącz pokazanych na ilustracji, konieczne jest wyposażenie go w interfejs

Czym jest kopia różnicowa?

Jaką rolę pełni serwer plików w sieciach komputerowych LAN?