Pytanie 1

Jaką liczbę hostów można podłączyć w sieci o adresie 192.168.1.128/29?

Wynik: 8/40 punktów (20,0%)

Wymagane minimum: 20 punktów (50%)

Jaką liczbę hostów można podłączyć w sieci o adresie 192.168.1.128/29?

Jednym ze sposobów na ograniczenie dostępu do sieci bezprzewodowej dla nieuprawnionych osób jest

Który protokół należy do bezpołączeniowych protokołów warstwy transportowej?

W systemach Windows istnieje możliwość przypisania użytkownika do dowolnej grupy za pomocą panelu

Na płycie głównej z chipsetem Intel 865G

Trzech użytkowników komputera z systemem operacyjnym Windows XP Pro posiada swoje foldery z dokumentami w głównym katalogu dysku C:. Na dysku znajduje się system plików NTFS. Użytkownicy mają utworzone konta z ograniczonymi uprawnieniami. Jak można zabezpieczyć folder każdego z użytkowników, aby inni nie mieli możliwości modyfikacji jego zawartości?

Jakiej klasy adresów IPv4 dotyczą adresy, które mają dwa najbardziej znaczące bity ustawione na 10?

Standard zwany IEEE 802.11, używany w lokalnych sieciach komputerowych, określa typ sieci:

Najskuteczniejszym sposobem na wykonanie codziennego archiwizowania pojedynczego pliku o wielkości 4,8 GB, na jednym komputerze bez dostępu do Internetu jest

Funkcja System Image Recovery dostępna w zaawansowanych opcjach uruchamiania systemu Windows 7 pozwala na

Jakie urządzenie wskazujące działa w reakcji na zmiany pojemności elektrycznej?

Jak wiele domen kolizyjnych oraz rozgłoszeniowych można dostrzec na schemacie?

Oprogramowanie, które jest przypisane do konkretnego komputera lub jego komponentu i nie pozwala na reinstalację na nowszym sprzęcie zakupionym przez tego samego użytkownika, nosi nazwę

Jaką pojemność ma dwuwarstwowa płyta Blu-ray?

Jaką usługę obsługuje port 3389?

Podczas próby nawiązania połączenia z serwerem FTP, uwierzytelnienie anonimowe nie powiodło się, natomiast logowanie za pomocą loginu i hasła zakończyło się sukcesem. Co może być przyczyną tej sytuacji?

Wskaź 24-pinowe lub 29-pinowe złącze żeńskie, które jest w stanie przesyłać skompresowany sygnał cyfrowy do monitora?

Jakie urządzenie powinno się zastosować do podłączenia żył kabla skrętki do gniazda Ethernet?

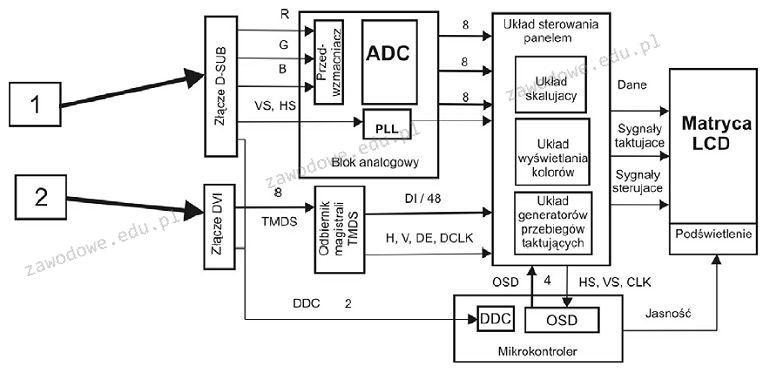

Które z połączeń zaznaczonych strzałkami na diagramie monitora stanowi wejście cyfrowe?

Jak należy postąpić z wiadomością e-mail od nieznanej osoby, która zawiera podejrzany załącznik?

Do dynamicznej obsługi sprzętu w Linuxie jest stosowany system

W systemie oktalnym liczba heksadecymalna 1E2F16 ma zapis w postaci

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Który z protokołów pełni rolę protokołu połączeniowego?

Do konserwacji elementów łożyskowanych oraz ślizgowych w urządzeniach peryferyjnych stosuje się

Aby zweryfikować indeks stabilności systemu Windows Server, należy zastosować narzędzie

W tabeli przedstawiono numery podzespołów, które są ze sobą kompatybilne

| Lp. | Podzespół | Parametry |

|---|---|---|

| 1. | Procesor | INTEL COREi3-4350- 3.60 GHz, x2/4, 4 MB, 54W, HD 4600, BOX, s-1150 |

| 2. | Procesor | AMD Ryzen 7 1800X, 3.60 GHz, 95W, s-AM4 |

| 3. | Płyta główna | GIGABYTE ATX, X99, 4x DDR3, 4x PCI-E 16x, RAID, HDMI, D-Port, D-SUB, 2x USB 3.1, 8 x USB 2.0, S-AM3+ |

| 4. | Płyta główna | Asus CROSSHAIR VI HERO, X370, SATA3, 4xDDR4, USB3.1, ATX, WI-FI AC, s- AM4 |

| 5. | Pamięć RAM | Corsair Vengeance LPX, DDR4 2x16GB, 3000MHz, CL15 black |

| 6. | Pamięć RAM | Crucial Ballistix DDR3, 2x8GB, 1600MHz, CL9, black |

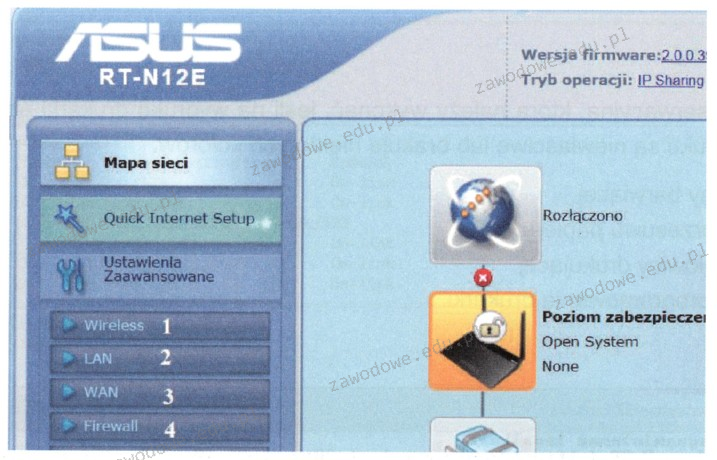

Aby skonfigurować ruter i wprowadzić parametry połączenia od dostawcy internetowego, którą sekcję oznaczoną numerem należy wybrać?

Program "VirtualPC", dostępny do pobrania z witryny Microsoft, jest przeznaczony do korzystania:

Uszkodzenie czego może być przyczyną awarii klawiatury?

Wskaż program do składu publikacji

Liczba 10011001100 w systemie heksadecymalnym przedstawia się jako

Który z podanych adresów protokołu IPv4 jest adresem klasy D?

W komputerze połączonym z Internetem, w oprogramowaniu antywirusowym aktualizację bazy wirusów powinno się przeprowadzać minimum

Jakie jest właściwe IP dla maski 255.255.255.0?

Na komputerze, na którym zainstalowane są dwa systemy – Windows i Linux, po przeprowadzeniu reinstalacji systemu Windows drugi system przestaje się uruchamiać. Aby ponownie umożliwić uruchamianie systemu Linux oraz aby zachować wszystkie dane i ustawienia w nim zawarte, co należy zrobić?

Jakie urządzenie stosuje technikę polegającą na wykrywaniu zmian w pojemności elektrycznej podczas manipulacji kursorem na monitorze?

W systemie Linux polecenie touch ma na celu

Aby uruchomić edytor rejestru w systemie Windows, należy skorzystać z narzędzia

Adres IP 192.168.2.0/24 został podzielony na cztery mniejsze podsieci. Jaką maskę mają te nowe podsieci?