Pytanie 1

Kable światłowodowe nie są szeroko używane w lokalnych sieciach komputerowych z powodu

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Kable światłowodowe nie są szeroko używane w lokalnych sieciach komputerowych z powodu

Który z podanych adresów IPv4 stanowi adres publiczny?

Aby zapewnić, że komputer uzyska od serwera DHCP określony adres IP, należy na serwerze zdefiniować

Aby zorganizować pliki na dysku w celu poprawy wydajności systemu, należy:

Użytkownicy dysków SSD powinni unikać wykonywania następujących działań konserwacyjnych

Programem służącym do archiwizacji danych w systemie Linux jest

Jak należy rozmieszczać gniazda komputerowe RJ45 w odniesieniu do przestrzeni biurowej zgodnie z normą PN-EN 50174?

Aby uzyskać uprawnienia administratora w systemie Linux, należy w terminalu wpisać polecenie

Programy CommView oraz WireShark są wykorzystywane do

Jakiego typu tablicę partycji trzeba wybrać, aby stworzyć partycję o pojemności 3TB na dysku twardym?

Głowica drukująca, składająca się z wielu dysz zintegrowanych z mechanizmem drukarki, wykorzystywana jest w drukarce

Który z trybów nie jest dostępny dla narzędzia powiększenia w systemie Windows?

Wskaż procesor współpracujący z przedstawioną płytą główną.

Jaką wartość ma największa liczba 16-bitowa?

Jakie będą wydatki na zakup kabla UTP kat.5e potrzebnego do stworzenia sieci komputerowej składającej się z 6 stanowisk, przy średniej odległości każdego stanowiska od przełącznika równiej 9m? Należy doliczyć m zapasu dla każdej linii kablowej, a cena za metr kabla wynosi 1,50 zł?

Znak przedstawiony na ilustracji, zgodny z normą Energy Star, wskazuje na urządzenie

Użytkownik chce tak zmodernizować komputer, aby działały na nim gry wymagające DirectX12. Jaki system operacyjny powinien zakupić do modernizowanego komputera, aby wspierał DX12?

Program CHKDSK jest wykorzystywany do

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

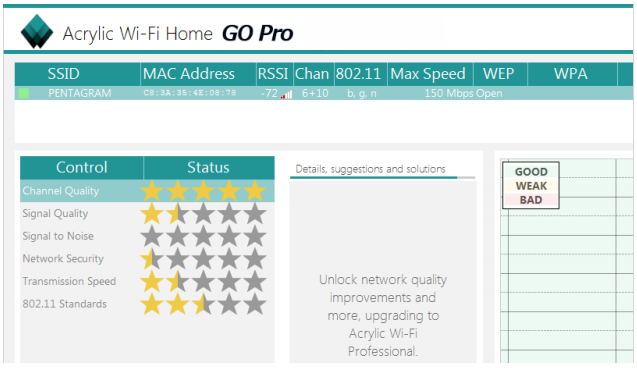

W programie Acrylic Wi-Fi Home przeprowadzono test, którego rezultaty ukazano na zrzucie ekranu. Na ich podstawie można stwierdzić, że sieć bezprzewodowa dostępna w danym momencie

Aby uruchomić monitor wydajności oraz niezawodności w systemie Windows, należy skorzystać z przystawki

Podczas zmiany ustawień rejestru Windows w celu zapewnienia bezpieczeństwa operacji, na początku należy

Jak w systemie Windows zmienić port drukarki, która została zainstalowana?

Komputer wyposażony w BIOS firmy Award wygenerował komunikat o treści Primary/Secondary master/slave hard disk fail. Komunikat ten może oznaczać konieczność wymiany

Wskaż sygnał informujący o błędzie karty graficznej w komputerze z BIOS POST od firmy AWARD?

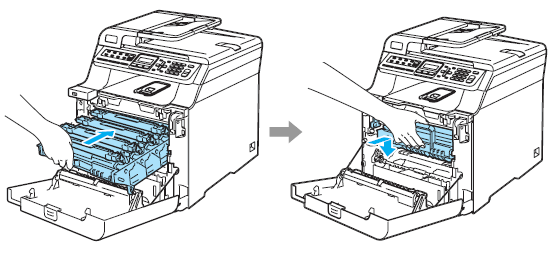

Czynność pokazana na rysunkach ilustruje mocowanie

Regulacje dotyczące konstrukcji systemu okablowania strukturalnego, parametry kabli oraz procedury testowania obowiązujące w Polsce są opisane w normach

Aby naprawić zasilacz laptopa poprzez wymianę kondensatorów, jakie narzędzie powinno się wykorzystać?

Jaką liczbę bitów posiada adres logiczny IPv6?

Według modelu TCP/IP protokoły DNS, FTP i SMTP są przypisane do warstwy

Aby podłączyć drukarkę igłową o wskazanych parametrach do komputera, trzeba umieścić kabel dołączony do drukarki w porcie

| Producent | OKI |

|---|---|

| Ilość igieł | 24 |

| Wspierane systemy operacyjne | Windows 7, Windows Server 2008 |

| Szybkość druku [znaki/s] | 576 |

| Maksymalna ilość warstw wydruku | 6 |

| Interfejs | IEEE 1284 |

| Pamięć | 128 KB |

| Poziom hałasu [dB] | 57 |

Długi oraz dwa krótkie dźwięki sygnałowe BIOS POST od AMI i AWARD sygnalizują problem

Czy bęben światłoczuły znajduje zastosowanie w drukarkach?

Jaką jednostką określa się szybkość przesyłania danych w sieciach komputerowych?

Jakie są różnice pomiędzy poleceniem ps a poleceniem top w systemie Linux?

Podaj nazwę funkcji przełącznika, która pozwala na przypisanie wyższego priorytetu dla transmisji VoIP?

Który z wymienionych parametrów procesora AMD APU A10 5700 3400 nie ma bezpośredniego wpływu na jego wydajność?

| Częstotliwość | 3400 MHz |

| Proces technologiczny | 32 nm |

| Architektura | 64 bit |

| Ilość rdzeni | 4 |

| Ilość wątków | 4 |

| Pojemność pamięci L1 (instrukcje) | 2x64 kB |

| Pojemność pamięci L1 (dane) | 4x16 kB |

| Pojemność Pamięci L2 | 2x2 MB |

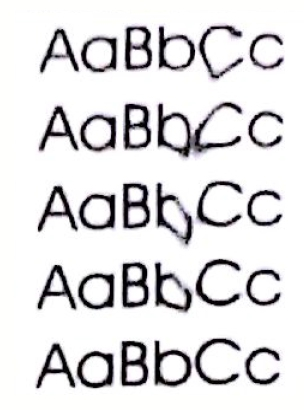

Najbardziej prawdopodobnym powodem niskiej jakości druku z drukarki laserowej, objawiającym się widocznym rozmazywaniem tonera, jest

Programem w systemie Linux, który umożliwia nadzorowanie systemu za pomocą zcentralizowanego mechanizmu, jest narzędzie

Aby uruchomić edytor rejestru w systemie Windows, należy skorzystać z narzędzia