Pytanie 1

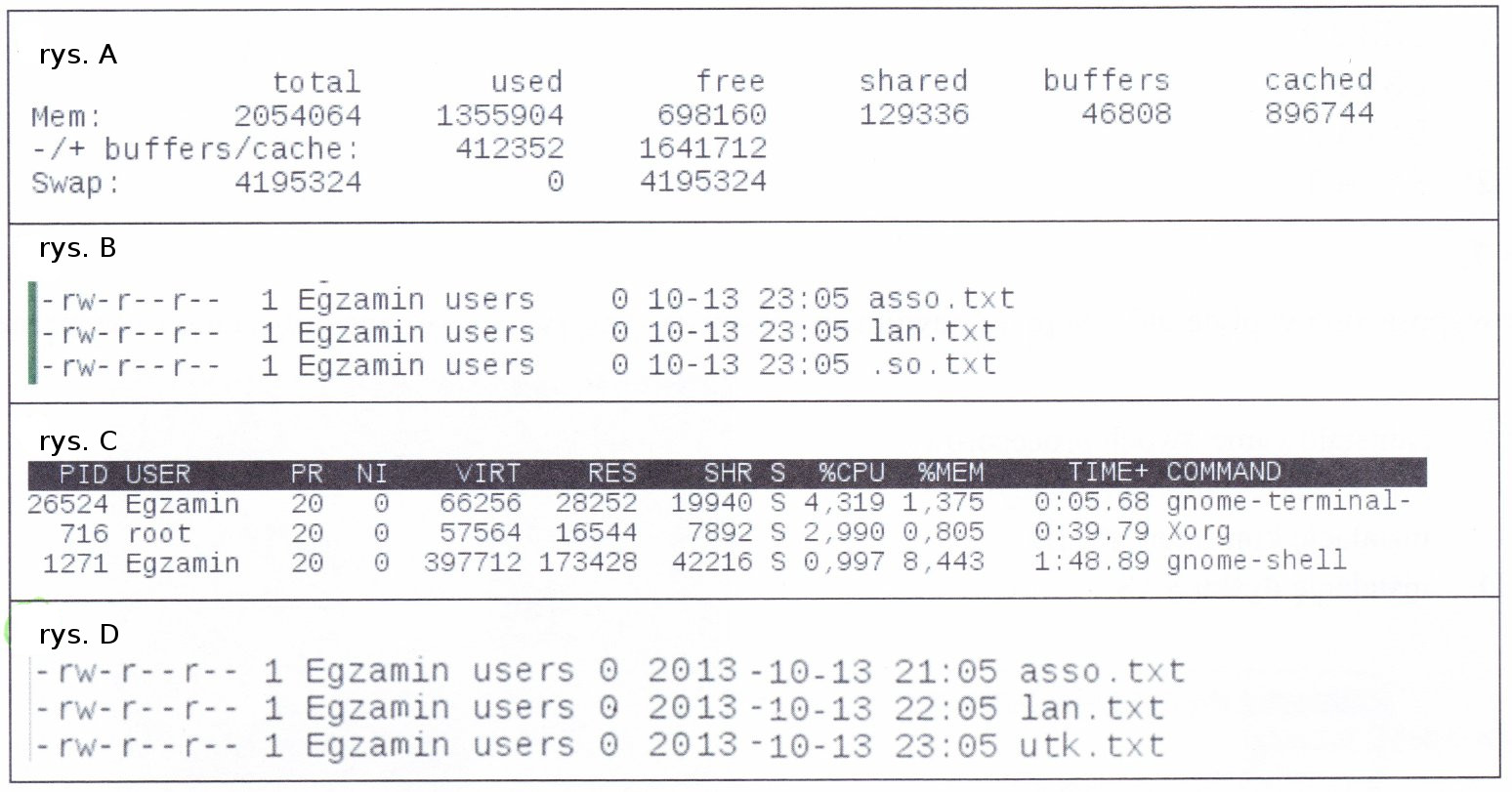

Rezultat wykonania komendy ls -l w systemie Linux ilustruje poniższy rysunek

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Rezultat wykonania komendy ls -l w systemie Linux ilustruje poniższy rysunek

Aby aktywować tryb awaryjny w systemach z rodziny Windows, w trakcie uruchamiania komputera trzeba nacisnąć klawisz

Podczas uruchamiania komputera wyświetla się komunikat "CMOS checksum error press F1 to continue press DEL to setup". Naciśnięcie klawisza DEL spowoduje

Określenie najbardziej efektywnej trasy dla połączenia w sieci to

Jaki protokół sygnalizacyjny jest wykorzystywany w technologii VoIP?

Na ilustracji zobrazowano okno ustawień rutera. Wprowadzone parametry sugerują, że

W systemie Windows mechanizm ostrzegający przed uruchamianiem nieznanych aplikacji oraz plików pobranych z Internetu funkcjonuje dzięki

Usługi na serwerze są konfigurowane za pomocą

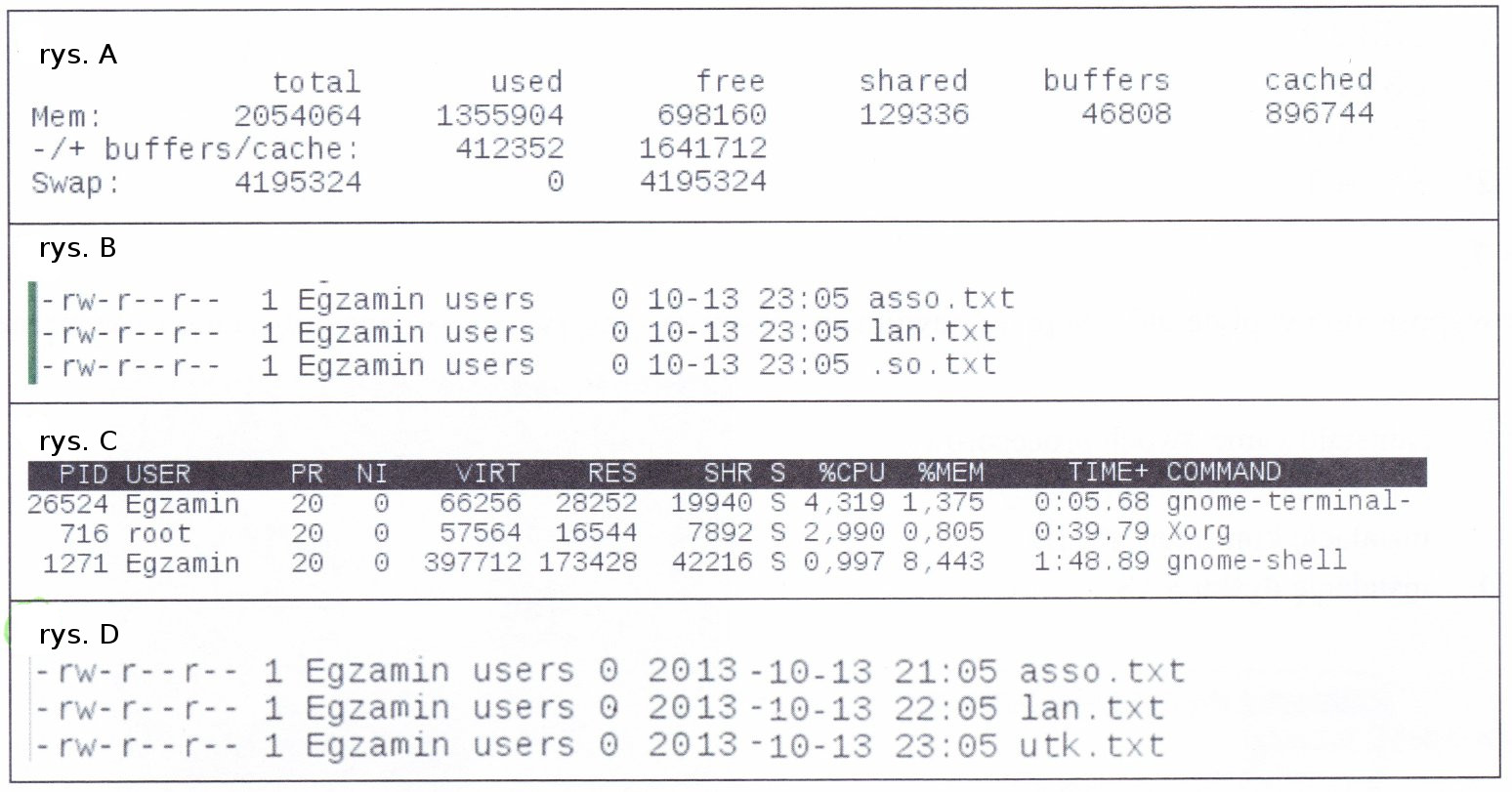

Strategia przedstawiona w diagramie dla tworzenia kopii zapasowych na nośnikach jest znana jako

Cena wydruku jednej strony tekstu wynosi 95 gr, a koszt wykonania jednej płyty CD to 1,54 zł. Jakie wydatki poniesie firma, tworząc płytę z prezentacjami oraz poradnik liczący 120 stron?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Oblicz całkowity koszt za realizację poniższych czynności serwisowych, przy założeniu, że stawka za jedną roboczogodzinę wynosi 120,00 zł netto, a podatek VAT wynosi 23%.

| LP | Zrealizowane czynności serwisowe | Ilość roboczogodzin |

|---|---|---|

| 1. | Diagnozowanie usterki | 0,2 |

| 2. | Wymiana zasilacza | 0,5 |

| 3. | Przygotowanie drukarki do eksploatacji | 0,6 |

| 4. | Konserwacja urządzenia drukującego | 1,0 |

| 5. | Sprawdzanie po zakończeniu naprawy | 0,2 |

Jaki protokół warstwy aplikacji jest wykorzystywany do zarządzania urządzeniami sieciowymi poprzez sieć?

W biurowcu należy podłączyć komputer do routera ADSL za pomocą przewodu UTP Cat 5e. Jaka powinna być maksymalna odległość między komputerem a routerem?

Który z protokołów przesyła datagramy użytkownika BEZ GWARANCJI ich dostarczenia?

Jakie polecenie w systemach Windows/Linux jest zazwyczaj wykorzystywane do monitorowania trasy pakietów w sieciach IP?

Jakie narzędzie w systemie Windows służy do przeglądania informacji dotyczących problemów z systemem?

Protokół SNMP (Simple Network Management Protocol) jest wykorzystywany do

Aby sygnały pochodzące z dwóch routerów w sieci WiFi pracującej w standardzie 802.11g nie wpływały na siebie nawzajem, należy skonfigurować kanały o numerach

W systemie Windows odpowiednikiem macierzy RAID1 jest wolumin

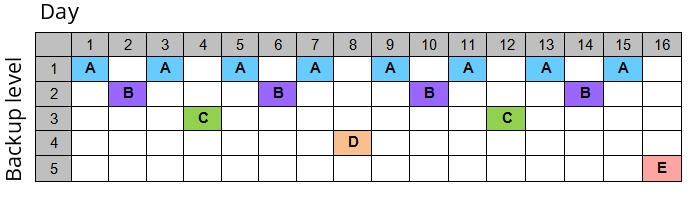

Która z przedstawionych na rysunkach topologii jest topologią siatkową?

Który adres IP posiada maskę w postaci pełnej, zgodną z klasą adresu?

W przypadku dłuższego nieużytkowania drukarki atramentowej, pojemniki z tuszem powinny

Wskaż cechę platformy wirtualizacji Hyper-V.

Przedstawiony skaner należy podłączyć do komputera przy użyciu złącza

Wskaż złącze, które nie jest obecne w zasilaczach ATX?

Jakie polecenie diagnostyczne powinno się użyć, aby uzyskać informacje na temat tego, czy miejsce docelowe odpowiada oraz po jakim czasie nastąpiła odpowiedź?

Aby podłączyć drukarkę z portem równoległym do komputera, który dysponuje jedynie złączami USB, konieczne jest zainstalowanie adaptera

Termin gorącego podłączenia (hot-plug) wskazuje, że podłączane urządzenie działa

Urządzenie elektryczne lub elektroniczne, które zostało zużyte i posiada znak widoczny na ilustracji, powinno być

Urządzenie przedstawione na ilustracji, wraz z podanymi danymi technicznymi, może być zastosowane do pomiarów systemów okablowania

W systemach operacyjnych z rodziny Windows odpowiednikiem programu fsck z systemu Linux jest aplikacja

Najwyższą prędkość transmisji danych w sieci bezprzewodowej zapewnia standard

Jakie urządzenie powinno być użyte do segmentacji domeny rozgłoszeniowej?

Jakie polecenie w systemie operacyjnym Linux służy do monitorowania komunikacji pakietów TCP/IP lub protokołów wysyłanych lub odbieranych w sieci komputerowej, do której podłączony jest komputer użytkownika?

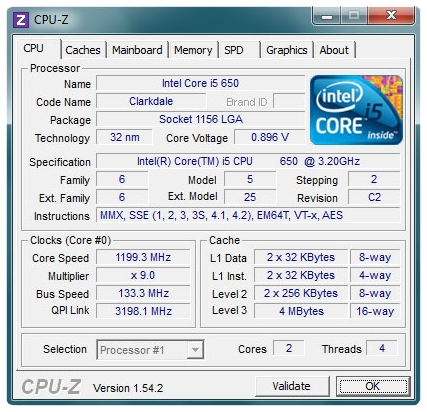

W dokumentacji technicznej procesora producent zamieścił wyniki analizy zrealizowanej przy użyciu programu CPU-Z. Z tych informacji wynika, że procesor dysponuje

Które środowisko graficzne przeznaczone dla systemu Linux charakteryzuje się najmniejszymi wymaganiami parametrów pamięci RAM?

AES (ang. Advanced Encryption Standard) to?

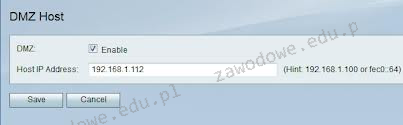

Na ilustracji widać zrzut ekranu ustawień strefy DMZ na routerze. Aktywacja opcji "Enable DMZ" spowoduje, że komputer z adresem IP 192.168.0.106

Jakie pojęcia wiążą się z terminami „sequence number” oraz „acknowledgment number”?

Sequence number: 117752 (relative sequence number) Acknowledgment number: 33678 (relative ack number) Header Length: 20 bytes Flags: 0x010 (ACK) Window size value: 258