Pytanie 1

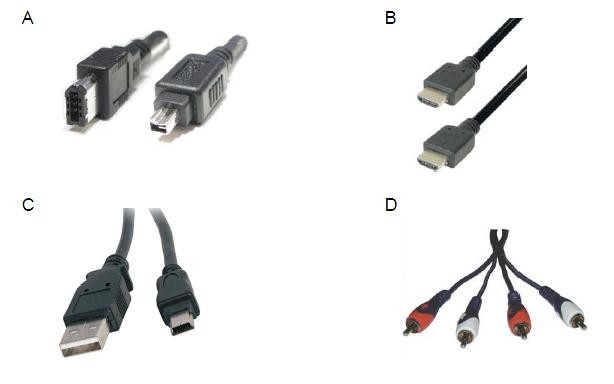

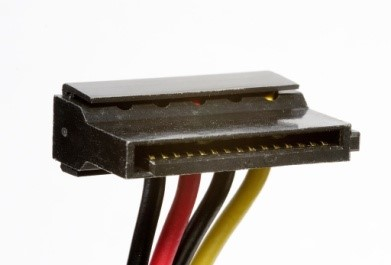

Aby połączyć cyfrową kamerę z interfejsem IEEE 1394 (FireWire) z komputerem, wykorzystuje się kabel z wtykiem zaprezentowanym na fotografii

Wynik: 24/40 punktów (60,0%)

Wymagane minimum: 20 punktów (50%)

Aby połączyć cyfrową kamerę z interfejsem IEEE 1394 (FireWire) z komputerem, wykorzystuje się kabel z wtykiem zaprezentowanym na fotografii

Elementem, który umożliwia wymianę informacji pomiędzy procesorem a magistralą PCI-E, jest

W przypadku zalania układu elektronicznego klawiatury słodkim napojem należy natychmiast odłączyć ją od zestawu komputerowego, a następnie

Usługa umożliwiająca przechowywanie danych na zewnętrznym serwerze, do którego dostęp możliwy jest przez Internet to

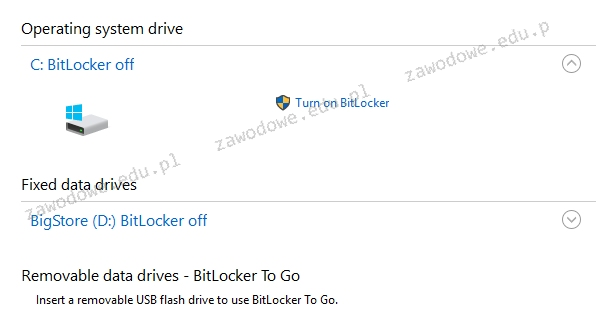

Prezentowane wbudowane narzędzie systemów Windows w wersji Enterprise lub Ultimate jest przeznaczone do

Metoda przesyłania danych pomiędzy urządzeniami CD/DVD a pamięcią komputera w trybie bezpośredniego dostępu do pamięci to

Które z poniższych urządzeń jest przykładem urządzenia peryferyjnego wejściowego?

Jakie parametry otrzyma interfejs sieciowy eth0 po wykonaniu poniższych poleceń w systemie Linux?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jeśli w określonej przestrzeni będą funkcjonowały równocześnie dwie sieci WLAN w standardzie 802.11g, to aby zredukować ryzyko wzajemnych zakłóceń, należy przypisać im kanały o numerach różniących się o

Aby komputery mogły udostępniać dane w sieci, NIE powinny mieć tych samych

W przypadku awarii którego urządzenia w sieci lokalnej, cała sieć przestaje działać w topologii magistrali?

Na płycie głównej doszło do awarii zintegrowanej karty sieciowej. Komputer nie ma dysku twardego ani innych napędów, takich jak stacja dysków czy CD-ROM. Klient informuje, że w sieci firmowej komputery nie mają napędów, a wszystko "czyta" się z serwera. Aby przywrócić utraconą funkcjonalność, należy zainstalować

W którym miejscu w edytorze tekstu należy wprowadzić tekst lub ciąg znaków, który ma być widoczny na wszystkich stronach dokumentu?

Użytkownik chce zabezpieczyć mechanicznie dane na karcie pamięci przed przypadkowym skasowaniem. Takie zabezpieczenie umożliwia karta

Wskaż nieprawidłowy sposób podziału dysków MBR na partycje?

Jakie urządzenie w sieci lokalnej nie wydziela segmentów sieci komputerowej na kolizyjne domeny?

Wskaż symbol, który znajduje się na urządzeniach elektrycznych przeznaczonych do handlu w Unii Europejskiej?

Polecenie to zostało wydane przez Administratora systemu operacyjnego w trakcie ręcznej konfiguracji sieciowego interfejsu. Wynikiem wykonania tego polecenia jest ```netsh interface ip set address name="Glowna" static 151.10.10.2 255.255.0.0 151.10.0.1```

Funkcja Intel Turbo Boost w mikroprocesorze umożliwia

Element płyty głównej, który jest odpowiedzialny za wymianę danych między procesorem a innymi komponentami płyty, to

Kabel sieciowy z końcówkami RJ45 był testowany za pomocą diodowego urządzenia do sprawdzania okablowania. Na tym urządzeniu diody LED włączały się po kolei, z wyjątkiem diod oznaczonych numerami 2 i 3, które świeciły jednocześnie na jednostce głównej testera, natomiast nie świeciły na jednostce zdalnej. Jaka była tego przyczyna?

Ustawa z dnia 14 grudnia 2012 roku dotycząca odpadów zobowiązuje

Optyczna rozdzielczość to jeden z właściwych parametrów

Przedstawiony skaner należy podłączyć do komputera przy użyciu złącza

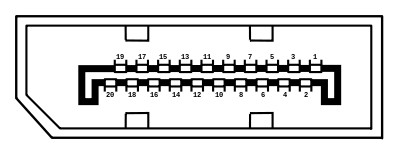

Jak wygląda sekwencja w złączu RJ-45 według normy TIA/EIA-568 dla zakończenia typu T568B?

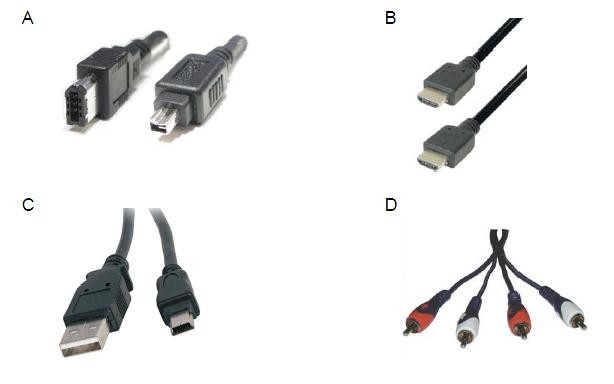

Na ilustracji ukazano port

Jaki akronim oznacza program do tworzenia graficznych wykresów ruchu, który odbywa się na interfejsach urządzeń sieciowych?

Jakie protokoły przesyłają cykliczne kopie tablic routingu do sąsiadującego rutera i NIE ZAWIERAJĄ pełnych informacji o dalekich ruterach?

Którą czynność należy wykonać podczas konfiguracji rutera, aby ukryta sieć bezprzewodowa była widoczna dla wszystkich użytkowników znajdujących się w jej zasięgu?

Program wirusowy, którego zasadniczym zamiarem jest samoistne rozprzestrzenianie się w sieci komputerowej, to:

Elementem płyty głównej, który odpowiada za wymianę informacji pomiędzy procesorem a innymi komponentami płyty, jest

Przedstawiony zestaw komputerowy jest niekompletny. Który element nie został uwzględniony w tabeli, a jest niezbędny do prawidłowego działania zestawu i należy go dodać?

| Lp. | Nazwa podzespołu |

|---|---|

| 1. | Cooler Master obudowa komputerowa CM Force 500W czarna |

| 2. | Gigabyte GA-H110M-S2H, Realtek ALC887, DualDDR4-2133, SATA3, HDMI, DVI, D-Sub, LGA1151, mATX |

| 3. | Intel Core i5-6400, Quad Core, 2.70GHz, 6MB, LGA1151, 14nm, 65W, Intel HD Graphics, VGA, TRAY/OEM |

| 4. | Patriot Signature DDR4 2x4GB 2133MHz |

| 5. | Seagate BarraCuda, 3.5", 1TB, SATA/600, 7200RPM, 64MB cache |

| 6. | LG SuperMulti SATA DVD+/-R24x,DVD+RW6x,DVD+R DL 8x, bare bulk (czarny) |

| 7. | Gembird Bezprzewodowy Zestaw Klawiatura i Mysz |

| 8. | Monitor Iiyama E2083HSD-B1 19.5inch, TN, HD+, DVI, głośniki |

| 9. | Microsoft OEM Win Home 10 64Bit Polish 1pk DVD |

Jaki skrót odpowiada poniższej masce podsieci: 255.255.248.0?

"Gorące podłączenie" ("Hot plug") oznacza, że urządzenie, które jest podłączane, ma

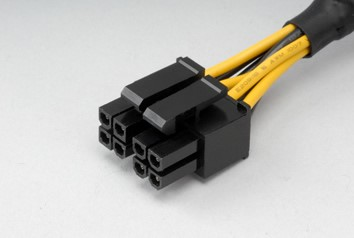

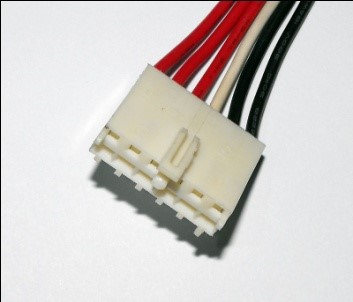

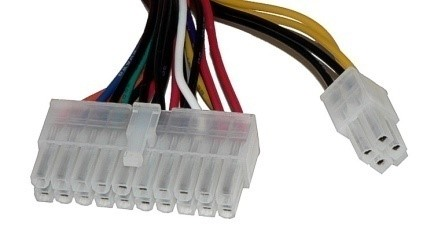

Wskaż wtyk zasilający, który podczas montażu zestawu komputerowego należy podłączyć do napędu optycznego.

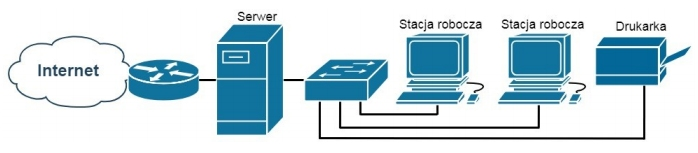

Która funkcja serwera Windows umożliwia użytkownikom końcowym sieci pokazanej na rysunku dostęp do Internetu?

W ustawieniach haseł w systemie Windows Server aktywowano opcję, że hasło musi spełniać wymagania dotyczące złożoności. Z jakiej minimalnej liczby znaków musi składać się hasło użytkownika?

Co należy zrobić, aby chronić dane przesyłane w sieci przed działaniem sniffera?

Z jakiego oprogramowania NIE można skorzystać, aby przywrócić dane w systemie Windows na podstawie wcześniej wykonanej kopii?