Pytanie 1

W systemie Linux prawa dostępu do katalogu są ustawione w formacie rwx--x--x. Jaką liczbę odpowiadają tę konfigurację praw?

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

W systemie Linux prawa dostępu do katalogu są ustawione w formacie rwx--x--x. Jaką liczbę odpowiadają tę konfigurację praw?

Na podstawie danych zawartych w tabeli dotyczącej specyfikacji płyty głównej, wskaż maksymalną liczbę kart rozszerzeń, które można zainstalować w magistrali Peripheral Component Interconnect.

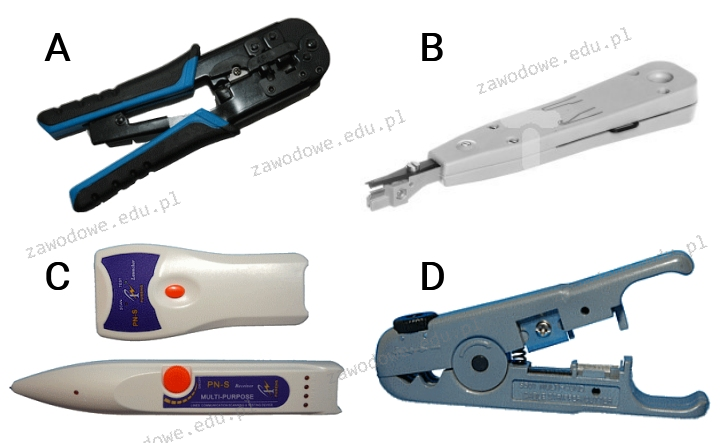

Jakie urządzenie jest używane do mocowania pojedynczych żył kabla miedzianego w złączach?

Litera S w protokole FTPS oznacza zabezpieczenie danych podczas ich przesyłania poprzez

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Metoda przesyłania danych między urządzeniem CD/DVD a pamięcią komputera w trybie bezpośredniego dostępu do pamięci to

Który z protokołów umożliwia terminalowe połączenie ze zdalnymi urządzeniami, zapewniając jednocześnie transfer danych w zaszyfrowanej formie?

Poprzez użycie opisanego urządzenia możliwe jest wykonanie diagnostyki działania

Jakie polecenie w systemie Windows należy użyć, aby ustalić liczbę ruterów pośrednich znajdujących się pomiędzy hostem źródłowym a celem?

Aby zmienić port drukarki zainstalowanej w systemie Windows, która funkcja powinna zostać użyta?

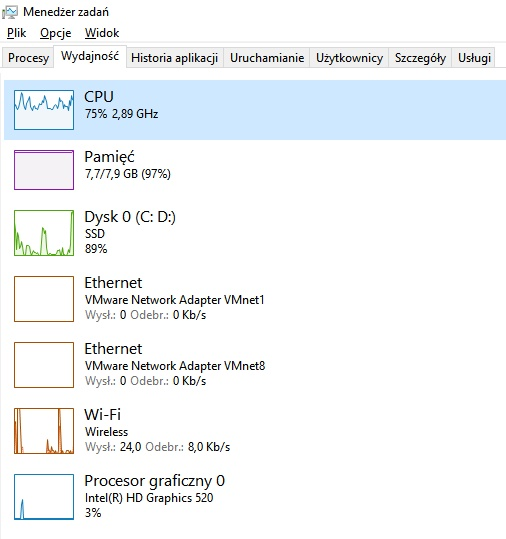

Grafik komputerowy sygnalizuje bardzo wolną pracę komputera. Z ilustracji przedstawiającej okno wydajności komputera wynika, że przyczyną tego może być

Wskaż cechę platformy wirtualizacji Hyper-V.

Jakie urządzenie służy do pomiaru wartości mocy zużywanej przez komputerowy zestaw?

Do instalacji i usuwania oprogramowania w systemie Ubuntu wykorzystywany jest menedżer

Główny protokół stosowany do ustalania ścieżki i przesyłania nią pakietów danych w sieci komputerowej to

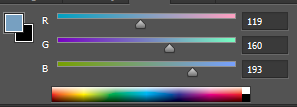

Przedstawiony na rysunku kolor zapisany w modelu RGB, w systemie szesnastkowym będzie zdefiniowany następująco

W instrukcji obsługi karty dźwiękowej można znaleźć następujące dane: - częstotliwość próbkowania wynosząca 22 kHz, - rozdzielczość wynosząca 16 bitów. Jaką przybliżoną objętość będzie miało mono jednokanałowe nagranie dźwiękowe trwające 10 sekund?

Jakie urządzenie NIE powinno być serwisowane podczas korzystania z urządzeń antystatycznych?

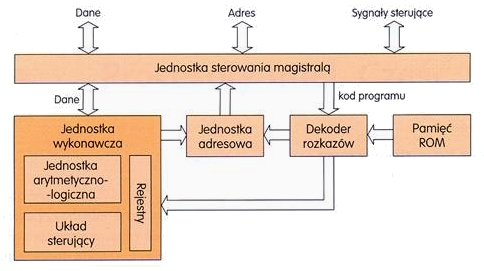

Na ilustracji przedstawiony jest schemat konstrukcji logicznej

Jakie urządzenie peryferyjne komputera służy do wycinania, drukowania oraz frezowania?

Usterka zaprezentowana na ilustracji, widoczna na monitorze, nie może być spowodowana przez

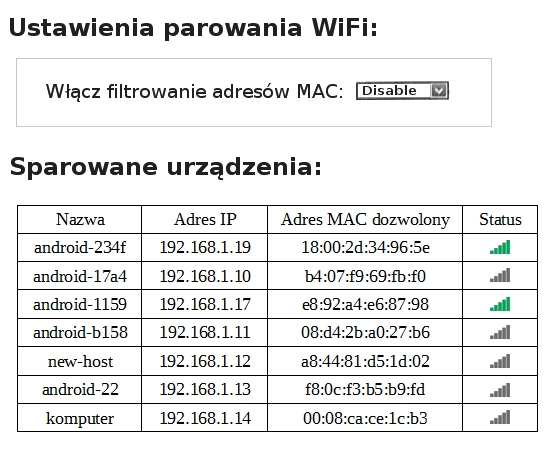

Na rysunku przedstawiono konfigurację urządzenia WiFi. Wskaż, które z poniższych stwierdzeń dotyczących tej konfiguracji jest poprawne?

Aby zabezpieczyć system przed oprogramowaniem o zdolności do samoreplikacji, należy zainstalować

Zapis liczby w systemie oznaczonym jako #108 to

Jakie polecenie w systemie Windows powinno być użyte do sprawdzania aktywnych połączeń karty sieciowej w komputerze?

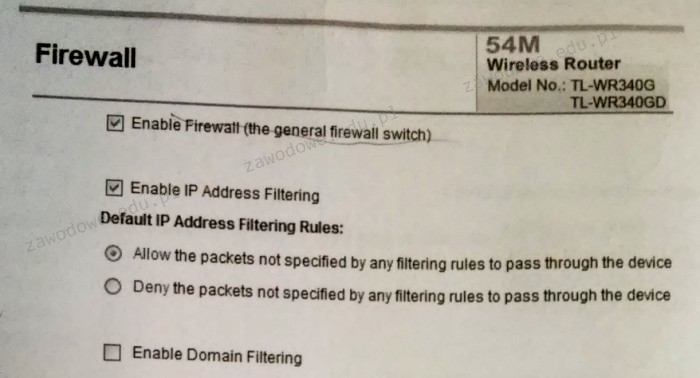

Poniższy rysunek ilustruje ustawienia zapory ogniowej w ruterze TL-WR340G. Jakie zasady dotyczące konfiguracji zapory zostały zastosowane?

W systemie Linux komenda chown pozwala na

Jakie jest kluczowe zadanie protokołu ICMP?

Przedstawione narzędzie jest przeznaczone do

Którym poleceniem można skonfigurować uprawnienia do zasobów sieciowych w systemie Windows?

Jaką liczbę komputerów można zaadresować w sieci z maską 255.255.255.224?

Aby przywrócić dane, które zostały usunięte za pomocą kombinacji klawiszy Shift + Delete, co należy zrobić?

Kabel pokazany na ilustracji może być zastosowany do realizacji okablowania sieci o standardzie

Aby sprawdzić statystyki użycia pamięci wirtualnej w systemie Linux, należy sprawdzić zawartość pliku

Analiza uszkodzonych elementów komputera poprzez ocenę stanu wyjściowego układu cyfrowego pozwala na

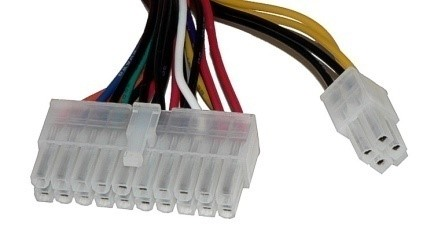

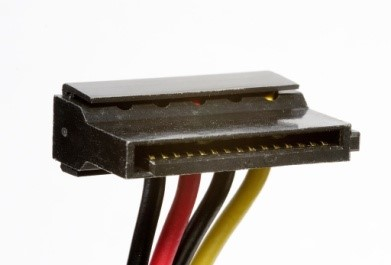

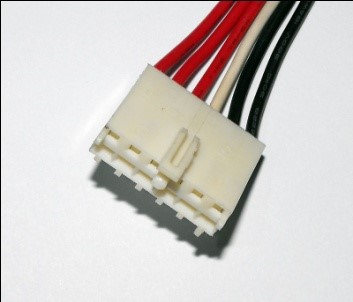

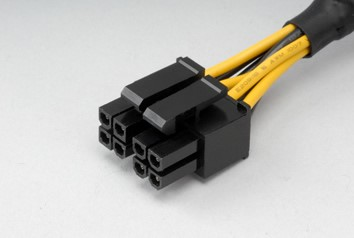

Wskaż wtyk zasilający, który podczas montażu zestawu komputerowego należy podłączyć do napędu optycznego.

Termin gorącego podłączenia (hot-plug) wskazuje, że podłączane urządzenie działa

Na rysunku ukazany jest diagram blokowy zasilacza

Na rysunku można zobaczyć schemat topologii fizycznej, która jest kombinacją topologii

W systemie adresacji IPv6 adres ff00::/8 definiuje