Pytanie 1

Do konwersji kodu źródłowego na program wykonywalny używany jest

Wynik: 24/40 punktów (60,0%)

Wymagane minimum: 20 punktów (50%)

Do konwersji kodu źródłowego na program wykonywalny używany jest

Który standard złącza DVI pozwala na przesyłanie wyłącznie sygnałów analogowych?

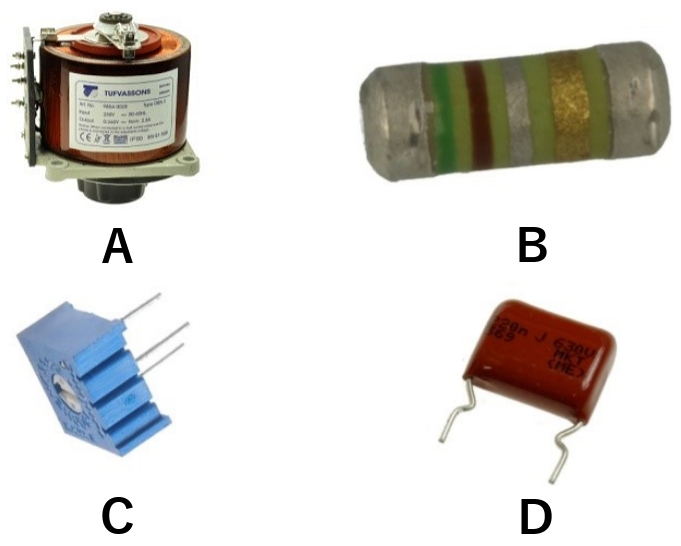

Wskaż ilustrację przedstawiającą kondensator stały?

Który protokół jest odpowiedzialny za przekształcanie adresów IP na adresy MAC w kontroli dostępu do nośnika?

Dane dotyczące kont użytkowników w systemie LINUX są zapisane w pliku

Jaki interfejs umożliwia transfer danych w formie cyfrowej i analogowej między komputerem a monitorem?

Które z poniższych stwierdzeń na temat protokołu DHCP jest poprawne?

W schemacie logicznym okablowania strukturalnego, zgodnie z terminologią polską zawartą w normie PN-EN 50174, cechą kondygnacyjnego punktu dystrybucyjnego jest to, że

Jaki program powinien zostać zainstalowany na serwerze internetowym opartym na Linuxie, aby umożliwić korzystanie z baz danych?

Komputer z adresem IP 192.168.5.165 oraz maską podsieci 255.255.255.192 funkcjonuje w sieci o adresie

Jakie informacje zwraca polecenie netstat -a w systemie Microsoft Windows?

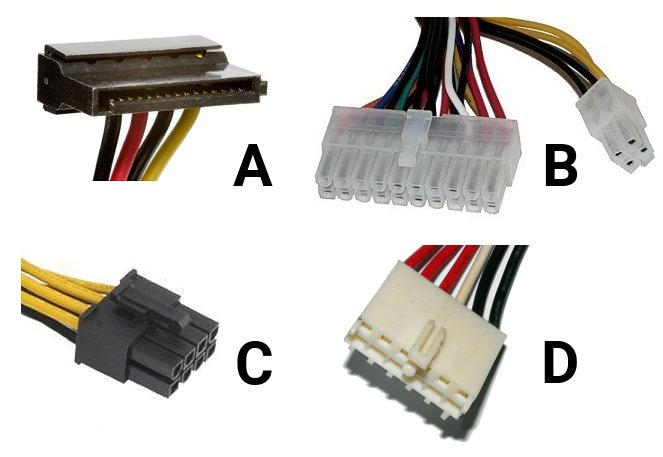

Wtyczka zasilająca SATA ma uszkodzony żółty przewód. Jakie to niesie za sobą konsekwencje dla napięcia na złączu?

W trakcie instalacji systemu Windows, zaraz po rozpoczęciu instalacji w trybie graficznym, istnieje możliwość otwarcia Wiersza poleceń (konsoli) za pomocą kombinacji klawiszy

W systemie Windows 7 program Cipher.exe w trybie poleceń jest używany do

Jaką funkcję pełni mechanizm umożliwiający przechowywanie fragmentów dużych plików programów i danych, które nie mogą być w pełni załadowane do pamięci?

Programem służącym do archiwizacji danych w systemie Linux jest

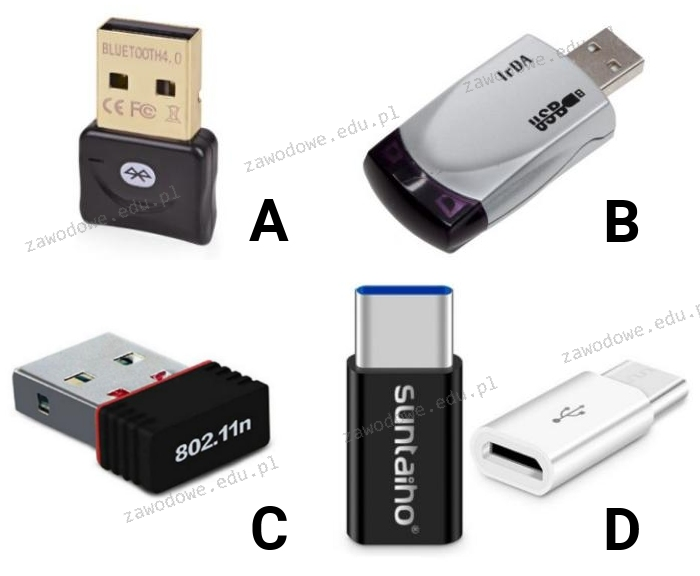

Jakie urządzenie powinno być użyte do podłączenia urządzenia peryferyjnego, które posiada bezprzewodowy interfejs do komunikacji wykorzystujący fale świetlne w podczerwieni, z laptopem, który nie jest w niego wyposażony, ale dysponuje interfejsem USB?

Jaki jest standard 1000Base-T?

Element drukujący, składający się z wielu dysz połączonych z mechanizmem drukującym, znajduje zastosowanie w drukarce

Która z wymienionych właściwości kabla koncentrycznego RG-58 sprawia, że nie jest on obecnie używany do tworzenia lokalnych sieci komputerowych?

W dokumentacji powykonawczej dotyczącej fizycznej oraz logicznej struktury sieci lokalnej powinny być zawarte

Jaką minimalną ilość pamięci RAM powinien mieć komputer, aby zainstalować 32-bitowy system operacyjny Windows 7 i móc efektywnie korzystać z trybu graficznego?

Jaką usługę wykorzystuje się do automatycznego przypisywania adresów IP do komputerów w sieci?

Jakim interfejsem można uzyskać transmisję danych o maksymalnej przepustowości 6 Gb/s?

Wykonanie polecenia perfmon w terminalu systemu Windows spowoduje

Członkowie grupy Pracownicy nie mają możliwości drukowania dokumentów za pośrednictwem serwera wydruku w systemie Windows Server. Posiadają jedynie przydzielone uprawnienia 'Zarządzanie dokumentami'. Co trzeba zrobić, aby rozwiązać ten problem?

Zarządzaniem drukarkami w sieci, obsługiwaniem zadań drukowania oraz przyznawaniem uprawnień do drukarek zajmuje się serwer

Użytkownik dysponuje komputerem o podanej konfiguracji i systemie Windows 7 Professional 32bit. Która z opcji modernizacji komputera NIE przyczyni się do zwiększenia wydajności?

| Płyta główna | ASRock Z97 Anniversary Z97 DualDDR3-1600 SATA3 RAID HDMI ATX z czterema slotami DDR3 i obsługą RAID poziomu 0,1 |

| Procesor | i3 |

| Pamięć | 1 x 4 GB DDR3 |

| HDD | 2 x 1 TB |

Jednym z narzędzi zabezpieczających system przed oprogramowaniem, które bez wiedzy użytkownika pozyskuje i wysyła jego autorowi dane osobowe, numery kart płatniczych, informacje o adresach stron WWW odwiedzanych przez użytkownika, hasła i używane adresy mailowe, jest program

Protokół TCP (Transmission Control Protocol) funkcjonuje w trybie

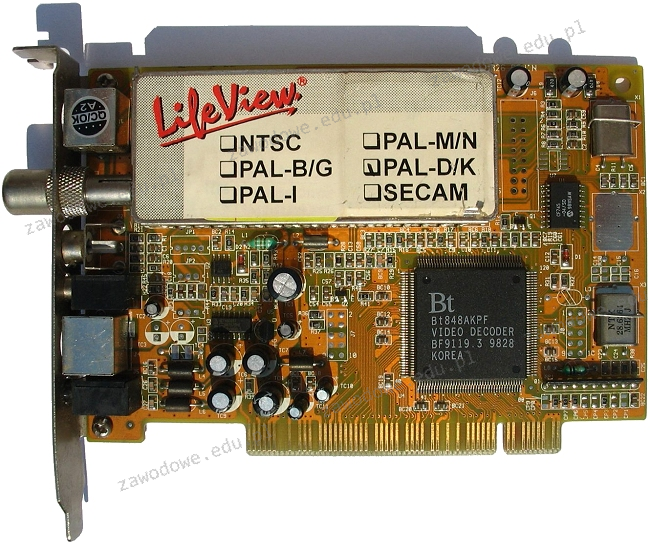

Zainstalowanie w komputerze przedstawionej karty pozwoli na

Podczas realizacji projektu sieci LAN zastosowano medium transmisyjne zgodne ze standardem Ethernet 1000Base-T. Które z poniższych stwierdzeń jest prawdziwe?

Wskaż rodzaj wtyczki zasilającej, którą należy podłączyć do napędu optycznego podczas montażu komputera.

Cienki klient (thin client) korzysta z protokołu

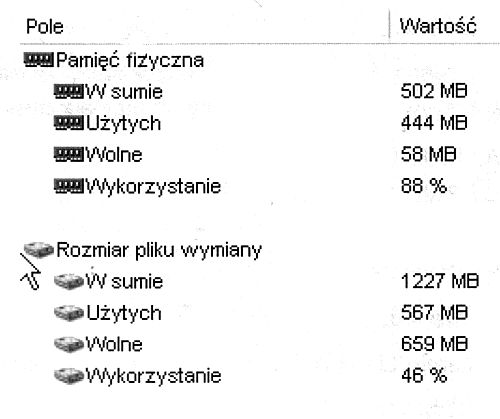

Zgodnie z zamieszczonym fragmentem testu w systemie komputerowym zainstalowane są

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Montaż przedstawionej karty graficznej będzie możliwy na płycie głównej wyposażonej w złącze

Złącze SC stanowi standard w cablach

Zainstalowanie gniazda typu keystone w serwerowej szafie jest możliwe w

W której warstwie modelu odniesienia ISO/OSI działają protokoły IP oraz ICMP?