Pytanie 1

Drukarka, która zapewnia zdjęcia o wysokiej jakości to drukarka

Wynik: 19/40 punktów (47,5%)

Wymagane minimum: 20 punktów (50%)

Drukarka, która zapewnia zdjęcia o wysokiej jakości to drukarka

Aktywacja opcji OCR w procesie ustawiania skanera umożliwia

Jak można przywrócić domyślne ustawienia płyty głównej, gdy nie ma możliwości uruchomienia BIOS Setup?

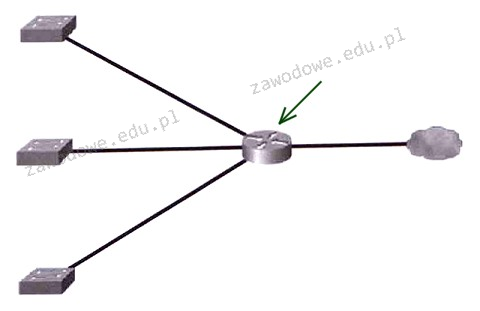

Jaki symbol urządzenia jest pokazany przez strzałkę na rysunku?

W przypadku, gdy w tej samej przestrzeni będą funkcjonować jednocześnie dwie sieci WLAN zgodne ze standardem 802.11g, w celu zminimalizowania ryzyka wzajemnych zakłóceń, powinny one otrzymać kanały o numerach różniących się o

Na ilustracji złącze monitora, które zostało zaznaczone czerwoną ramką, będzie współdziałać z płytą główną posiadającą interfejs

Podczas zamykania systemu operacyjnego na ekranie pojawił się błąd, tak zwany bluescreen, 0x000000F3 Bug Check 0xF3 DISORDERLY_SHUTDOWN – niepowodzenie zamykania systemu, spowodowane brakiem pamięci. Błąd ten może wskazywać na

Gdy komputer się uruchamia, na ekranie wyświetla się komunikat "CMOS checksum error press F1 to continue press DEL to setup". Naciśnięcie klawisza DEL spowoduje

Członkostwo komputera w danej sieci wirtualnej nie może być ustalane na podstawie

Jaką maksymalną liczbę hostów można przypisać w sieci o adresie IP klasy B?

Jaki protokół jest stosowany do przesyłania danych w warstwie transportowej modelu ISO/OSI?

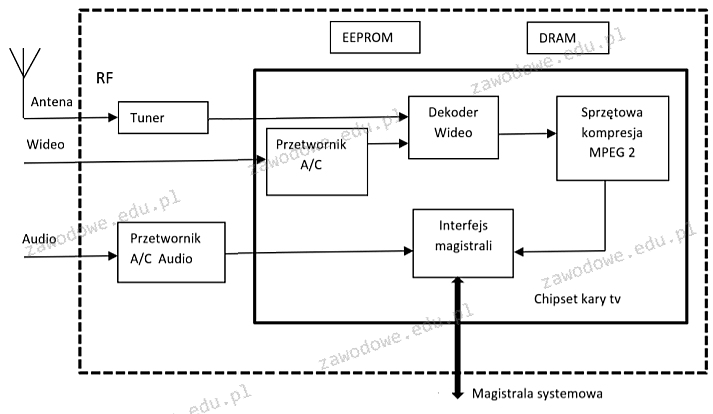

Na ilustracji zaprezentowano schemat blokowy karty

Które medium transmisyjne umożliwia izolację galwaniczną pomiędzy systemami przesyłu danych?

Jaką wartość ma największa liczba 16-bitowa?

Jakim elementem sieci SIP jest telefon IP?

Trudności w systemie operacyjnym Windows wynikające z konfliktów dotyczących zasobów sprzętowych, takich jak przydział pamięci, przerwań IRQ oraz kanałów DMA, najłatwiej zidentyfikować za pomocą narzędzia

Który procesor jest kompatybilny z płytą główną o przedstawionej specyfikacji?

ASUS micro-ATX, socket 1150, VT-d, DDR3 `1333, 1600 MHz), ATI Radeon X1250, 3 x PCI-Express x1, 3 x PCI-Express x16, 2 x Serial ATA III, USB 3.0, VGA, HDMI, DVI-D

Oprogramowanie OEM (Original Equipment Manufacturer) jest przypisane do

Jak wielu hostów można maksymalnie zaadresować w sieci lokalnej, mając do dyspozycji jeden blok adresów klasy C protokołu IPv4?

Emisja dźwięków: jednego długiego oraz dwóch krótkich przez BIOS firmy AMI wskazuje na

Jaki typ plików powinien być stworzony w systemie operacyjnym, aby zautomatyzować najczęściej wykonywane zadania, takie jak kopiowanie, utworzenie pliku lub folderu?

Jakie polecenie należy wprowadzić w konsoli, aby skorygować błędy na dysku?

Kabel pokazany na ilustracji może być zastosowany do realizacji okablowania sieci o standardzie

Menedżer urządzeń w systemie Windows pozwala na wykrycie

Jakie urządzenie peryferyjne komputera służy do wycinania, drukowania oraz frezowania?

Który standard złącza DVI pozwala na przesyłanie wyłącznie sygnałów analogowych?

Jak określana jest transmisja w obie strony w sieci Ethernet?

Program typu recovery, w warunkach domowych, pozwala na odzyskanie danych z dysku twardego w przypadku

Drukarka fotograficzna ma bardzo brudną obudowę oraz wyświetlacz. Aby usunąć zabrudzenia bez ich uszkodzenia, należy użyć

Liczba 45(H) przedstawiona w systemie ósemkowym jest równa

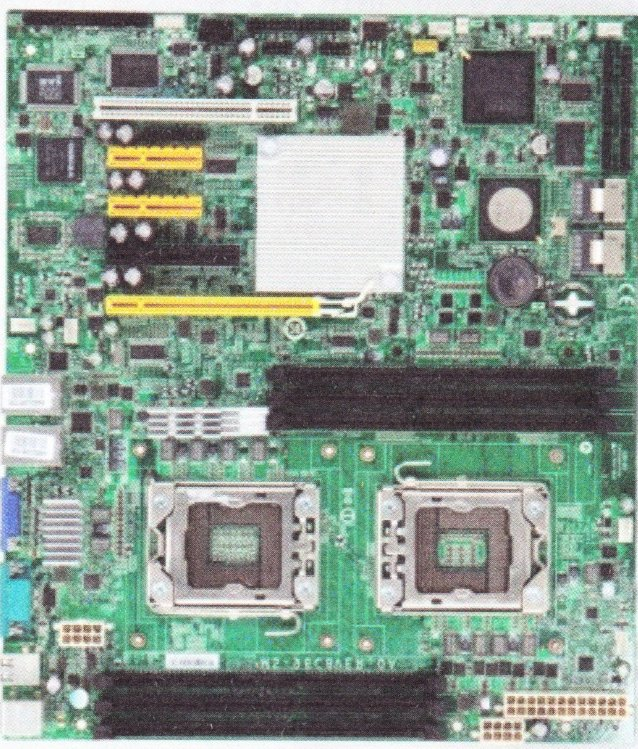

W komputerze użyto płyty głównej widocznej na obrazku. Aby podnieść wydajność obliczeniową maszyny, zaleca się

Wskaż technologię stosowaną do dostarczania Internetu, która jest połączona z usługą telewizji kablowej, w której światłowód oraz kabel koncentryczny pełnią rolę medium transmisyjnego.

Który z wymienionych elementów stanowi część mechanizmu drukarki igłowej?

Podstawowy rekord uruchamiający na dysku twardym to

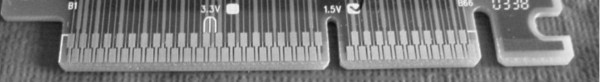

Na ilustracji przedstawiono fragment karty graficznej ze złączem

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Sprzętem, który umożliwia wycinanie wzorów oraz grawerowanie w różnych materiałach, takich jak drewno, szkło i metal, jest ploter

Do pielęgnacji elementów łożyskowych oraz ślizgowych w urządzeniach peryferyjnych wykorzystuje się

W którym z rejestrów wewnętrznych procesora są przechowywane dodatkowe informacje o wyniku realizowanej operacji?

Zastosowanie programu Wireshark polega na