Pytanie 1

Wskaż znak umieszczany na urządzeniach elektrycznych przeznaczonych do obrotu i sprzedaży w Unii Europejskiej.

Wynik: 13/40 punktów (32,5%)

Wymagane minimum: 20 punktów (50%)

Wskaż znak umieszczany na urządzeniach elektrycznych przeznaczonych do obrotu i sprzedaży w Unii Europejskiej.

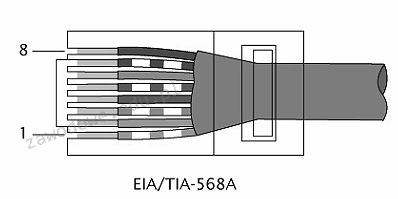

Czym jest patchcord?

Włączenie systemu Windows w trybie debugowania umożliwia

Który podzespół nie jest kompatybilny z płytą główną MSI A320M Pro-VD-S socket AM4, 1 x PCI-Ex16, 2 x PCI-Ex1, 4 x SATA III, 2 x DDR4- max 32 GB, 1 x D-SUB, 1x DVI-D, ATX?

Które z poniższych stwierdzeń odnosi się do sieci P2P – peer to peer?

Technologia ADSL pozwala na nawiązanie połączenia DSL

Który interfejs pozwala na korzystanie ze sterowników oraz oprogramowania systemu operacyjnego, umożliwiając m.in. przesył danych pomiędzy pamięcią systemową a dyskiem SATA?

Klient przyniósł do serwisu uszkodzony sprzęt komputerowy. W trakcie procedury odbioru sprzętu, przed rozpoczęciem jego naprawy, serwisant powinien

Jaką maskę podsieci powinien mieć serwer DHCP, aby mógł przydzielić adresy IP dla 510 urządzeń w sieci o adresie 192.168.0.0?

Jak nazywa się współpracujące z monitorami CRT urządzenie wskazujące z końcówką wyposażoną w światłoczuły element, która poprzez dotknięcie ekranu monitora powoduje przesłanie sygnału do komputera, umożliwiając w ten sposób lokalizację kursora?

Narzędzie chroniące przed nieautoryzowanym dostępem do lokalnej sieci, to

Jaką kwotę trzeba będzie przeznaczyć na zakup kabla UTP kat.5e do zbudowania sieci komputerowej składającej się z 6 stanowisk, gdzie średnia odległość każdego stanowiska od przełącznika wynosi 9 m? Należy uwzględnić 1 m zapasu dla każdej linii kablowej, a cena za 1 metr kabla to 1,50 zł?

W systemie Windows, aby udostępnić folder jako ukryty, należy na końcu nazwy udostępniania umieścić znak

Jakie informacje można uzyskać za pomocą programu Wireshark?

Po włączeniu komputera wyświetlił się komunikat "Non-system disk or disk error. Replace and strike any key when ready". Może to być spowodowane

Aby osiągnąć przepustowość 4 GB/s w obydwie strony, konieczne jest zainstalowanie w komputerze karty graficznej używającej interfejsu

Jaki parametr powinien być użyty do wywołania komendy netstat, aby pokazać statystykę interfejsu sieciowego (ilość wysłanych oraz odebranych bajtów i pakietów)?

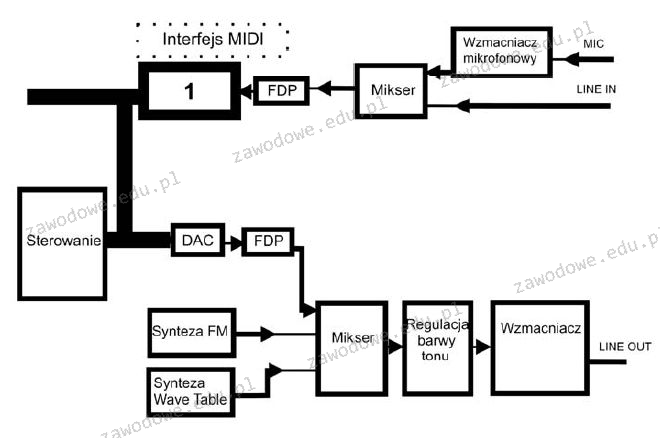

Schemat blokowy karty dźwiękowej jest przedstawiony na rysunku. Jaką rolę odgrywa układ oznaczony numerem 1?

Użycie skrętki kategorii 6 (CAT 6) o długości 20 metrów w sieci LAN oznacza jej maksymalną przepustowość wynoszącą

W przypadku drukarki igłowej, jaki materiał eksploatacyjny jest używany?

Jaką minimalną ilość pamięci RAM musi mieć komputer, aby móc uruchomić 64-bitowy system operacyjny Windows 7 w trybie graficznym?

Aby podłączyć kasę fiskalną wyposażoną w złącze komunikacyjne DB-9M do komputera stacjonarnego, należy zastosować przewód

Które z poniższych twierdzeń nie odnosi się do pamięci cache L1?

W załączonej ramce przedstawiono opis technologii

| Technologia ta to rewolucyjna i nowatorska platforma, która pozwala na inteligentne skalowanie wydajności podsystemu graficznego poprzez łączenie mocy kilku kart graficznych NVIDIA pracujących na płycie głównej. Dzięki wykorzystaniu zastrzeżonych algorytmów oraz wbudowanej w każdy z procesorów graficznych NVIDIA dedykowanej logiki sterującej, która odpowiada za skalowanie wydajności, technologia ta zapewnia do 2 razy (w przypadku dwóch kart) lub 2,8 razy (w przypadku trzech kart) wyższą wydajność niż w przypadku korzystania z pojedynczej karty graficznej. |

W technologii Ethernet 100BaseTX do przesyłania danych wykorzystywane są żyły kabla UTP podłączone do pinów

W celu zainstalowania serwera proxy w systemie Linux, należy wykorzystać oprogramowanie

Który z zapisów adresu IPv4 z maską jest niepoprawny?

Który z wymienionych elementów stanowi część mechanizmu drukarki igłowej?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Aby ustalić fizyczny adres karty sieciowej, w terminalu systemu Microsoft Windows należy wpisać komendę

Do zainstalowania serwera proxy w systemie Linux, konieczne jest zainstalowanie aplikacji

Technik serwisowy, po przeprowadzeniu testu na serwerze NetWare, otrzymał informację, że obiekt dysponuje prawem

Liczba heksadecymalna 1E2F(16) w systemie oktalnym jest przedstawiana jako

Jakie narzędzie pozwala na zarządzanie menedżerem rozruchu w systemach Windows od wersji Vista?

Jakim protokołem jest protokół dostępu do sieci pakietowej o maksymalnej prędkości 2 Mbit/s?

Wskaż aplikację w systemie Linux, która służy do kompresji plików.

Narzędziem służącym do monitorowania efektywności oraz niezawodności w systemach Windows 7, Windows Server 2008 R2 i Windows Vista jest

Jakie właściwości topologii fizycznej sieci zostały przedstawione w poniższej ramce?

Jaki typ plików powinien być stworzony w systemie operacyjnym, aby zautomatyzować najczęściej wykonywane zadania, takie jak kopiowanie, utworzenie pliku lub folderu?

Jaka jest maska dla adresu IP 192.168.1.10/8?