Pytanie 1

Podaj adres rozgłoszeniowy sieci, do której przynależy host o adresie 88.89.90.91/6?

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Podaj adres rozgłoszeniowy sieci, do której przynależy host o adresie 88.89.90.91/6?

Jak nazywa się topologia fizyczna, w której każdy węzeł łączy się bezpośrednio ze wszystkimi innymi węzłami?

Czym jest dziedziczenie uprawnień?

Funkcja failover usługi DHCP umożliwia

Aby usunąć konto użytkownika student w systemie operacyjnym Ubuntu, można skorzystać z komendy

Aby nagrać dane na nośniku przedstawionym na ilustracji, konieczny jest odpowiedni napęd

Aby przywrócić dane, które zostały usunięte za pomocą kombinacji klawiszy Shift + Delete, co należy zrobić?

Ikona błyskawicy widoczna na ilustracji służy do identyfikacji złącza

Którą czynność należy wykonać podczas konfiguracji rutera, aby ukryta sieć bezprzewodowa była widoczna dla wszystkich użytkowników znajdujących się w jej zasięgu?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Najefektywniejszym zabezpieczeniem danych firmy, której siedziby znajdują się w różnych, odległych od siebie lokalizacjach, jest zastosowanie

Jaki program powinien zostać zainstalowany na serwerze internetowym opartym na Linuxie, aby umożliwić korzystanie z baz danych?

W systemie Linux plik posiada uprawnienia ustawione na 765. Grupa przypisana do tego pliku ma możliwość

Lokalny komputer posiada adres 192.168.0.5. Po otwarciu strony internetowej z tego urządzenia, która rozpoznaje adresy w sieci, wyświetla się informacja, że jego adres to 195.182.130.24. Co to oznacza?

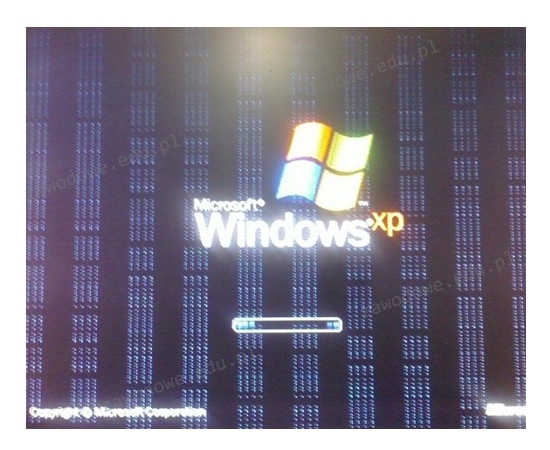

Usterka zaprezentowana na ilustracji, widoczna na monitorze, nie może być spowodowana przez

Jakie polecenie w systemach Windows należy użyć, aby ustawić statyczny adres IP w konsoli poleceń?

W systemie Windows, który wspiera przydziały dyskowe, użytkownik o nazwie Gość

Która z poniższych topologii sieciowych charakteryzuje się centralnym węzłem, do którego podłączone są wszystkie inne urządzenia?

W metodzie archiwizacji danych nazwanej Dziadek – Ojciec – Syn na poziomie Dziadek przeprowadza się kopię danych na koniec

Interfejs HDMI w komputerze umożliwia przesyłanie sygnału

Jaki adres IPv6 jest stosowany jako adres link-local w procesie autokonfiguracji urządzeń?

Wskaż rysunek ilustrujący symbol używany do oznaczania portu równoległego LPT?

fps (ang. frames per second) odnosi się bezpośrednio do

W której fizycznej topologii awaria jednego komputera powoduje przerwanie pracy całej sieci?

Niekorzystną właściwością macierzy RAID 0 jest

Jakie polecenie w systemie Windows dedykowane dla stacji roboczej, umożliwia skonfigurowanie wymagań dotyczących logowania dla wszystkich użytkowników tej stacji roboczej?

Aby sprawdzić, czy zainstalowana karta graficzna w komputerze jest przegrzewana, użytkownik ma możliwość użycia programu

Jakie napięcie jest obniżane z 230 V w zasilaczu komputerowym w standardzie ATX dla różnych podzespołów komputera?

W trakcie instalacji systemu Windows, zaraz po rozpoczęciu instalacji w trybie graficznym, istnieje możliwość otwarcia Wiersza poleceń (konsoli) za pomocą kombinacji klawiszy

Który z wymienionych parametrów procesora AMD APU A10 5700 3400 nie ma bezpośredniego wpływu na jego wydajność?

| Częstotliwość | 3400 MHz |

| Proces technologiczny | 32 nm |

| Architektura | 64 bit |

| Ilość rdzeni | 4 |

| Ilość wątków | 4 |

| Pojemność pamięci L1 (instrukcje) | 2x64 kB |

| Pojemność pamięci L1 (dane) | 4x16 kB |

| Pojemność Pamięci L2 | 2x2 MB |

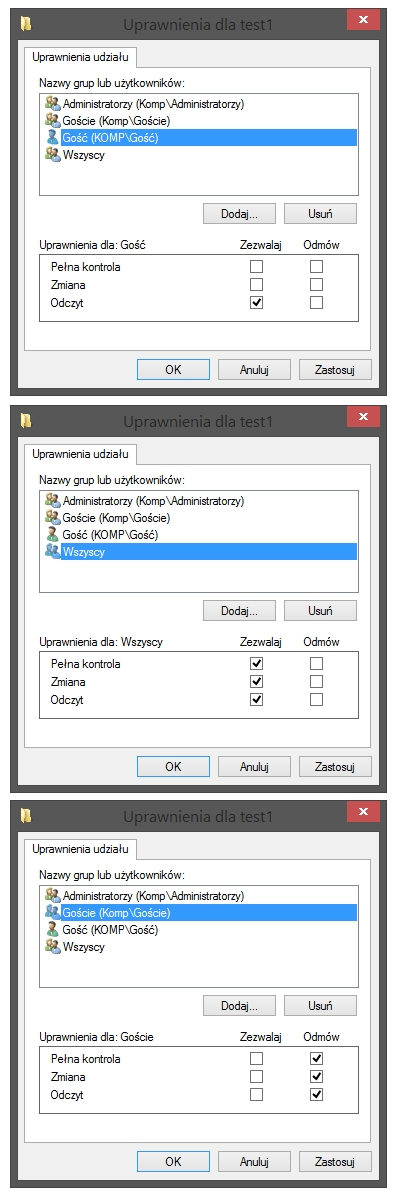

Użytkownik o nazwie Gość jest częścią grupy Goście, która z kolei należy do grupy Wszyscy. Jakie uprawnienia do folderu test1 ma użytkownik Gość?

Zaprezentowany tylny panel płyty głównej zawiera następujące interfejsy:

Protokół Transport Layer Security (TLS) jest rozwinięciem standardu

Samodzielną strukturą sieci WLAN jest

Jak określić długość prefiksu adresu sieci w adresie IPv4?

Użytkownik chce tak zmodernizować komputer, aby działały na nim gry wymagające DirectX12. Jaki system operacyjny powinien zakupić do modernizowanego komputera, aby wspierał DX12?

Który protokół służy do wymiany danych o trasach oraz dostępności sieci pomiędzy routerami w ramach tego samego systemu autonomicznego?

Jakiego numeru kodu należy użyć w komendzie do zmiany uprawnień folderu w systemie Linux, aby właściciel miał dostęp do zapisu i odczytu, grupa miała prawo do odczytu i wykonania, a pozostali użytkownicy mogli jedynie odczytywać zawartość?

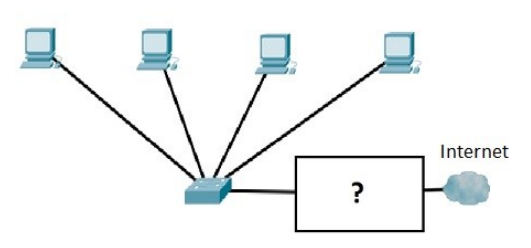

Jakie urządzenie powinno być podłączone do lokalnej sieci w miejscu zaznaczonym na rysunku, aby komputery mogły korzystać z Internetu?

Zjawisko, w którym pliki przechowywane na dysku twardym są umieszczane w nieprzylegających do siebie klastrach, nosi nazwę