Pytanie 1

Moduł w systemie Windows, który odpowiada za usługi informacyjne w Internecie, to

Wynik: 21/40 punktów (52,5%)

Wymagane minimum: 20 punktów (50%)

Moduł w systemie Windows, który odpowiada za usługi informacyjne w Internecie, to

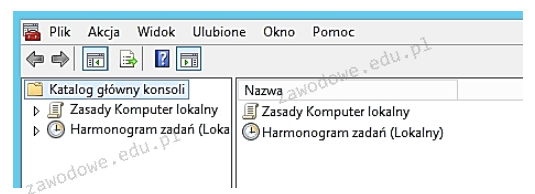

Aby otworzyć konsolę przedstawioną na ilustracji, należy wpisać w oknie poleceń

W architekturze sieci lokalnych opartej na modelu klient - serwer

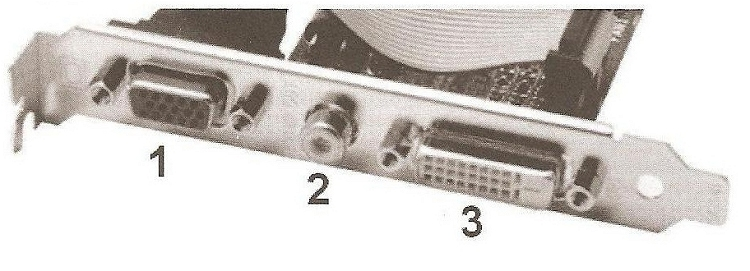

Na ilustracji widać

Czym jest NAS?

Natychmiast po dostrzeżeniu utraty istotnych plików na dysku twardym, użytkownik powinien

W systemie Windows harmonogram zadań umożliwia przydzielenie

Aby poprawić wydajność procesora serii Intel za pomocą 'podkręcania' (ang. overclocking), należy użyć procesora oznaczonego

Który program umożliwia sprawdzanie stanów portów i wykonuje próby połączeń z nimi?

Aby zapewnić maksymalną ochronę danych przy użyciu dokładnie 3 dysków, powinny one być przechowywane w macierzy RAID

Jakim protokołem komunikacyjnym, który gwarantuje niezawodne przesyłanie danych, jest protokół

Do konwersji kodu źródłowego na program wykonywalny używany jest

Modułem pamięci RAM, kompatybilnym z płytą główną GIGABYTE GA-X99- ULTRA GAMING/ X99/ 8x DDR4 2133, ECC, max 128GB/ 4x PCI-E 16x/ RAID/ USB 3.1/ S-2011-V3/ATX, jest pamięć

Na ilustracji pokazano porty karty graficznej. Które złącze jest cyfrowe?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jaką minimalną ilość pamięci RAM powinien posiadać komputer, aby możliwe było zainstalowanie 32-bitowego systemu operacyjnego Windows 7 i praca w trybie graficznym?

W tabeli zaprezentowano specyfikacje czterech twardych dysków. Dysk, który oferuje najwyższą średnią prędkość odczytu danych, to

| Pojemność | 320 GB | 320 GB | 320 GB | 320 GB |

| Liczba talerzy | 2 | 3 | 2 | 2 |

| Liczba głowic | 4 | 6 | 4 | 4 |

| Prędkość obrotowa | 7200 obr./min | 7200 obr./min | 7200 obr./min | 7200 obr./min |

| Pamięć podręczna | 16 MB | 16 MB | 16 MB | 16 MB |

| Czas dostępu | 8.3 ms | 8.9 ms | 8.5 ms | 8.6 ms |

| Interfejs | SATA II | SATA II | SATA II | SATA II |

| Obsługa NCQ | TAK | NIE | TAK | TAK |

| Dysk | A. | B. | C. | D. |

Jakie jest standardowe połączenie między skanerem a aplikacją graficzną?

Aby w systemie Windows ustawić właściwości wszystkich zainstalowanych urządzeń lub wyświetlić ich listę, należy użyć narzędzia

Elementem płyty głównej, który odpowiada za wymianę informacji pomiędzy procesorem a innymi komponentami płyty, jest

Podczas skanowania reprodukcji obrazu z magazynu, na skanie obrazu ukazały się regularne wzory, zwane morą. Jakiej funkcji skanera należy użyć, aby usunąć te wzory?

Jaką licencję musi mieć oprogramowanie, aby użytkownik mógł wprowadzać w nim zmiany?

Taśma drukująca stanowi kluczowy materiał eksploatacyjny w drukarce

Który z protokołów jest używany w komunikacji głosowej przez internet?

Protokół User Datagram Protocol (UDP) należy do

Jaka wartość dziesiętna została zapisana na jednym bajcie w kodzie znak – moduł: 1 1111111?

W systemie Linux, gdzie przechowywane są hasła użytkowników?

Jakie polecenie należy wykorzystać w systemie Linux, aby zlokalizować wszystkie pliki z rozszerzeniem txt, które znajdują się w katalogu /home/user i mają w nazwie ciąg znaków abc?

Na rysunku można zobaczyć schemat topologii fizycznej, która jest kombinacją topologii

Zamieszczone atrybuty opisują rodzaj pamięci

| Maksymalne taktowanie | 1600 MHz |

| Przepustowość | PC12800 1600MHz |

| Opóźnienie | Cycle Latency CL 9,0 |

| Korekcja | Nie |

| Dual/Quad | Dual Channel |

| Radiator | Tak |

Wskaź na błędny układ dysku z użyciem tablicy partycji MBR?

Jakie jest źródło pojawienia się komunikatu na ekranie komputera, informującego o wykryciu konfliktu adresów IP?

Jakie urządzenie ilustruje ten rysunek?

Aby przywrócić dane, które zostały usunięte za pomocą kombinacji klawiszy Shift + Delete, co należy zrobić?

Jakie urządzenie w warstwie łącza danych modelu OSI analizuje adresy MAC zawarte w ramkach Ethernet i na tej podstawie decyduje o przesyłaniu sygnału pomiędzy segmentami sieci lub jego blokowaniu?

Dostosowanie ustawień parametrów TCP/IP urządzenia na podstawie adresu MAC karty sieciowej jest funkcją protokołu

Jakie urządzenie pozwala na podłączenie drukarki, która nie ma karty sieciowej, do lokalnej sieci komputerowej?

Rodzajem macierzy RAID, która nie jest odporna na awarię dowolnego z dysków wchodzących w jej skład, jest

Aby zainstalować serwer FTP w systemach z rodziny Windows Server, konieczne jest dodanie roli serwera

Aby w systemie Windows XP stworzyć nowego użytkownika o nazwisku egzamin z hasłem qwerty, powinno się zastosować polecenie