Pytanie 1

Najskuteczniejszym sposobem na codzienną archiwizację pojedynczego pliku o objętości 4,8 GB, na jednym komputerze bez dostępu do sieci, jest

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Najskuteczniejszym sposobem na codzienną archiwizację pojedynczego pliku o objętości 4,8 GB, na jednym komputerze bez dostępu do sieci, jest

W systemie Linux, aby uzyskać informację o nazwie aktualnego katalogu roboczego, należy użyć polecenia

Jaki rodzaj kabla powinien być użyty do podłączenia komputera w miejscu, gdzie występują zakłócenia elektromagnetyczne?

Emisja przez BIOS firmy AMI jednego długiego oraz dwóch krótkich sygnałów dźwiękowych oznacza

Po przeprowadzeniu diagnostyki komputera stwierdzono, że temperatura pracy karty graficznej z wyjściami HDMI oraz D-SUB, umieszczonej w gnieździe PCI Express stacjonarnego komputera, wynosi 87°C. W takiej sytuacji serwisant powinien

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Przy użyciu urządzenia zobrazowanego na rysunku możliwe jest sprawdzenie działania

Podczas zamykania systemu operacyjnego na ekranie pojawił się błąd, tak zwany bluescreen, 0x000000F3 Bug Check 0xF3 DISORDERLY_SHUTDOWN – niepowodzenie zamykania systemu, spowodowane brakiem pamięci. Błąd ten może wskazywać na

Zasilacz UPS o mocy nominalnej 480 W nie powinien być używany do zasilania

Partycja, na której zainstalowany jest system operacyjny, określana jest jako partycja

Aby zabezpieczyć system przed oprogramowaniem mającym możliwość reprodukcji, konieczne jest zainstalowanie

Jak określa się atak w sieci lokalnej, który polega na usiłowaniu podszycia się pod inną osobę?

Jakie czynności nie są realizowane przez system operacyjny?

Użytkownik chce zabezpieczyć mechanicznie dane na karcie pamięci przed przypadkowym skasowaniem. Takie zabezpieczenie umożliwia karta

Standard IEEE 802.11b dotyczy sieci

Która z poniższych opcji nie jest wykorzystywana do zdalnego zarządzania stacjami roboczymi?

Aby utworzyć kontroler domeny w systemach z rodziny Windows Server na serwerze lokalnym, konieczne jest zainstalowanie roli

Jaką normę odnosi się do okablowania strukturalnego?

Która z kopii w trakcie archiwizacji plików pozostawia ślad archiwizacji?

Aby zrealizować usługę zdalnego uruchamiania systemów operacyjnych na komputerach stacjonarnych, należy w Windows Server zainstalować rolę

Mamy do czynienia z siecią o adresie 192.168.100.0/24. Ile podsieci można utworzyć, stosując maskę 255.255.255.224?

Instalacja systemów Linux oraz Windows 7 odbyła się bez żadnych problemów. Systemy zainstalowały się prawidłowo z domyślnymi konfiguracjami. Na tym samym komputerze, przy tej samej specyfikacji, podczas instalacji systemu Windows XP pojawił się komunikat o braku dysków twardych, co może sugerować

Na schemacie przedstawiono sieć o strukturze

Komenda msconfig uruchamia w systemie Windows:

Diody LED RGB funkcjonują jako źródło światła w różnych modelach skanerów

Administrator dostrzegł, że w sieci LAN występuje wiele kolizji. Jakie urządzenie powinien zainstalować, aby podzielić sieć lokalną na mniejsze domeny kolizji?

Który z protokołów jest używany podczas rozpoczynania sesji VoIP?

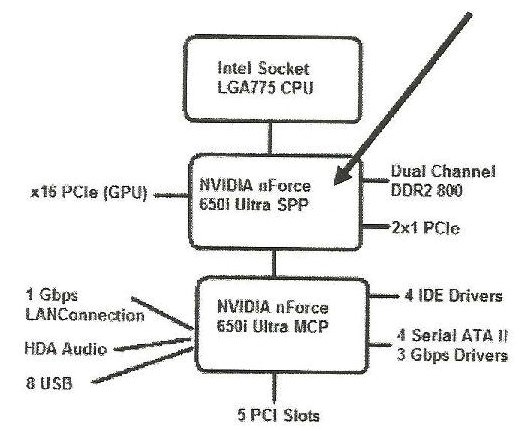

Jaką rolę pełni komponent wskazany strzałką na schemacie chipsetu płyty głównej?

Z jakiego oprogramowania NIE można skorzystać, aby przywrócić dane w systemie Windows na podstawie wcześniej wykonanej kopii?

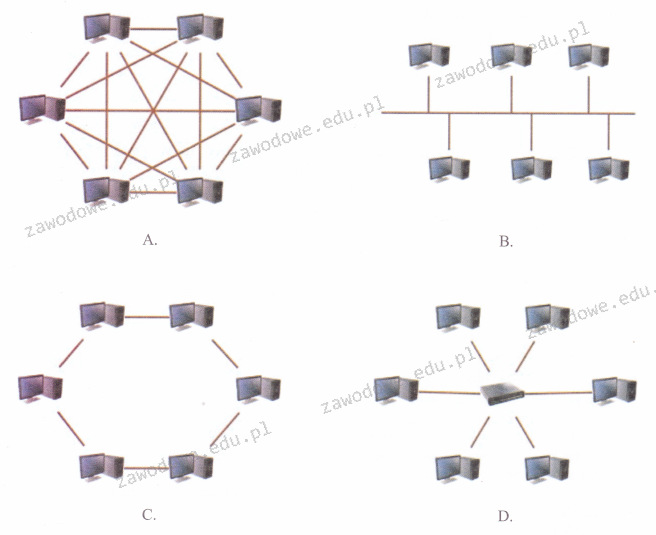

Topologia fizyczna, w której każdy węzeł łączy się z wszystkimi innymi węzłami, to topologia

Jakie urządzenia dotyczą terminy SLI?

Polecenie Gpresult

Graficzny symbol odnosi się do standardów sprzętowych

Jaki adres IP w formacie dziesiętnym odpowiada adresowi IP 10101010.00001111.10100000.11111100 zapisanym w formacie binarnym?

Materiałem eksploatacyjnym stosowanym w drukarkach tekstylnych jest

Która usługa pozwala na zdalne logowanie do komputerów, wykonywanie poleceń systemowych oraz zarządzanie siecią?

Która z zaprezentowanych na rysunkach topologii odpowiada topologii siatki?

Zjawisko crosstalk, które występuje w sieciach komputerowych, polega na

Który standard Gigabit Ethernet pozwala na tworzenie segmentów sieci o długości 550 m lub 5000 m przy prędkości transmisji 1 Gb/s?

Rysunek obrazuje zasadę działania drukarki