Pytanie 1

Na przedstawionym rysunku zaprezentowane jest złącze

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Na przedstawionym rysunku zaprezentowane jest złącze

Jaki jest główny cel stosowania maski podsieci?

Okablowanie pionowe w sieci strukturalnej łączy się

W systemie Windows 7 aby skopiować folder c:\test wraz z jego podfolderami na dysk zewnętrzny f:\, należy zastosować polecenie

Jaką topologię fizyczną sieci komputerowej przedstawia załączony rysunek?

Jakie polecenie w systemie Linux umożliwia wyświetlenie zawartości katalogu?

Jak nazywa się licencja w systemie Windows Server, która pozwala użytkownikom komputerów stacjonarnych na korzystanie z usług serwera?

Aby zmierzyć tłumienie łącza światłowodowego w dwóch zakresach transmisyjnych 1310nm oraz 1550nm, powinno się zastosować

Jaką sumę należy zapłacić za wymianę karty graficznej w komputerze, jeżeli cena karty wynosi 250 zł, a czas wymiany przez pracownika serwisu to 80 minut, przy czym każda rozpoczęta godzina pracy kosztuje 50 zł?

Domyślnie w programie Eksplorator Windows przy użyciu klawisza F5 uruchamiana jest funkcja

Profil użytkownika systemu Windows, który można wykorzystać do logowania na dowolnym komputerze w sieci, przechowywany na serwerze i mogący być edytowany przez użytkownika, to profil

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

W dokumentacji technicznej procesora Intel Xeon Processor E3-1220, producent przedstawia następujące dane: # rdzeni: 4 # wątków: 4 Częstotliwość zegara: 3.1 GHz Maksymalna częstotliwość Turbo: 3.4 GHz Intel Smart Cache: 8 MB DMI: 5 GT/s Zestaw instrukcji: 64 bit Rozszerzenia zestawu instrukcji: SSE4.1/4.2, AVX Opcje wbudowane: Nie Litografia: 32 nm Maksymalne TDP: 80 W. Co to oznacza dla Menedżera zadań systemu Windows, jeśli chodzi o historię użycia?

| # of Cores: | 4 |

| # of Threads: | 4 |

| Clock Speed: | 3.1 GHz |

| Max Turbo Frequency: | 3.4 GHz |

| Intel® Smart Cache: | 8 MB |

| DMI: | 5 GT/s |

| Instruction Set: | 64-bit |

| Instruction Set Extensions: | SSE4.1/4.2, AVX |

| Embedded Options Available: | No |

| Lithography: | 32 nm |

| Max TDP: | 80 W |

Jak nazywa się topologia fizyczna, w której wszystkie urządzenia końcowe są bezpośrednio połączone z jednym punktem centralnym, takim jak koncentrator lub przełącznik?

Adres fizyczny karty sieciowej AC-72-89-17-6E-B2 zapisany jest w formacie

Wskaź narzędzie przeznaczone do mocowania pojedynczych żył kabla miedzianego w złączach?

Aby w systemie Windows XP stworzyć nowego użytkownika o nazwisku egzamin z hasłem qwerty, powinno się zastosować polecenie

Dostosowanie ustawień parametrów TCP/IP urządzenia na podstawie adresu MAC karty sieciowej jest funkcją protokołu

Który z rodzajów rekordów DNS w systemach Windows Server określa alias (inną nazwę) dla rekordu A związanej z kanoniczną (rzeczywistą) nazwą hosta?

Jakie polecenie w systemie Linux umożliwia wyświetlenie identyfikatora użytkownika?

Zadania systemu operacyjnego nie obejmują

Natychmiast po usunięciu ważnych plików na dysku twardym użytkownik powinien

Atak DDoS (z ang. Distributed Denial of Service) na serwer może spowodować

Podczas instalacji systemu operacyjnego Linux należy wybrać odpowiedni typ systemu plików

Na dysku konieczne jest zapisanie 100 tysięcy pojedynczych plików, każdy o wielkości 2570 bajtów. Zajętość zapisanych plików będzie minimalna na dysku o jednostce alokacji wynoszącej

W technologii Ethernet 100Base-TX do przesyłania danych używane są żyły kabla UTP podłączone do pinów:

Który z poniższych systemów operacyjnych nie jest wspierany przez system plików ext4?

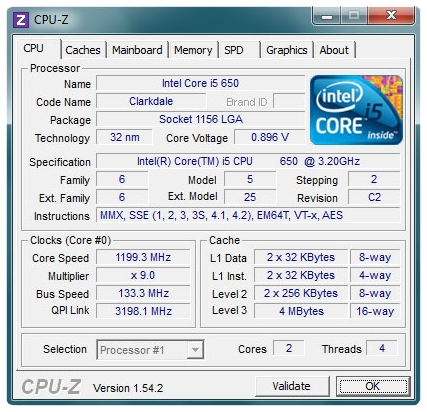

W dokumentacji technicznej procesora producent zamieścił wyniki analizy zrealizowanej przy użyciu programu CPU-Z. Z tych informacji wynika, że procesor dysponuje

Programem w systemie Linux, który umożliwia nadzorowanie systemu za pomocą zcentralizowanego mechanizmu, jest narzędzie

Który z symboli w systemach operacyjnych z rodziny Windows powinien być użyty przy udostępnianiu zasobu ukrytego w sieci?

Drukarką przeznaczoną do druku etykiet i kodów kreskowych, która drukuje poprzez roztapianie pokrycia specjalnej taśmy, w wyniku czego barwnik z niej zostaje przyklejony do materiału, na którym następuje drukowanie jest drukarka

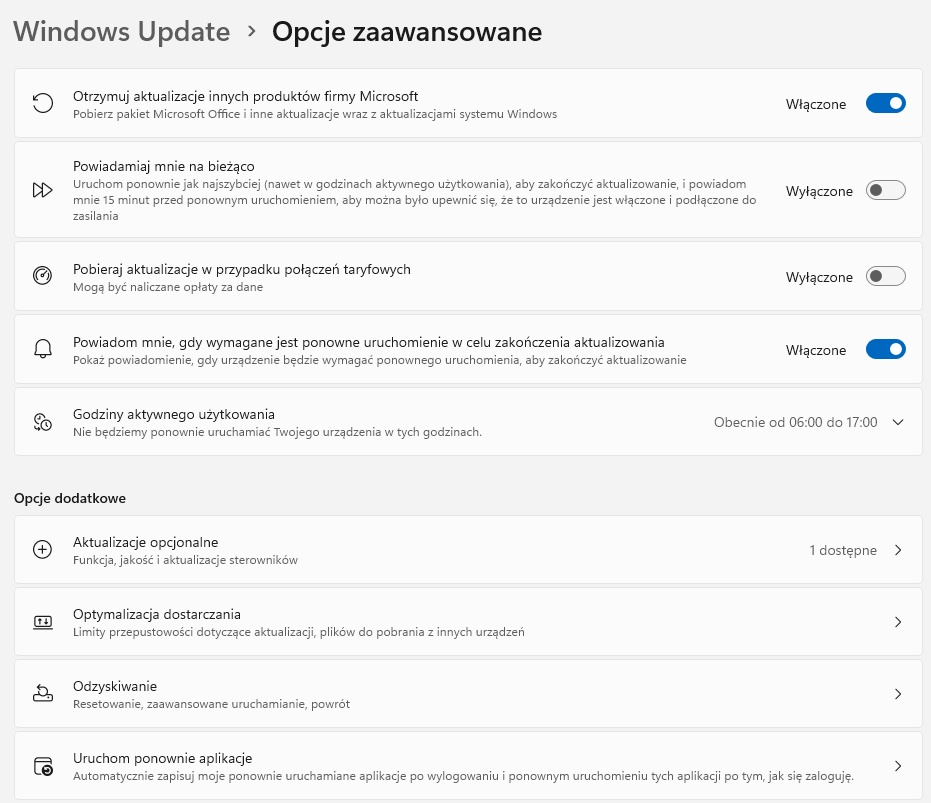

Biorąc pod uwagę konfigurację wykonywaną na ilustracji, administrator po zainstalowaniu systemu operacyjnego uznał za istotne, aby

W którym systemie operacyjnym może pojawić się komunikat podczas instalacji sterowników dla nowego urządzenia?

| System.......nie może zweryfikować wydawcy tego sterownika. Ten sterownik nie ma podpisu cyfrowego albo podpis nie został zweryfikowany przez urząd certyfikacji. Nie należy instalować tego sterownika, jeżeli nie pochodzi z oryginalnego dysku producenta lub od administratora systemu. |

Norma TIA/EIA-568-B.2 definiuje parametry specyfikacji transmisyjnej

Osoba pragnąca jednocześnie drukować dokumenty w wersji oryginalnej oraz trzech kopiach na papierze samokopiującym, powinna nabyć drukarkę

Jakie urządzenie pozwoli na podłączenie drukarki, która nie jest wyposażona w kartę sieciową, do lokalnej sieci komputerowej?

Jak skonfigurować dziennik w systemie Windows Server, aby rejestrować zarówno udane, jak i nieudane próby logowania użytkowników oraz działania na zasobach dyskowych?

Jak można zaktualizować wprowadzone zmiany w konfiguracji systemu operacyjnego Windows, korzystając z edytora zasad grup?

W metodzie dostępu do medium CSMA/CD (Carrier Sense Multiple Access with Collision Detection) stacja, która planuje rozpocząć transmisję, nasłuchuje, czy w sieci występuje aktywność, a następnie

Co nie wpływa na utratę z pamięci masowej HDD?