Pytanie 1

W systemie binarnym liczba 51(10) przyjmuje formę

Wynik: 13/40 punktów (32,5%)

Wymagane minimum: 20 punktów (50%)

W systemie binarnym liczba 51(10) przyjmuje formę

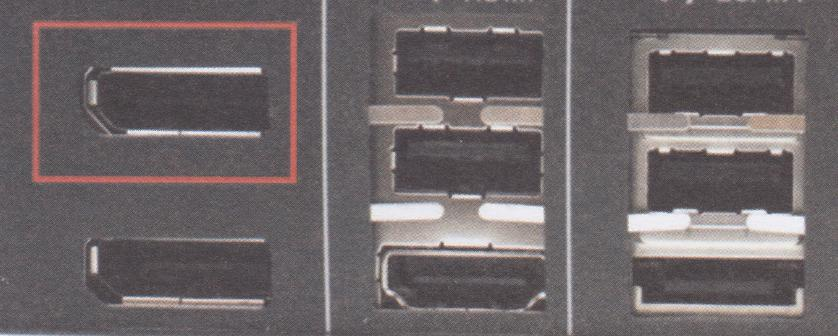

Do pokazanej na ilustracji płyty głównej nie da się podłączyć urządzenia korzystającego z interfejsu

W procedurze Power-On Self-Test w pierwszej kolejności wykonywane jest sprawdzanie

W którym programie należy zmodyfikować ustawienia, aby użytkownik komputera mógł wybrać z menu i uruchomić jeden z kilku systemów operacyjnych zainstalowanych na jego komputerze?

Złącze SC powinno być zainstalowane na przewodzie

W jakim systemie występuje jądro hybrydowe (kernel)?

Jakie urządzenie powinno być użyte do połączenia sprzętu peryferyjnego, które posiada bezprzewodowy interfejs komunikujący się za pomocą fal świetlnych w podczerwieni, z laptopem, który nie dysponuje takim interfejsem, lecz ma port USB?

Element elektroniczny przedstawiony na ilustracji to:

Na ilustracji złącze monitora, które zostało zaznaczone czerwoną ramką, będzie współdziałać z płytą główną posiadającą interfejs

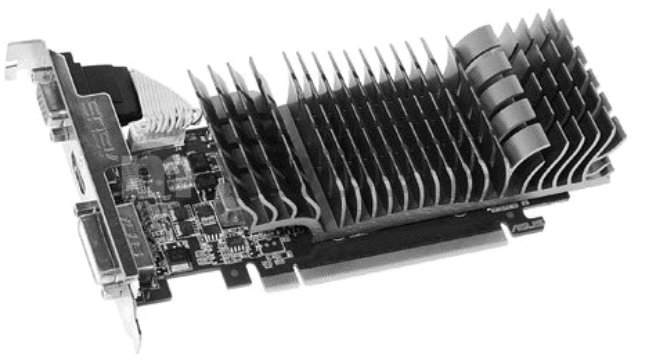

Karta rozszerzeń zaprezentowana na rysunku ma system chłodzenia

Jakim systemem operacyjnym jest system czasu rzeczywistego?

Który przyrząd należy wykorzystać do uzyskania wyników testu POST dla modułów płyty głównej?

Aby zmienić ustawienia rozruchu komputera w systemie Windows 7 przy użyciu wiersza poleceń, jakie polecenie powinno być użyte?

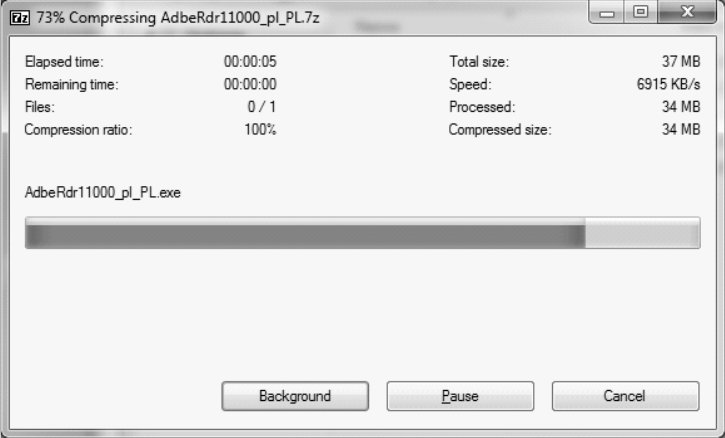

Na dołączonym obrazku ukazano proces

W systemie Windows Server narzędzie, które pozwala na zarządzanie zasadami grupowymi, to

Co należy zrobić przed przystąpieniem do prac serwisowych związanych z edytowaniem rejestru systemu Windows?

Przed dokonaniem zmian w rejestrze systemu Windows, w celu zapewnienia bezpieczeństwa pracy, należy najpierw

W którym typie macierzy, wszystkie fizyczne dyski są postrzegane jako jeden dysk logiczny?

Jakie jest adres rozgłoszeniowy w podsieci o adresie IPv4 192.168.160.0/21?

Czym charakteryzuje się technologia Hot swap?

W systemie Linux narzędzie fsck umożliwia

Jaką operację należy wykonać, aby chronić dane przesyłane w sieci przed działaniem sniffera?

Wykonanie polecenia tar -xf dane.tar w systemie Linux spowoduje

Które zestawienie: urządzenie - funkcja, którą pełni, jest niepoprawne?

Aby umożliwić diagnozę systemu operacyjnego Windows oraz utworzyć plik zawierający listę wszystkich zaczytywanych sterowników, należy uruchomić system w trybie

Standard magistrali komunikacyjnej PCI w wersji 2.2 (Peripheral Component Interconnect) definiuje maksymalną szerokość szyny danych na

Jakim symbolem jest oznaczona skrętka bez ekranowania?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Na początku procesu uruchamiania sprzętowego komputera, wykonywany jest test

Urządzenie pokazane na ilustracji to

Karta dźwiękowa, która może odtworzyć plik w formacie MP3, powinna być zaopatrzona w układ

Jakie typy połączeń z Internetem mogą być współdzielone w sieci lokalnej?

Na ilustracji, złącze monitora zaznaczone czerwoną ramką, będzie kompatybilne z płytą główną, która ma interfejs

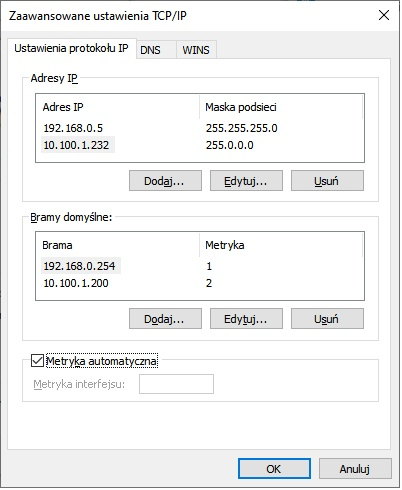

Na podstawie przedstawionej na ilustracji konfiguracji, w przypadku, gdy komputer żąda połączenia z inną siecią, w pierwszej kolejności dane zostaną wysłane do urządzenia o adresie

Firma Dyn, której serwery DNS zostały zaatakowane, przyznała, że część tego ataku … miała miejsce z użyciem różnych urządzeń podłączonych do sieci. Ekosystem kamer, czujników i kontrolerów określany ogólnie jako 'Internet rzeczy' został wykorzystany przez cyberprzestępców jako botnet − sieć maszyn-zombie. Jakiego rodzaju atak jest opisany w tym cytacie?

Dodatkowe właściwości rezultatu operacji przeprowadzanej przez jednostkę arytmetyczno-logiczne ALU obejmują

Osoba korzystająca z systemu Linux, chcąc zweryfikować dysk twardy pod kątem obecności uszkodzonych sektorów, ma możliwość skorzystania z programu

Co jest główną funkcją serwera DHCP w sieci komputerowej?

Granice dla obszaru kolizyjnego nie są określane przez porty urządzeń takich jak

Jaką maksymalną liczbę kanałów z dostępnego pasma kanałów standardu 802.11b można stosować w Polsce?