Pytanie 1

Regulacje dotyczące konstrukcji systemu okablowania strukturalnego, parametry kabli oraz procedury testowania obowiązujące w Polsce są opisane w normach

Wynik: 24/40 punktów (60,0%)

Wymagane minimum: 20 punktów (50%)

Regulacje dotyczące konstrukcji systemu okablowania strukturalnego, parametry kabli oraz procedury testowania obowiązujące w Polsce są opisane w normach

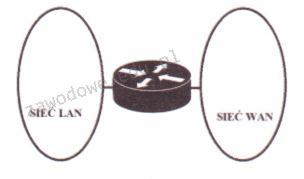

Jakie urządzenie sieciowe zostało przedstawione na diagramie sieciowym?

W którym katalogu w systemie Linux można znaleźć pliki zawierające dane o urządzeniach zainstalowanych w komputerze, na przykład pamięci RAM?

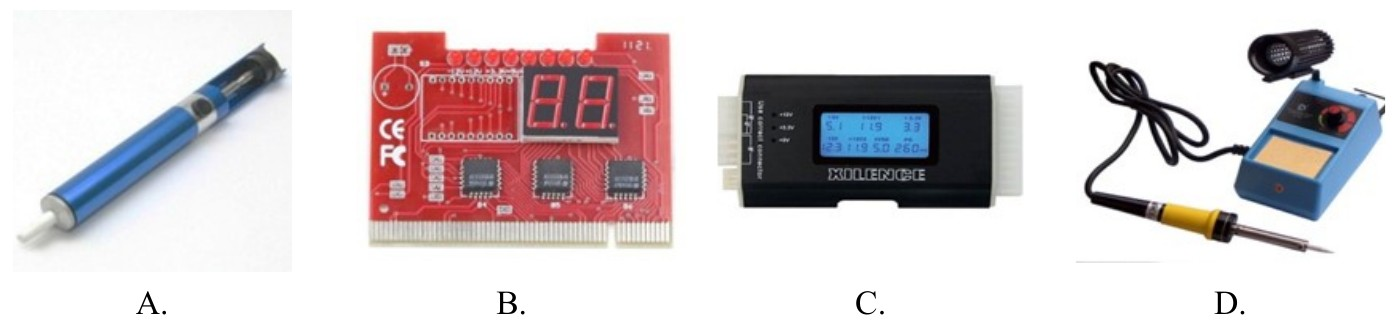

Jakie narzędzie powinno być użyte do zbadania wyników testu POST dla modułów na płycie głównej?

Który z poniższych systemów operacyjnych jest systemem typu open-source?

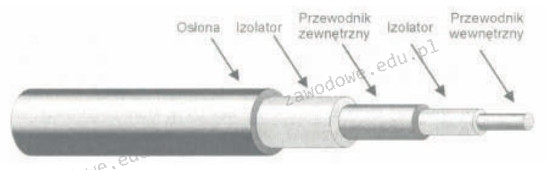

Na ilustracji przedstawiono przekrój kabla

Najbardziej nieinwazyjnym, a zarazem efektywnym sposobem naprawy komputera zainfekowanego wirusem typu rootkit jest

W jakim typie członkostwa w VLAN port może należeć do wielu sieci VLAN?

Jan, użytkownik, nie ma możliwości zmiany właściciela drukarki w systemie Windows. Aby zyskał taką opcję, konieczne jest nadanie mu w ustawieniach zabezpieczeń prawa do

Celem złocenia styków złącz HDMI jest

Po wykonaniu podanego skryptu

| echo off |

| echo ola.txt >> ala.txt |

| pause |

W przypadku dłuższych przestojów drukarki atramentowej, pojemniki z tuszem powinny

Jakiego systemu operacyjnego powinien nabyć użytkownik, aby zmodernizowany komputer miał możliwość uruchamiania gier obsługujących DirectX12?

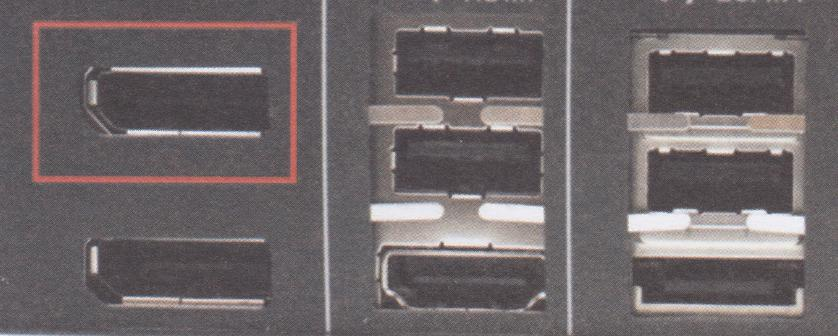

Wskaż interfejsy płyty głównej widoczne na rysunku.

Na ilustracji, złącze monitora zaznaczone czerwoną ramką, będzie kompatybilne z płytą główną, która ma interfejs

Analiza tłumienia w torze transmisyjnym na kablu umożliwia ustalenie

Funkcja narzędzia tracert w systemach Windows polega na

Procesor Intel Core i3 można zamontować w gnieździe

Zrzut ekranu przedstawiony powyżej, który pochodzi z systemu Windows, stanowi efekt działania komendy

Aktywne połączenia Protokół Adres lokalny Obcy adres Stan TCP 127.0.0.1:12295 Admin-Komputer:54013 CZAS_OCZEKIWANIA TCP 127.0.0.1:53778 Admin-Komputer:54015 CZAS_OCZEKIWANIA TCP 127.0.0.1:53778 Admin-Komputer:53779 USTANOWIONO TCP 127.0.0.1:53779 Admin-Komputer:53778 USTANOWIONO TCP 127.0.0.1:53780 Admin-Komputer:53781 USTANOWIONO TCP 127.0.0.1:53781 Admin-Komputer:53780 USTANOWIONO TCP 127.0.0.1:53786 Admin-Komputer:53787 USTANOWIONO TCP 127.0.0.1:53787 Admin-Komputer:53786 USTANOWIONO TCP 127.0.0.1:53796 Admin-Komputer:53797 USTANOWIONO TCP 127.0.0.1:53797 Admin-Komputer:53796 USTANOWIONO TCP 127.0.0.1:53974 Admin-Komputer:53975 USTANOWIONO TCP 127.0.0.1:53976 Admin-Komputer:53975 USTANOWIONO

Czym jest dziedziczenie uprawnień?

Usługa, która odpowiada za przekształcanie nazw domenowych na adresy IP, to

Protokołem umożliwiającym bezpołączeniowe przesyłanie datagramów jest

Który protokół służy do wymiany danych o trasach oraz dostępności sieci pomiędzy routerami w ramach tego samego systemu autonomicznego?

Najlepszą metodą ochrony danych przedsiębiorstwa, którego biura znajdują się w różnych, odległych miejscach, jest wdrożenie

Który z wymienionych adresów stanowi adres hosta w obrębie sieci 10.128.0.0/10?

Na komputerze z zainstalowanymi systemami operacyjnymi Windows i Linux, po przeprowadzeniu reinstalacji systemu Windows, drugi system przestaje się uruchamiać. Aby przywrócić możliwość uruchamiania systemu Linux oraz zachować dane i ustawienia w nim zgromadzone, co należy zrobić?

Jakie jest maksymalne dozwolone promień gięcia przy układaniu kabla U/UTP kat.5E?

Urządzenie pokazane na ilustracji ma na celu

Zużyty sprzęt elektryczny lub elektroniczny, na którym znajduje się symbol zobrazowany na ilustracji, powinien być

Na jakich licencjach są dystrybuowane wersje systemu Linux Ubuntu?

Funkcja systemu Windows Server, umożliwiająca zdalną instalację systemów operacyjnych na komputerach kontrolowanych przez serwer, to

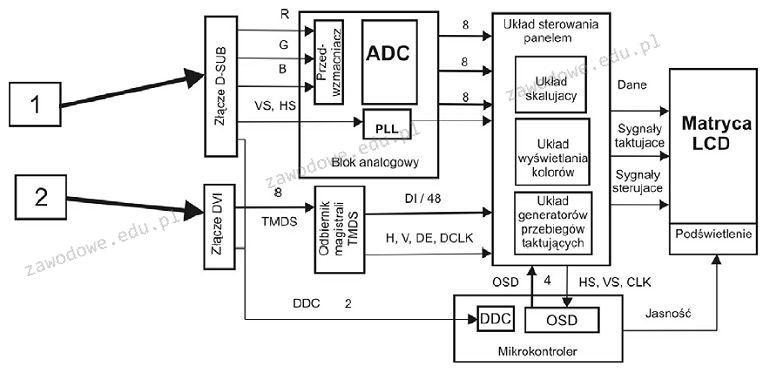

Które z połączeń zaznaczonych strzałkami na diagramie monitora stanowi wejście cyfrowe?

Przy zgrywaniu filmu kamera cyfrowa przesyła na dysk 220 MB na minutę. Wybierz z diagramu interfejs o najniższej prędkości transferu, który umożliwia taką transmisję

Mysz komputerowa z interfejsem bluetooth pracującym w klasie 2 ma teoretyczny zasięg do

Jakie urządzenie jest pokazane na ilustracji?

Napięcie dostarczane do poszczególnych elementów komputera w zasilaczu komputerowym w standardzie ATX jest zmniejszane z wartości 230V między innymi do wartości

Czym są programy GRUB, LILO, NTLDR?

Aby skopiować katalog c: est z podkatalogami na dysk przenośny f: w systemie Windows 7, jakie polecenie należy zastosować?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jak nazywa się urządzenie wskazujące, które współpracuje z monitorami CRT i ma końcówkę z elementem światłoczułym, a jego dotknięcie ekranu monitora skutkuje przesłaniem sygnału do komputera, co umożliwia lokalizację kursora?