Pytanie 1

Emisja dźwięków: jednego długiego oraz dwóch krótkich przez BIOS firmy AMI wskazuje na

Wynik: 14/40 punktów (35,0%)

Wymagane minimum: 20 punktów (50%)

Emisja dźwięków: jednego długiego oraz dwóch krótkich przez BIOS firmy AMI wskazuje na

Adres IP jest zapisany jako cztery grupy liczb, które są oddzielone kropkami

W systemie Linux, aby uzyskać informację o nazwie aktualnego katalogu roboczego, należy użyć polecenia

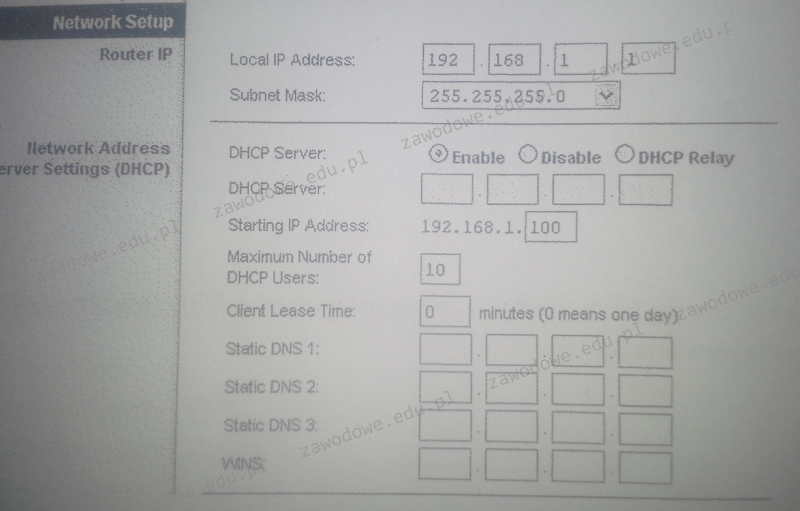

Na przedstawionym zrzucie panelu ustawień rutera można zauważyć, że serwer DHCP

W systemie Linux narzędzie iptables wykorzystuje się do

Wskaż komponent, który reguluje wartość napięcia pochodzącego z sieci elektrycznej, wykorzystując transformator do przeniesienia energii między dwoma obwodami elektrycznymi z zastosowaniem zjawiska indukcji magnetycznej?

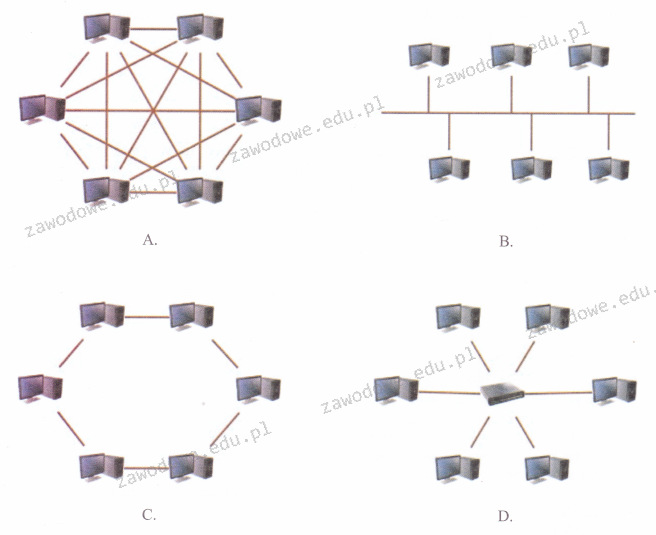

Która z zaprezentowanych na rysunkach topologii odpowiada topologii siatki?

Tester strukturalnego okablowania umożliwia weryfikację

Jaką maksymalną liczbę kanałów z dostępnego pasma kanałów standardu 802.11b można stosować w Polsce?

Program typu recovery, w warunkach domowych, pozwala na odzyskanie danych z dysku twardego w przypadku

Procesor RISC to procesor o

Złącze IrDA służy do bezprzewodowej komunikacji i jest

Które z poniższych twierdzeń nie odnosi się do pamięci cache L1?

Co jest główną funkcją serwera DHCP w sieci komputerowej?

Które urządzenie poprawi zasięg sieci bezprzewodowej?

Jeśli adres IP komputera roboczego przyjmuje formę 176.16.50.10/26, to jaki jest adres rozgłoszeniowy oraz maksymalna liczba hostów w tej sieci?

Aby ocenić stabilność systemu Windows Server, należy użyć narzędzia

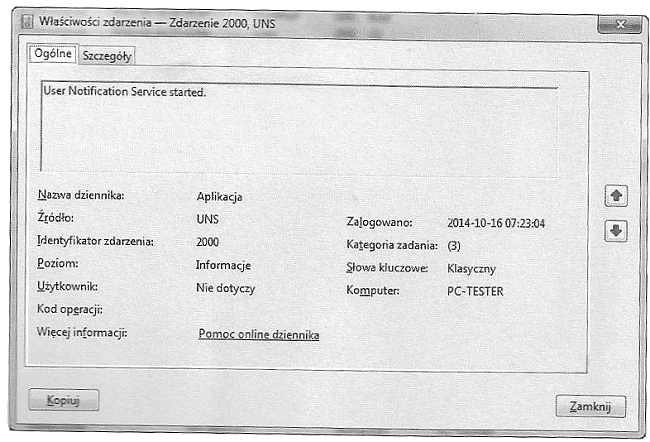

Wpis przedstawiony na ilustracji w dzienniku zdarzeń klasyfikowany jest jako zdarzenie typu

Aby zorganizować pliki na dysku w celu poprawy wydajności systemu, należy:

W systemie Windows do instalacji aktualizacji oraz przywracania sterowników urządzeń należy użyć przystawki

Kluczowe znaczenie przy tworzeniu stacji roboczej dla wielu wirtualnych maszyn ma

Aby sprawdzić dysk twardy w systemie Linux na obecność uszkodzonych sektorów, użytkownik może zastosować program

Dobrze zaprojektowana sieć komputerowa powinna zapewniać możliwość rozbudowy, czyli charakteryzować się

Który protokół należy do bezpołączeniowych protokołów warstwy transportowej?

Aplikacją systemu Windows, która umożliwia analizę wpływu różnych procesów i usług na wydajność CPU oraz oceny stopnia obciążenia pamięci i dysku, jest

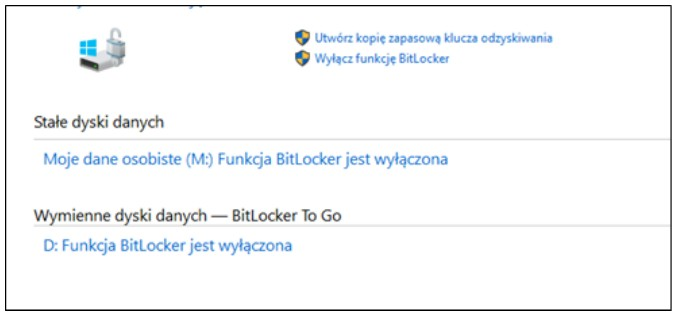

Narzędzie wbudowane w systemy Windows w edycji Enterprise lub Ultimate ma na celu

Aby Jan mógł zmienić właściciela drukarki w systemie Windows, musi mu zostać przypisane prawo do w opcjach zabezpieczeń

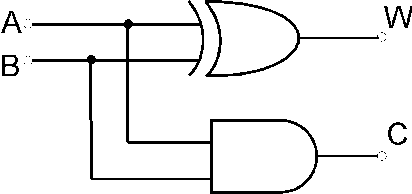

Wynikiem działania przedstawionego układu logicznego po podaniu na wejściach A i B sygnałów logicznych A=1 i B=1 są wartości logiczne:

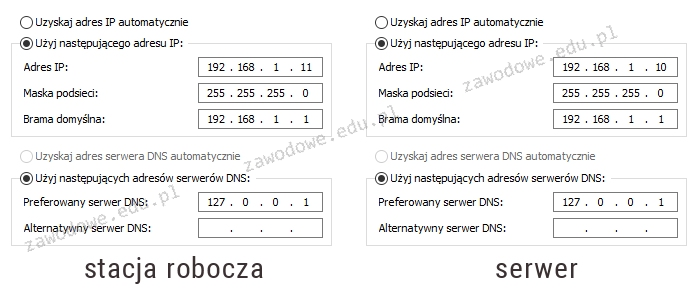

Na schemacie przedstawiono konfigurację protokołu TCP/IP pomiędzy serwerem a stacją roboczą. Na serwerze zainstalowano rolę DNS. Wykonanie polecenia ping www.cke.edu.pl na serwerze zwraca pozytywny wynik, natomiast na stacji roboczej jest on negatywny. Jakie zmiany należy wprowadzić w konfiguracji, aby usługa DNS na stacji funkcjonowała poprawnie?

Podczas próby zapisania danych na karcie SD wyświetla się komunikat "usuń ochronę przed zapisem lub użyj innego dysku". Zwykle przyczyną tego komunikatu jest

W jakim urządzeniu elektronicznym znajduje się układ RAMDAC?

W tablecie graficznym bez wyświetlacza pióro nie ustala położenia kursora ekranowego, można jedynie korzystać z jego końcówki do przesuwania kursora ekranowego oraz klikania. Wskaż możliwą przyczynę nieprawidłowej pracy urządzenia.

Podstawowym zadaniem mechanizmu Plug and Play jest:

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jakie medium transmisyjne stosują myszki bluetooth do łączności z komputerem?

Jaką liczbę punktów abonenckich (2 x RJ45) zgodnie z wytycznymi normy PN-EN 50167 powinno się zainstalować w biurze o powierzchni 49 m2?

Standard IEEE 802.11 określa typy sieci

Który rekord DNS powinien zostać dodany w strefie wyszukiwania do przodu, aby skojarzyć nazwę domeny DNS z adresem IP?

Jakim protokołem łączności, który gwarantuje pewne dostarczenie informacji, jest protokół

Na podstawie przedstawionego w tabeli standardu opisu pamięci PC-100 wskaż pamięć, która charakteryzuje się maksymalnym czasem dostępu wynoszącym 6 nanosekund oraz minimalnym opóźnieniem między sygnałami CAS i RAS równym 2 cyklom zegara?

| Specyfikacja wzoru: PC 100-abc-def jednolitego sposobu oznaczania pamięci. | ||

| a | CL (ang. CAS Latency) | minimalna liczba cykli sygnału taktującego, liczona podczas operacji odczytu, od momentu uaktywnienia sygnału CAS, do momentu pojawienia się danych na wyjściu modułu DIMM (wartość CL wynosi zwykle 2 lub 3); |

| b | tRCD (ang. RAS to CAS Delay) | minimalne opóźnienie pomiędzy sygnałami RAS i CAS, wyrażone w cyklach zegara systemowego; |

| c | tRP (ang. RAS Precharge) | czas wyrażony w cyklach zegara taktującego, określający minimalną pauzę pomiędzy kolejnymi komendami, wykonywanymi przez pamięć; |

| d | tAC | Maksymalny czas dostępu (wyrażony w nanosekundach); |

| e | SPD Rev | specyfikacja komend SPD (parametr może nie występować w oznaczeniach); |

| f | Parametr zapasowy | ma wartość 0; |