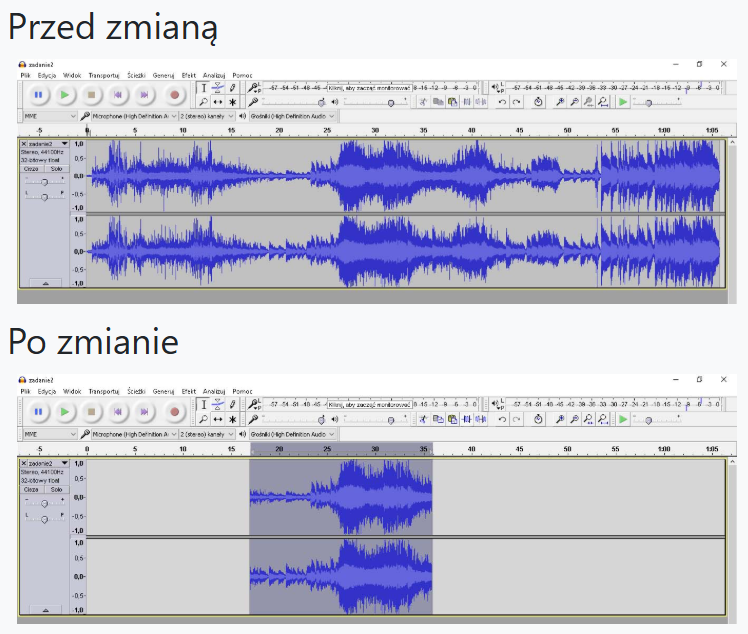

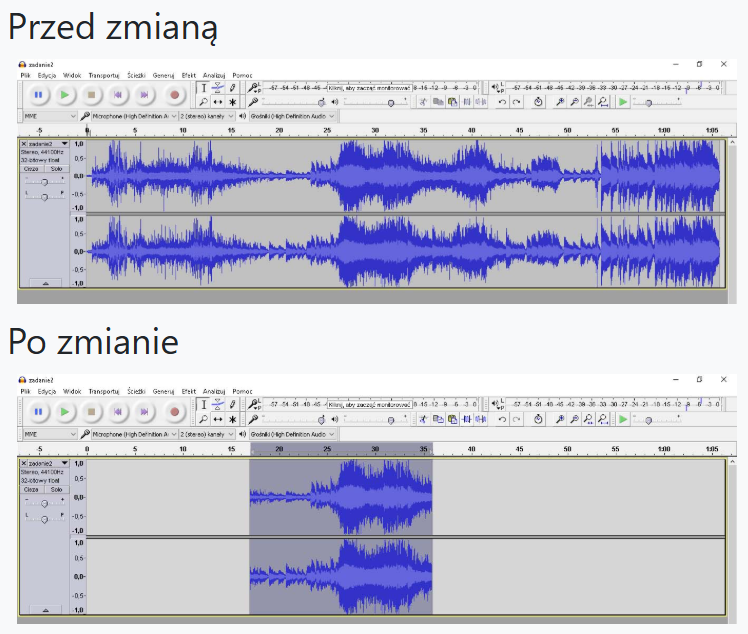

Poprawnie – na ilustracji widać klasyczną operację przycinania dźwięku. W górnym zrzucie ekranu ścieżka audio zajmuje cały czas trwania projektu, od początku do końca. Po zmianie widać, że pozostawiony został tylko środkowy fragment nagrania, a początek i koniec zostały usunięte – dokładnie tak działa funkcja „Przytnij dźwięk” (trim). W większości edytorów audio, takich jak Audacity, Adobe Audition czy Reaper, przycinanie polega na zaznaczeniu interesującego fragmentu i wycięciu wszystkiego poza zaznaczeniem. To nie jest wyciszenie, bo na zaznaczeniu nadal widać amplitudę fali, więc dźwięk tam normalnie gra. To też nie jest przesunięcie w czasie – ścieżka nie została przesunięta w lewo ani w prawo względem osi czasu, tylko skrócona. Nie ma tu również żadnego wyrównania do innej ścieżki, więc nie jest to synchronizacja. W praktyce przycinanie wykorzystuje się do usuwania ciszy na początku i końcu nagrania lektorskiego, ucinania zbędnych prób w nagraniu muzycznym, wywalania pomyłek między dublami czy przygotowania krótkich efektów dźwiękowych do gier i prezentacji. Moim zdaniem to jedna z podstawowych operacji montażu – dobrze jest wyrobić sobie nawyk najpierw przyciąć materiał do potrzebnej długości, a dopiero później bawić się w efekty, kompresję czy korekcję barwy. Dzięki temu projekt jest czytelniejszy, a praca z osią czasu dużo wygodniejsza i zgodna z dobrymi praktykami w branży audio i multimediów.

Na ilustracji z programu Audacity widać typową operację montażową na ścieżce audio, ale łatwo tu o kilka mylnych skojarzeń. Po pierwsze, część osób widząc, że fragment nagrania zniknął, myśli od razu o wyciszeniu. Wyciszenie (mute) w edycji dźwięku polega jednak na zmianie głośności do zera, przy zachowaniu całej długości ścieżki. Na wykresie fali dźwiękowej oznaczałoby to bardzo niską lub płaską linię, ale nadal rozciągniętą na całym odcinku czasu. Na obrazku po zmianie początek i koniec ścieżki zostały całkowicie usunięte, a nie tylko uciszone – nie ma tam nawet płaskiej linii. To znaczy, że materiał został fizycznie skrócony, a nie tylko ściszony. Druga możliwa pomyłka to skojarzenie z przesuwaniem w czasie. Przesunięcie oznacza, że cały klip zostaje przeniesiony w lewo lub w prawo na osi czasu, ale jego długość pozostaje identyczna. Używa się tego np. do dopasowania wejścia wokalu do bitu albo ustawienia efektu dźwiękowego dokładnie w konkretnym momencie filmu. Na zrzucie ekranu nie ma jednak żadnego przesunięcia – środkowy fragment pozostał w tym samym miejscu, natomiast zniknęły fragmenty przed i po nim. To jest charakterystyczne właśnie dla przycinania. Synchronizacja z kolei wymagałaby odniesienia do innej ścieżki lub obrazu wideo: dopasowania fazy, wyrównania transjentów, zgrania klatek obrazu z dźwiękiem. Tutaj mamy jedną ścieżkę i brak jakichkolwiek znaczników synchronizacji, więc taka interpretacja nie ma technicznego uzasadnienia. Typowy błąd myślowy polega na tym, że każdą zmianę kształtu lub długości widocznej fali traktujemy jako dowód na zastosowanie konkretnego efektu, bez analizy tego, co faktycznie zniknęło: amplituda, położenie, czy po prostu część materiału. W montażu audio warto zawsze patrzeć na trzy rzeczy naraz: czy zmieniła się długość klipu, czy jego położenie na osi czasu i czy zniknęła amplituda. Dopiero zestawienie tych trzech elementów pozwala poprawnie rozpoznać, czy był to trim, mute, przesunięcie, czy jakaś forma synchronizacji. Tu jednoznacznie widać klasyczne przycięcie nagrania do wybranego fragmentu.