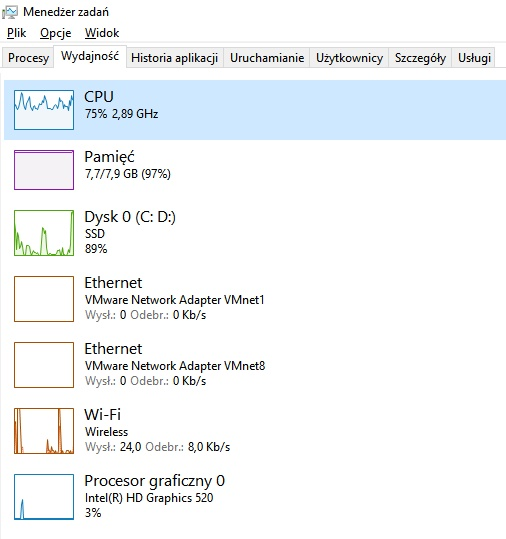

Tutaj kluczowa jest obserwacja z okna „Wydajność” w Menedżerze zadań: pamięć RAM jest zajęta w 97%. To bardzo wyraźny sygnał, że komputer po prostu „dusi się” z powodu zbyt małej ilości dostępnej pamięci operacyjnej. System nie ma gdzie trzymać danych potrzebnych programom (tu: aplikacjom graficznym), więc zaczyna intensywnie korzystać z pliku stronicowania na dysku. A dostęp do dysku – nawet SSD – jest o rząd wielkości wolniejszy niż dostęp do RAM. Efekt użytkownik widzi jako przycinki, lagi przy przełączaniu okien, wolne renderowanie podglądu, opóźnienia przy zapisywaniu dużych projektów. Z mojego doświadczenia, przy pracy grafika komputerowego RAM jest często ważniejszy niż sam procesor graficzny, szczególnie przy wielu otwartych aplikacjach: Photoshop, Illustrator, przeglądarka z kilkoma kartami, komunikator, czasem jeszcze wirtualna maszyna. Standardem branżowym jest dziś co najmniej 16 GB RAM do wygodnej pracy z grafiką 2D, a przy dużych plikach, wysokich rozdzielczościach, plikach PSD z wieloma warstwami – nawet 32 GB lub więcej. Dobre praktyki mówią też, żeby podczas diagnozowania wydajności patrzeć nie tylko na chwilowe obciążenie CPU czy GPU, ale właśnie na procent zajętości pamięci i ilość pamięci „zarezerwowanej” przez system. Gdy widzisz wartości rzędu 90–100%, pierwszym krokiem jest zamknięcie zbędnych aplikacji, a długofalowo – rozbudowa RAM. Na screenie widać, że CPU jest obciążony umiarkowanie, GPU praktycznie się nudzi, dysk SSD pracuje, ale nie jest „przyklejony” do 100%. Natomiast pamięć RAM jest praktycznie pełna. To klasyczny przypadek, gdy ograniczeniem jest właśnie jej ilość. W praktyce, po dołożeniu pamięci komputer nagle „odżywa”, programy graficzne przestają się zacinać, a przełączanie między projektami staje się płynne – i to bez żadnych innych zmian sprzętowych.

Na załączonym zrzucie z Menedżera zadań widać typowy obraz komputera, który cierpi przede wszystkim na brak pamięci RAM, a nie na inne problemy. Bardzo łatwo w takiej sytuacji skupić się na niewłaściwym elemencie. Wielu użytkowników automatycznie obwinia kartę graficzną, bo „grafikowi potrzebna jest mocna grafika”, ale tutaj procesor graficzny jest obciążony zaledwie w kilku procentach. To oznacza, że GPU praktycznie się nudzi i nie jest wąskim gardłem. Przy tak niskim użyciu nie ma podstaw, żeby mówić o „niskiej wydajności procesora graficznego” jako głównej przyczynie spowolnień. Częstym błędem jest też zrzucanie winy na dysk. Owszem, wolny dysk talerzowy potrafi bardzo mocno spowolnić system, zwłaszcza przy starcie systemu czy wczytywaniu dużych plików. Jednak na ilustracji widzimy dysk SSD, a jego obciążenie nie jest stałe na poziomie 100%, tylko zmienne i raczej umiarkowane. Gdyby to dysk był głównym problemem, wykres dysku byłby praktycznie cały czas „wyklejony” na maksimum, a tu tego nie ma. Do tego SSD zgodnie z obecnymi standardami branżowymi zapewnia znacznie lepszą responsywność niż klasyczny HDD, więc w pierwszej kolejności patrzymy na inne zasoby. Kolejna pułapka myślowa to obwinianie łącza internetowego za każdą wolną pracę komputera. Wolne Wi‑Fi czy słaby Internet wpływa na ładowanie stron, pobieranie plików, pracę w chmurze, ale nie ma bezpośredniego wpływu na szybkość działania programów graficznych pracujących lokalnie. Nawet jeśli transfer jest niski, to nie spowalnia renderowania warstw w Photoshopie czy przełączania się między oknami w systemie. Menedżer zadań wyraźnie pokazuje, że interfejsy sieciowe praktycznie nic nie wysyłają ani nie odbierają, więc nie możemy tutaj mówić o problemie z siecią. Profesjonalne podejście do diagnostyki wydajności polega na analizie twardych danych: procentowego użycia CPU, RAM, dysku i GPU, a nie na domysłach. W tym przypadku tylko pamięć znajduje się w strefie krytycznej – blisko 100% zajętości. Pozostałe komponenty mają jeszcze spory zapas. Dlatego obwinianie karty graficznej, dysku czy Internetu to typowy przykład patrzenia na nie ten wskaźnik, co trzeba. W praktyce warto wyrobić sobie nawyk, żeby przy każdym „zamula” komputera najpierw otworzyć Menedżer zadań i spokojnie przeanalizować, który zasób faktycznie jest przeciążony, zamiast zgadywać.